Ce que le streaming change (vraiment) pour la BI

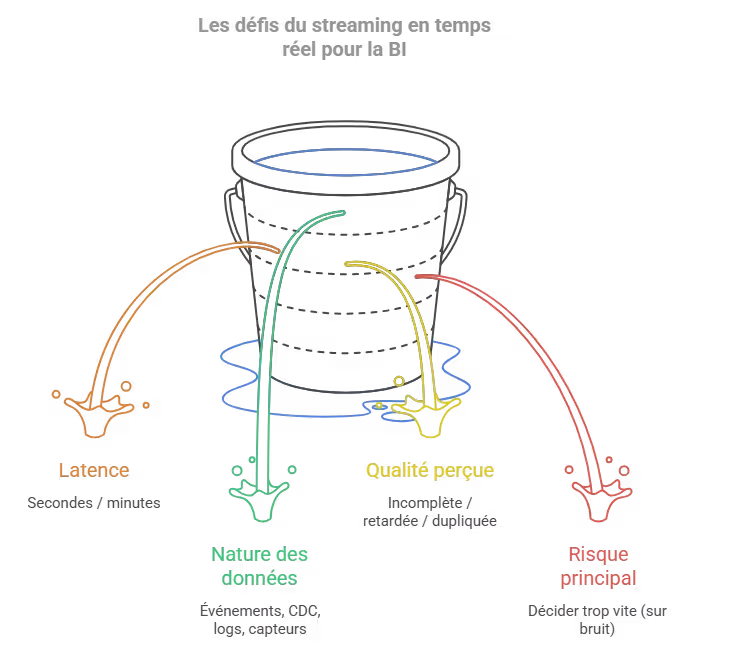

Le streaming en temps réel n’est pas un simple "rafraîchissement plus fréquent". C’est un changement de posture : on ne traite plus une base figée, on traite un flux d’événements qui arrive sans fin, potentiellement incomplet, parfois en désordre, et souvent bruyant.

| Dimension | BI "batch" (historique) | BI "streaming" (temps réel) |

|---|---|---|

| Latence | Heures / jours | Secondes / minutes |

| Nature des données | Tables stabilisées | Événements, CDC, logs, capteurs |

| Qualité perçue | "Propre" après traitements | Incomplète / retardée / dupliquée |

| Décisions | Planification, reporting, analyse rétrospective | Alerting, optimisation en cours, anti-fraude, opérations |

| Risque principal | Décider trop tard | Décider trop vite (sur bruit) |

Le temps réel n’est pas "mieux" par défaut. Il est utile quand le coût d’une décision tardive dépasse le coût d’une décision potentiellement imparfaite. Sinon, on fabrique inutilement des alertes… et de la fatigue décisionnelle.

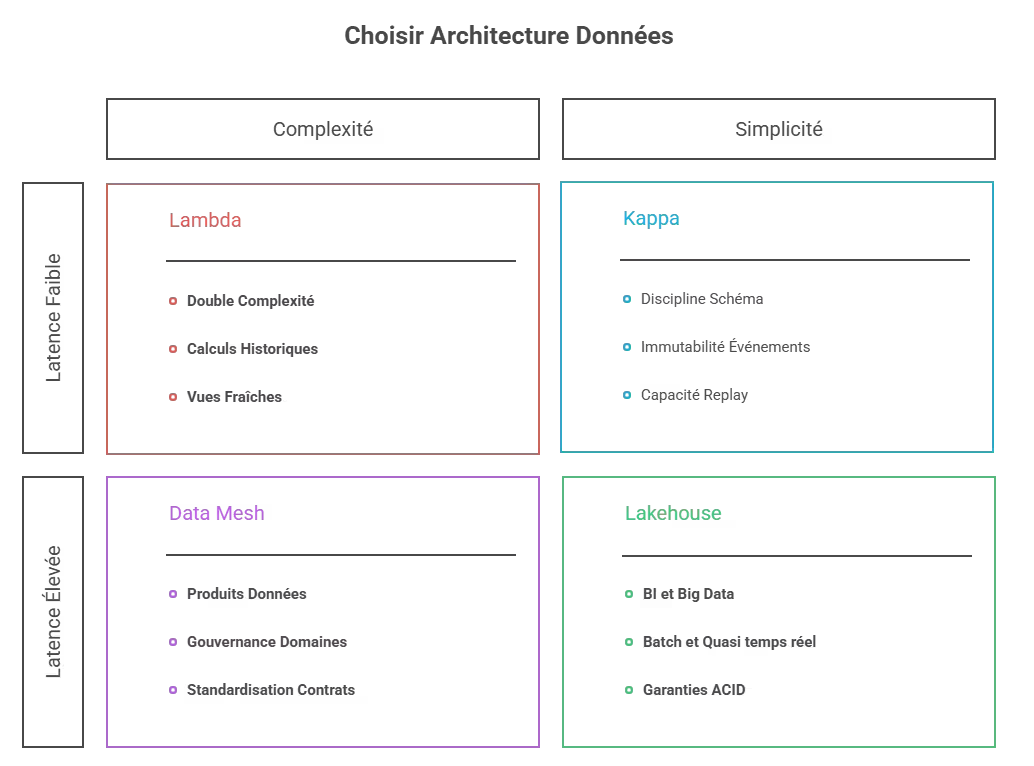

Architectures : Lambda, Kappa, Lakehouse, Data Mesh

On peut faire du temps réel avec différentes architectures. L’important est moins le nom que les compromis : latence(Rapidité d'accès), coût, simplicité, fiabilité, gouvernance.

Lambda : batch + speed layer

L’approche Lambda combine une couche batch (calculs robustes, historiques) et une couche temps réel (vues fraîches), puis réconcilie. Elle peut être efficace, mais elle double parfois la complexité (deux pipelines).

Kappa : un flux unique (et des replays)

L’approche Kappa cherche à traiter tout via le streaming, en rejouant l’historique comme un flux. Cela simplifie certains aspects, mais exige une discipline sur les schémas, l’immutabilité des événements et la capacité de replay.

Lakehouse : unifier BI et "big data"

Le Lakehouse vise à combiner la flexibilité d’un data lake et les garanties d’un entrepôt (ACID, tables gérées, gouvernance). C’est souvent une bonne base pour faire cohabiter le batch avec le quasi temps réel.

Data Mesh : organisation et produits de données

Le Data Mesh introduit une logique de domaines qui publient des "produits de données" gouvernés. En streaming, cela pousse à standardiser les contrats (schémas), la qualité et l’observabilité pour éviter un chaos d’événements.

Quand viser la simplicité

- Un nombre limité de flux critiques

- Quelques KPI opérationnels

- Une équipe plateforme réduite

- Besoin principal : alerting fiable

Quand viser l’industrialisation

- Beaucoup de domaines / équipes

- Contrats de données obligatoires

- Historique + streaming + IA

- Exigences fortes d’audit

Pipeline temps réel : de l’événement au tableau de bord

En batch, on pense "ETL nocturne". En streaming, on pense "chaîne continue". Un pipeline temps réel typique ressemble à ceci :

- Production : applications, capteurs, services, logs, transactions.

- Ingestion : bus d’événements (topics), collecte, buffering, backpressure.

- Traitement : enrichissement, filtrage, agrégations, jointures, fenêtres temporelles.

- Stockage : tables analytiques, vues materialisées, index pour requêtes rapides.

- Consommation : dashboards, alerting, décisions automatisées, APIs.

En temps réel, les événements peuvent arriver en retard. Il faut décider si l’on raisonne sur le moment où l’événement s’est produit (event time) ou sur le moment où il arrive (processing time). Ce choix change la lecture des KPI.

Fenêtres, retard et corrections

Pour calculer des KPI sur flux, on utilise souvent des fenêtres (ex : 1 min glissante, 5 min tumbling, session). Il faut aussi prévoir des corrections : événements en retard, duplications, annulations, mises à jour (CDC). La BI temps réel n’est pas un affichage instantané : c’est une estimation contrôlée, qui se stabilise.

KPI et décisions : comment éviter les "mauvaises alertes"

Quand on passe au temps réel, le KPI devient un signal nerveux : il bouge, il frémit, il fluctue. L’erreur fréquente consiste à déclencher des actions sur une variation normale.

Un KPI temps réel doit être "actionnable"

Actionnable signifie : seuils explicites, responsable identifié, action définie, et mécanisme pour vérifier l’impact.

Ce qui réduit le bruit

- Fenêtres glissantes et lissage

- Détection d’anomalies (avec prudence)

- Comparaison à une baseline (jour/semaine)

- Segmentation (canal, région, device)

Ce qui rend la décision robuste

- SLA et qualité mesurée (freshness, completeness)

- Règles de déclenchement (hystérésis)

- Playbooks (quoi faire, qui valide)

- Traçabilité : pourquoi l’alerte a sonné

Une bonne pratique consiste à distinguer : KPI exploratoires (pour comprendre) et KPI opératoires (pour agir). Tout mettre en mode "alerte" finit souvent en outil inexploitable… parce que plus personne ne regarde.

Qualité, gouvernance et traçabilité en flux continu

En streaming, la qualité ne se "nettoie" pas uniquement à la fin. Elle se pilote en continu : contrats de schéma, versioning, validation, monitoring, et documentation.

Contrats de données : un détail qui évite la panne silencieuse

Sans contrats (schémas versionnés, règles de compatibilité), les producteurs cassent les consommateurs. En temps réel, ce n’est pas un "bug demain matin", c’est une métrique qui devient fausse immédiatement.

Un bon flux est un flux observable : latence mesurée, taux d’erreurs, volume attendu, dérives détectées, et surtout : un owner.

Cas d’usage concrets

Industrie : maintenance et qualité en ligne

Sur des lignes de production, quelques minutes de retard peuvent coûter cher. Les flux capteurs permettent d’alerter tôt sur une dérive (température, vibration, taux de défaut), puis d’enrichir l’historique pour l’analyse long terme.

E-commerce : conversion, fraude, logistique

En temps réel, on suit les ruptures, les abandons panier, la latence de paiement, et certains signaux de fraude. L’enjeu est d’éviter les "faux positifs" : une campagne ou un pic saisonnier peut faire bouger tout le système.

Finance : détection et conformité

Les décisions peuvent être automatisées (blocage, scoring), mais elles doivent rester auditables. Cela implique des logs d’explications, des seuils contrôlés, et une capacité à reconstruire "ce qui était connu" au moment de la décision.

Service public : usage, saturation, parcours

Le temps réel peut servir à détecter une saturation (pannes, surcharges, erreurs), prioriser l’assistance, et améliorer l’accessibilité. Mais il faut compléter les métriques par des données qualitatives (tests, retours, enquêtes) pour éviter des interprétations trop mécaniques.

Panorama des briques techniques (sans dogme)

Le but n’est pas de lister une "stack idéale", mais de repérer les fonctions indispensables.

| Brique | Rôle | Questions à se poser |

|---|---|---|

| Bus d’événements | Transport, découplage, replay | Débit ? Retention ? Contrats de schéma ? |

| Compute streaming | Transformations, fenêtres, jointures | Exactly-once ? Gestion du retard ? |

| Stockage analytique | Requêtes rapides, historiques | ACID ? Coût ? Concurrence BI ? |

| BI / dashboards | Visualisation et partage | Gouvernance ? RLS ? Performance ? |

| Observabilité data | Qualité, freshness, alertes | SLA ? Ownership ? Détection drift ? |

Les organisations qui réussissent ne choisissent pas "les bons outils" d’abord : elles choisissent des cas d’usage, définissent des SLAs, puis construisent une plateforme minimale qui tient la charge.

Checklist de mise en place

- Identifier 2–3 décisions où la latence coûte réellement (et mesurer ce coût).

- Définir des KPI actionnables : seuils, owner, playbook, escalade.

- Choisir un modèle de données évènementiel (schémas versionnés, clés, idempotence).

- Mettre en place l’observabilité dès le début (freshness, volumes, erreurs, retard).

- Concilier temps réel et vérité : corrections, replays, réconciliation avec le batch.

- Former les équipes : lire un KPI streaming n’est pas lire un KPI batch.

Déployer le streaming "parce que c’est moderne". Sans décision claire à améliorer, le temps réel devient un coût récurrent et un générateur d’alertes inutiles.

FAQ

Le temps réel est-il nécessaire pour toute la BI ?

Peut-on garantir des KPI "parfaits" en streaming ?

Quelle est la première brique à mettre en place ?

Conclusion

L’analyse décisionnelle à l’ère de la Big Data et du streaming ne se résume pas à "voir plus vite". Elle impose de repenser la chaîne décisionnelle : données évènementielles, latence, fiabilité, gouvernance, et action.

Le temps réel devient vraiment puissant quand il est ciblé sur des décisions à fort impact, qu’il est observable, et qu’il s’inscrit dans une architecture qui sait réconcilier rapidité et vérité.