Le doomscrolling : quand l’info devient toxique

Comment les algorithmes de recommandation nous enferment dans un cycle d’information anxiogène.

Netflix, TikTok, Amazon, YouTube… Chaque jour, des algorithmes décident pour nous ce que nous allons regarder, acheter ou écouter. Mais jusqu’où s’étend leur influence ? Cet article explore les mécanismes de ces systèmes de recommandation, leurs impacts sur nos décisions et les risques qu’ils font peser sur notre autonomie.

Chaque jour, des milliards d’utilisateurs interagissent avec des algorithmes de recommandation sans toujours en mesurer l’emprise. Que ce soit sur Netflix, YouTube, TikTok, Amazon ou Spotify, ces systèmes influencent silencieusement nos choix culturels, nos achats, nos opinions et même nos relations sociales. Mais comment fonctionnent-ils ? Et dans quelle mesure façonnent-ils nos décisions au point de réduire notre libre arbitre ?

Selon une étude de McKinsey (2025), 75 % des contenus visionnés sur Netflix et 85 % du temps passé sur TikTok sont le résultat direct de recommandations algorithmiques, non d’une recherche active de l’utilisateur.

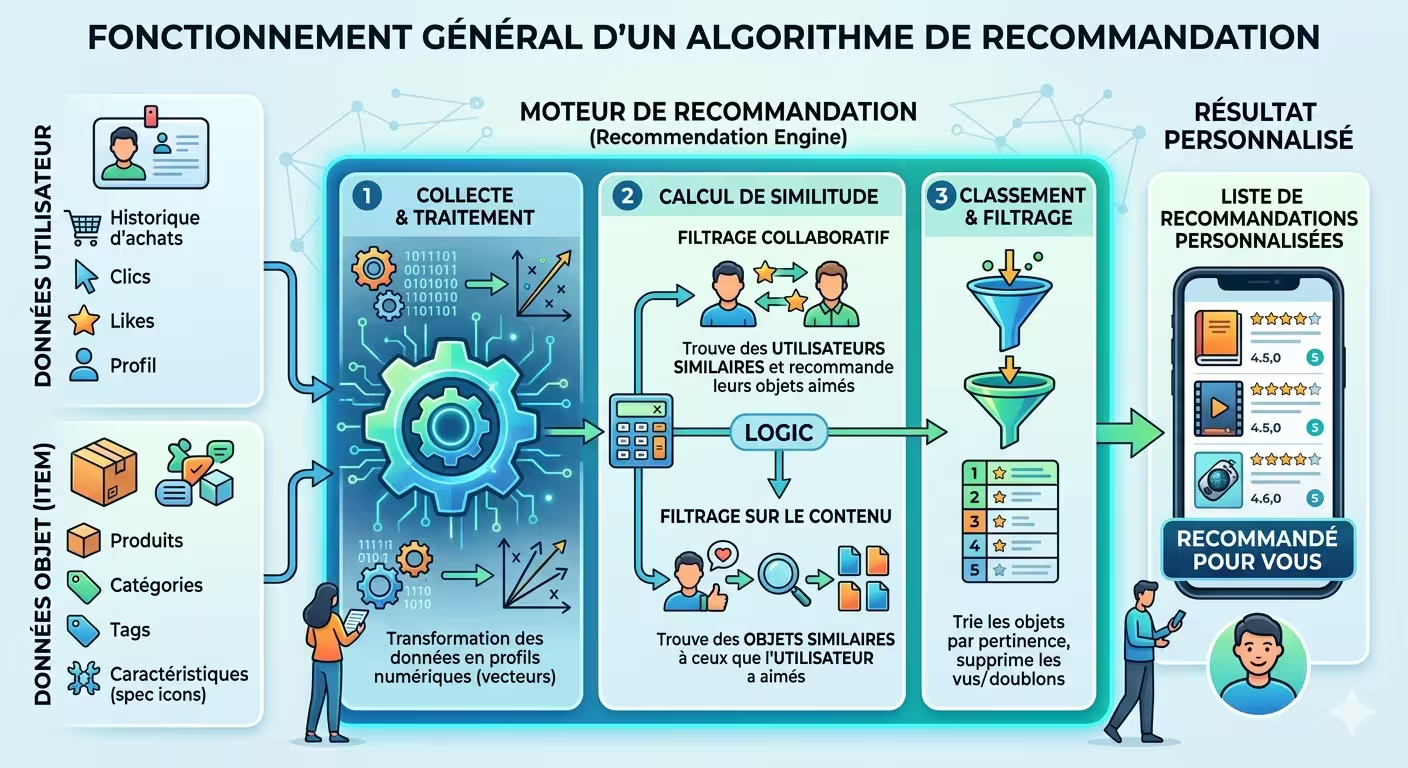

Un algorithme de recommandation est un système informatique qui analyse les données comportementales d’un utilisateur (historique de visionnage, clics, achats, interactions sociales) pour lui proposer des contenus, produits ou services susceptibles de l’intéresser. Son objectif principal est d’augmenter l’engagement, le temps passé sur la plateforme et, in fine, les revenus publicitaires ou commerciaux.

Ces algorithmes sont au cœur du modèle économique des grandes plateformes numériques. Plus ils captent l’attention, plus ils génèrent de données, et plus ils affinent leurs prédictions. C’est un cercle vertueux pour les entreprises, mais potentiellement vicieux pour l’utilisateur.

Les systèmes de recommandation s’appuient sur plusieurs techniques, souvent combinées :

Le filtrage collaboratif repose sur le principe que des utilisateurs aux goûts similaires apprécieront des contenus proches. L’algorithme analyse les comportements d’un groupe d’utilisateurs et propose à un nouvel utilisateur ce que ses « voisins » ont aimé. C’est la technique utilisée par Amazon (« les clients qui ont acheté ce produit ont aussi acheté… »).

Cette approche analyse les caractéristiques intrinsèques des contenus (genre, acteurs, mots-clés, couleurs, etc.) et recommande des éléments similaires à ceux que l’utilisateur a déjà appréciés. Spotify utilise cette méthode pour suggérer des morceaux aux caractéristiques musicales proches (tempo, tonalité, instrumentation).

Les plateformes les plus avancées (TikTok, YouTube, Netflix) utilisent des modèles de deep learning capables d’analyser des données non structurées (images, vidéos, textes) et de détecter des patterns invisibles à l’œil humain. TikTok est réputé pour son algorithme « For You » qui personnalise le flux en quelques secondes, avec une précision redoutable.

L’algorithme apprend en temps réel par essais-erreurs. Il teste différents contenus, observe les réactions (temps de visionnage, likes, partages) et ajuste ses propositions pour maximiser l’engagement. C’est ce qui rend les recommandations si « addictives ».

Plus un algorithme est personnalisé, plus l’utilisateur a l’impression que ses choix sont authentiques et spontanés. Pourtant, ce que nous percevons comme une « décision libre » est souvent le résultat d’une prédiction anticipée. L’algorithme ne nous dit pas quoi faire, mais il réduit considérablement le champ des possibles en ne montrant que ce qui maximise notre engagement.

Les algorithmes nous exposent majoritairement à des contenus qui confirment nos opinions et goûts existants. Ce phénomène renforce le biais de confirmation : nous sommes moins confrontés à des idées divergentes, ce qui peut radicaliser nos positions.

Les systèmes de recommandation utilisent un mécanisme de renforcement intermittent : parfois une vidéo nous passionne, parfois moins. Cette incertitude génère une boucle de dopamine similaire à celle des jeux d’argent. C’est l’un des ressorts de l’addiction aux réseaux sociaux.

Le « doomscrolling » (défilement compulsif de contenus négatifs) est largement alimenté par les algorithmes qui identifient que l’indignation et la peur génèrent un engagement plus fort que les contenus neutres ou positifs.

L’exposition répétée à certains types de contenus modifie nos perceptions et nos préférences sans que nous en ayons conscience. Par exemple, voir fréquemment des vidéos de défis dangereux sur TikTok peut normaliser des comportements à risque chez les adolescents.

Le concept de bulle de filtres, popularisé par Eli Pariser, décrit l’isolement intellectuel progressif dans lequel nous enferment les algorithmes. En nous exposant uniquement à des contenus conformes à nos préférences, ils réduisent notre exposition à la diversité d’opinions et favorisent la polarisation. Les études montrent que les utilisateurs de réseaux sociaux ont des opinions politiques plus extrêmes que la moyenne.

Les recommandations algorithmiques tendent à uniformiser les goûts. Quelques titres deviennent des « hits » mondiaux, tandis que des contenus plus niche peinent à émerger. Sur Netflix, la proportion de films français visionnés a chuté de 15 % entre 2020 et 2025, au profit de productions originales recommandées en priorité.

Amazon estime que 35 % de ses ventes proviennent directement des recommandations. Les algorithmes influencent non seulement ce que nous achetons, mais aussi notre perception des prix (via des suggestions de produits « complémentaires » ou « plus chers que prévu »).

Les recommandations algorithmiques peuvent exacerber l’anxiété, la dépression et les troubles alimentaires. Une enquête du Wall Street Journal (2024) a révélé que l’algorithme de TikTok pouvait orienter des adolescentes vers des contenus pro-anorexie en moins d’une heure d’utilisation.

| Plateforme | Type d’algorithme | Effet sur les choix |

|---|---|---|

| TikTok | Deep learning + renforcement en temps réel | Flux « For You » ultra-personnalisé ; peut orienter les centres d’intérêt en quelques vidéos, créer des addictions comportementales. |

| Netflix | Filtrage collaboratif + segmentation par micro-genres | 75 % des contenus regardés sont recommandés ; influence la diversité culturelle, favorise les productions maison. |

| Amazon | Filtrage collaboratif + « souvent acheté ensemble » | 35 % des ventes issues des recommandations ; influence les achats impulsifs et la perception des besoins. |

| YouTube | Historique + temps de visionnage + optimisation de la durée | Algorithme controversé pour avoir favorisé la radicalisation politique (recommandations de contenus extrêmes). |

| Spotify | Filtrage basé sur le contenu + playlists collaboratives | Les playlists « Découvertes de la semaine » façonnent les goûts musicaux ; homogénéisation des styles populaires. |

Le scandale Cambridge Analytica (2018) a montré comment des algorithmes de recommandation pouvaient être utilisés pour influencer des élections en ciblant des individus avec des contenus politiques personnalisés. Depuis, des études ont confirmé que les algorithmes de YouTube et Facebook favorisent les contenus clivants, car ils génèrent plus d’engagement.

Les systèmes de recommandation peuvent reproduire et amplifier des biais discriminatoires. Par exemple, un algorithme de recrutement recommandant des candidats peut défavoriser certaines origines si les données d’entraînement sont biaisées. Sur les plateformes d’emploi, des annonces peuvent être cachées à certaines catégories d’utilisateurs.

Les utilisateurs n’ont généralement aucun accès aux règles qui déterminent ce qui leur est recommandé. Cette opacité algorithmique rend impossible un véritable consentement éclairé. Le Digital Services Act (DSA) européen impose désormais aux très grandes plateformes une transparence minimale, mais son application reste perfectible.

L’AI Act européen (2024) classe les systèmes de recommandation comme « à risque limité » mais impose une transparence : les plateformes doivent informer les utilisateurs qu’ils sont confrontés à des recommandations algorithmiques et proposer une option sans profilage.

En Europe, le Digital Services Act (DSA) impose désormais aux plateformes de plus de 45 millions d’utilisateurs de fournir une transparence sur leurs algorithmes et de permettre aux utilisateurs de choisir des recommandations non personnalisées. N’hésitez pas à signaler des contenus problématiques et à exercer vos droits d’accès aux données.

La littératie algorithmique est une compétence essentielle. Comprendre comment fonctionnent ces systèmes est la première étape pour ne pas en être la victime passive. Des ressources comme « Algorithmes : comment ils nous contrôlent » (documentaire Arte) ou les cours en ligne sur la data literacy peuvent aider.

Ils peuvent l’être lorsqu’ils favorisent la polarisation, les contenus extrêmes ou la désinformation. Des études ont montré que les algorithmes de YouTube et Facebook tendent à recommander des contenus plus clivants car ils génèrent plus d’engagement. Le DSA européen vise à encadrer ces pratiques.

TikTok utilise un modèle de deep learning ultra-rapide qui personnalise le flux en quelques secondes. Il combine filtrage collaboratif, analyse du contenu (images, sons) et apprentissage par renforcement pour maximiser l’engagement. Le format court et le défilement infini renforcent l’addiction.

Sur certaines plateformes, il est possible de désactiver la personnalisation (paramètres de confidentialité). Sur YouTube, le mode « Incognito » offre une expérience non personnalisée. Cependant, cela ne supprime pas totalement les recommandations, mais les rend plus aléatoires ou basées sur des critères génériques.

Un bon indicateur : si vous avez découvert un contenu via une recherche active (moteur, recherche interne) plutôt que via un flux personnalisé, il est plus probable que le choix soit autonome. Posez-vous régulièrement la question : « Pourquoi ce contenu m’a-t-il été proposé ? »

Oui, c’est une tendance documentée. En recommandant ce qui a déjà plu à un grand nombre, les algorithmes favorisent les contenus mainstream et réduisent la diversité. Sur Spotify, les playlists éditoriales comme « Top 50 » influencent fortement les tendances musicales mondiales.

Une recommandation personnalisée utilise votre historique, vos clics, votre localisation, etc. pour adapter les suggestions. Une recommandation non personnalisée s’appuie sur des critères généraux (tendances globales, nouveautés, choix éditoriaux). Le DSA impose désormais aux très grandes plateformes de proposer un flux non personnalisé en option.

Les algorithmes de recommandation ne sont ni bons ni mauvais en soi. Ils sont le reflet des choix techniques et économiques qui les sous-tendent. Leur influence sur nos choix est réelle, mais pas irréversible. En comprenant leurs mécanismes, en exerçant nos droits numériques et en adoptant des pratiques plus conscientes, nous pouvons retrouver une part d’autonomie dans un monde de plus en plus gouverné par l’intelligence artificielle.

La question n’est plus de savoir si nous sommes influencés, mais dans quelle mesure nous acceptons cette influence et quels garde-fous nous mettons en place pour préserver notre capacité à décider par nous-mêmes.