Recommandations, detection de fraude, maintenance predictive, vision par ordinateur, chatbots : l'IA se voit partout. Mais dans la plupart des cas, ce ne sont pas des tours de magie. Ce sont des modeles appris sur des données, avec des compromis, des couts de mise en production, et une part d'incertitude qu'il faut assumer.

L'apprentissage automatique (machine learning) designe une famille de methodes qui apprennent des regularites dans les donnees afin de produire une decision, une prediction ou un regroupement. La nuance importante : la règle n'est pas ecrite a la main ligne par ligne. Elle est ajustee automatiquement, a partir d'exemples.

Un modele de machine learning est une fonction parametree. Pendant l'entrainement, ses parametres sont ajustes pour minimiser une erreur (ou maximiser une performance) sur des données d'exemples.

Dans le langage courant, on melange souvent trois choses : l'algorithme d'apprentissage (ex : descente de gradient, optimisation), la famille de modeles (ex : regression, arbre de decision, reseau de neurones) et le systeme complet (features, modele, règles métier, surveillance). En entreprise, c'est ce systeme complet qui compte, et c'est lui qui finit par coûter du temps.

Un modele peut apprendre, à partir de transactions historiques et de labels (fraude / non fraude), des signaux statistiques : frequence d'achats inhabituelle, pays incoherent, panier anormal, comportement qui diverge de l'habitude. Le systeme n'est pas "sûr a 100%". Il attribue souvent un score et declenche une vérification, ou applique une règle de blocage si le risque depasse un seuil defini.

Le machine learning ne remplace pas la logique metier : il la complete. Dans beaucoup d'organisations, la meilleure performance vient d'un mix "regles + modele", pas d'un modele laisse seul.

Les ordres de grandeur aident a comprendre pourquoi les organisations investissent, mais aussi pourquoi elles se heurtent a des limites (couts, gouvernance, donnees, talents). Les chiffres ci-dessous viennent de sources publiques (communiques et rapports).

Pour cadrer l'effet "mode" : Gartner indiquait aussi que 30% des projets d'IA générative pourraient etre abandonnes apres POC d'ici fin 2025, notamment à cause de donnees insuffisantes, de controles de risque faibles, de coûts, ou d'une valeur metier mal definie. Autrement dit : l'adoption existe, mais la mise à l'echelle reste difficile.

La programmation traditionnelle fonctionne en géneral sur des regles explicites : si A alors B. Le machine learning, lui, apprend une fonction a partir d'exemples. Cela change la facon de concevoir, tester, et maintenir.

| Aspect | Programmation traditionnelle | Apprentissage automatique |

|---|---|---|

| Source de la logique | Regles codees (specs, logique metier) | Regularites apprises sur des donnees |

| Changement / maintenance | Modifier le code, tests unitaires | Changer donnees, features, hyperparametres, re-entrainer |

| Qualité attendue | Deterministe (souvent) | Probabiliste (taux d'erreur assume) |

| Mesure du succes | Conformite aux specs | Metriques (precision, rappel, AUC, RMSE) + impact metier |

| Risque typique | Bug logique | Donnees biaisees, drift, surapprentissage, fuite de donnees |

En ML, on n'achete pas une verite. On met en place une chaine de production de predictions : collecte, qualité, features, entrainement, evaluation, deploiement, surveillance. Un modele performant le jour 1 peut devenir mediocre le mois 6 si le monde a change (drift), si les données ont derivé, ou si les comportements ont evolué.

L'idee de machines capables d'apprendre existe depuis des decennies. Les reseaux de neurones apparaissent tot (annees 1950), puis connaissent des hivers, puis des retours. Le basculement moderne tient surtout à trois facteurs : données, calcul, et industrialisation logicielle.

Les entreprises enregistrent des traces partout : clics, parcours, logs, capteurs, tickets, emails, images, audio, telemetry. La nouveaute n'est pas uniquement le volume, mais l'abondance de donnees semi-structurees et non structurees, qui rendent les approches à regles très coûteuses à maintenir.

Le deep learning a rendu populaire l'usage intensif de GPU et d'infrastructures distribuees. En parallele, des plateformes cloud et des frameworks (PyTorch, TensorFlow, XGBoost, etc.) ont industrialisé l'entrainement et le deploiement.

La vague 2026 n'est pas seulement "plus de modeles". Elle est "plus de modeles en production", avec des exigences de suivi : metriques, derive, equité, auditabilite, securite. Ce qui etait un notebook devient un produit.

Le sujet est d'exploiter : quelle données, quel cout, quel risque, quelle responsabilite, et quelle preuve de valeur. C'est souvent la que les projets calment l'enthousiasme initial.

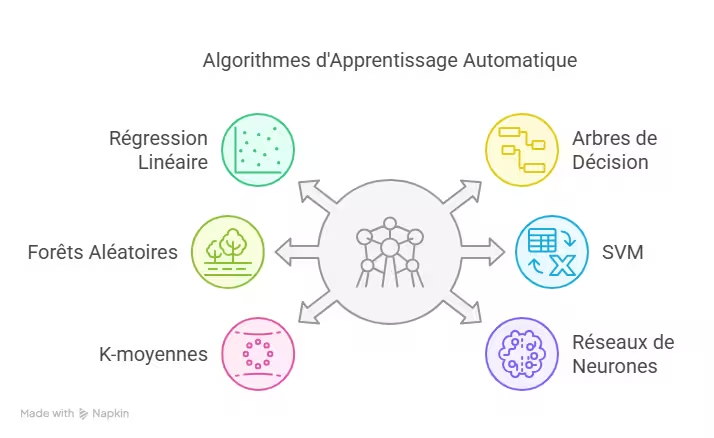

Les noms circulent beaucoup, parfois sans contexte. En pratique, le choix depend du type de probleme (regression, classification, clustering), de la taille des données, de l'exigence d'explicabilité et du budget de calcul.

La regression linéaire reste un classique : robuste, interpretable, rapide. Elle est utile pour donner un premier modele, detecter des tendances, ou servir de baseline. En production, elle est souvent depassee par des methodes non lineaires, mais elle garde un interêt pedagogique et pratique.

Arbres de decision, forets aleatoires et surtout gradient boosting (familles type XGBoost, LightGBM, CatBoost) dominent encore beaucoup de cas tabulaires : scoring, churn, risque, prevision de demande, detection d'anomalies basee sur features. Les raisons sont simples : bonnes performances, gestion de non-linearites, et un compromis acceptable entre vitesse et lisibilite.

Les SVM ont marque l'histoire de la classification. Ils restent utiles sur certains datasets de taille moyenne, avec des frontieres complexes. Mais en très grande dimension et à grande echelle, on leur prefere souvent des methodes boosting ou des reseaux, selon le contexte.

K-means est simple et rapide, mais suppose des groupes "ronds" et une notion de distance coherente. Sur des données riches, d'autres approches (DBSCAN, HDBSCAN, mixtures gaussiennes) sont souvent plus robustes, au prix d'un parametrage plus fin.

Les reseaux de neurones deviennent incontournables dès que les donnees sont non structurees (vision, langage, parole). Avec l'IA generative, ils deviennent aussi une couche de "representation" pour des tâches metier : extraction d'information, resumé, classification de documents, recherche semantique.

Sur beaucoup de projets, l'ecart de performance se joue moins sur "quel algorithme" que sur la qualité des features, la definition du label, la gestion des données manquantes, et la coherence temporelle (eviter d'entrainer avec des infos qui n'existent pas au moment de la prediction).

Pour rendre le ML moins abstrait, il vaut mieux decrire une chaine simple, puis regarder ou elle casse.

"Prédire le churn" semble clair, jusqu'à la question : churn quand ? 7 jours, 30 jours, 90 jours ? et pour quel type de client ? Sans definition precise, on finit avec un modele "bon" sur le papier mais inutilisable.

Les donnees doivent respecter le temps. Si la prediction doit etre faite au jour J, il faut s'assurer que les variables disponibles ne contiennent pas une information du futur (fuite de données). C'est un des pièges les plus fréquents.

Sur donnees tabulaires : encodage des categories, gestion des valeurs rares, normalisation si necessaire, creation de variables derivees (frequences, delais, ratios). Sur texte : representations (TF-IDF, embeddings). Sur images : augmentations, redimensionnement.

Une precision de 95% peut être trompeuse si la classe positive est rare. Dans la fraude, on suit souvent precision et rappel, et surtout le cout des faux positifs et faux negatifs. Dans la prevision, RMSE et MAE ne racontent pas la même histoire si l'on veut penaliser fort les grosses erreurs.

Le modele en production doit être surveillé : derive des données d'entrée, dégrade de performance, latence, taux d'erreur, distributions qui bougent. Sans cette boucle, le ML se degrade en silence.

Si personne n'est capable d'expliquer comment une prediction est produite, comment elle est surveillée, et comment on decide de ré-entrainer, alors le projet n'est pas fini. Il est juste "livre".

En 2026, les cas d'usage se ressemblent souvent dans leur structure : une decision repetee, un risque ou un coût, et assez de données pour apprendre. Les differences viennent des contraintes : temps réel, auditabilité, regulation, et cout d'erreur.

Segmentation, prediction d'achat, recommandation de contenu : le ML s'y justifie parce que les comportements changent vite. Les meilleures approches combinent souvent filtrage collaboratif, modele de ranking, et signaux contextuels.

Capteurs, vibrations, temperature : le ML detecte des anomalies avant la panne. Mais l'etiquetage (connaitre le "vrai" etat) est coûteux, et les données peuvent etre desequilibrees (peu de pannes, beaucoup de normal). Dans ces cas, l'unsupervised et le semi-supervised ont souvent un rôle.

Ici, l'enjeu n'est pas uniquement de predire. Il faut justifier. D'ou la recherche d'explicabilite (XAI), la documentation des variables, et des tests de robustesse. Un modele trop opaque peut etre refusé, meme s'il est un peu meilleur.

Les usages "texte" explosent : classification de tickets, extraction d'entites, recherche semantique, resume, assistance. Souvent, l'architecture gagnante combine un LLM pour comprendre/produire, et un modele plus simple (ou une regle) pour verrouiller la decision (ex : routage, validation, escalation).

Le machine learning evolue moins par "nouvel algorithme magique" que par changement d'architecture, de pratiques et d'usage. En 2026, quatre tendances se voient nettement.

Sur images, texte et audio, il reste dominant. Sur tabulaire, il progresse, mais le boosting reste souvent tres compétitif. Le deep learning devient aussi un outil de representation : embeddings, modeles pre-entraines, puis adaptation à un contexte.

Quand une decision impacte un credit, un recrutement, un remboursement, ou une securité, la question "pourquoi" devient centrale. L'explicabilite peut etre locale (pour ce cas precis) ou globale (comprendre les tendances). En pratique, il faut surtout une documentation : données, transformations, seuils, tests, limites.

Une explication peut etre seduisante mais fausse. L'objectif est plutot de rendre le systeme auditable et testable, avec des hypothèses claires et des garde-fous.

L'approche est utile quand les donnees sont sensibles (sante, finance) ou dispersees (appareils, filiales). On entraine localement, on agrege des mises a jour de parametres. Cela ne supprime pas tous les risques, mais cela change le compromis confidentialite / performance.

Une prediction seule ne fait rien. En 2026, la pression est d'automatiser un bout de workflow : detecter, proposer, executer, puis demander validation. IDC a popularise l'idee d'un basculement vers des agents IA, avec des previsions d'adoption significative a horizon 2027 pour des usages de collaboration humain-machine. L'impact concret : plus de decisions en chaine, donc plus de besoin de controles, traces, et politiques.

Les projets ML echouent rarement parce que "l'algorithme est mauvais". Ils echouent parce que l'organisation n'a pas stabilise le terrain : donnees, objectifs, ownership, et exploitation.

Des valeurs manquantes, des definitions qui changent, des sources non documentees, et des delais d'alimentation : c'est le quotidien. Gartner insiste regulierement sur la question de la confiance et de la maturité : sans donnees fiables et usage accepte par les equipes, l'IA reste un projet "laboratoire".

Le coût n'est pas seulement le calcul. Il y a l'ingenierie data, les pipelines, le monitoring, les tests, et le support. L'IA générative ajoute des couts d'inference (appels, latence), et des risques de sortie (hallucinations, fuites d'information), ce qui oblige a ajouter des couches de controle.

Un modele peut amplifier des biais historiques. Il peut aussi être attaque (prompt injection cote LLM, data poisoning cote ML), ou devenir obsolete. La surveillance n'est pas un "nice to have" : c'est une condition de fiabilité.

Si la valeur metier ne peut pas etre exprimee en termes simples (gain de temps, baisse de pertes, augmentation de conversion, reduction de delais), le projet a de fortes chances de s'enliser. McKinsey souligne d'ailleurs que beaucoup d'organisations utilisent l'IA, mais que la mise à l'echelle et la capture de valeur restent le coeur du sujet.

Les projets qui tiennent dans la durée sont ceux qui traitent l'IA comme un produit : objectifs mesurables, boucle de feedback, gouvernance des données, et une exploitation integree au quotidien.

Les algorithmes d'apprentissage automatique ne sont pas seulement une alternative moderne à la programmation traditionnelle. Ils imposent une autre facon de penser : accepter l'incertitude, mesurer en continu, et investir dans la qualite des donnees. En 2026, le sujet n'est plus de prouver que l'IA existe. Le sujet est de prouver qu'elle tient en production, qu'elle se surveille, qu'elle se justifie, et qu'elle crée une valeur observable.

Le plus étrange, c'est peût-etre cela : le ML semble abstrait, mais il ramène à des questions tres concretes. De quoi a-t-on vraiment besoin ? Qu'est-ce qu'on accepte comme erreur ? Et qui porte la responsabilité quand le modele se trompe ?