ChatGPT peut-il concurrencer Google dans le marché des moteurs de recherche

Une exploration des modèles de langage dans la recherche d’information.

Le langage humain semble évident, fluide, presque instinctif. Pourtant, pour une machine, chaque mot est une énigme, chaque phrase un puzzle. Derrière les assistants vocaux, les traducteurs automatiques ou les chatbots se cache une discipline centrale de l’intelligence artificielle : le traitement du langage naturel.

Le traitement du langage naturel, souvent abrégé en NLP (Natural Language Processing), désigne un ensemble de techniques permettant aux machines de comprendre, d’interpréter et de générer du langage humain. Cela peut sembler simple en apparence, presque trivial — comprendre des mots, des phrases — mais en réalité, il s’agit d’un défi complexe, profondément ambigu.

Comprendre un texte ne consiste pas seulement à reconnaître des mots. Il faut saisir le contexte, les nuances, les sous-entendus. Une phrase comme « il fait froid ici » peut être une simple observation… ou une demande implicite de fermer une fenêtre. Cette ambiguïté permanente rend le langage difficile à formaliser.

Autrement dit, le NLP n’est pas simplement une technique. C’est une tentative — parfois approximative, parfois étonnamment précise — de reproduire une faculté humaine profondément intuitive : la compréhension du sens.

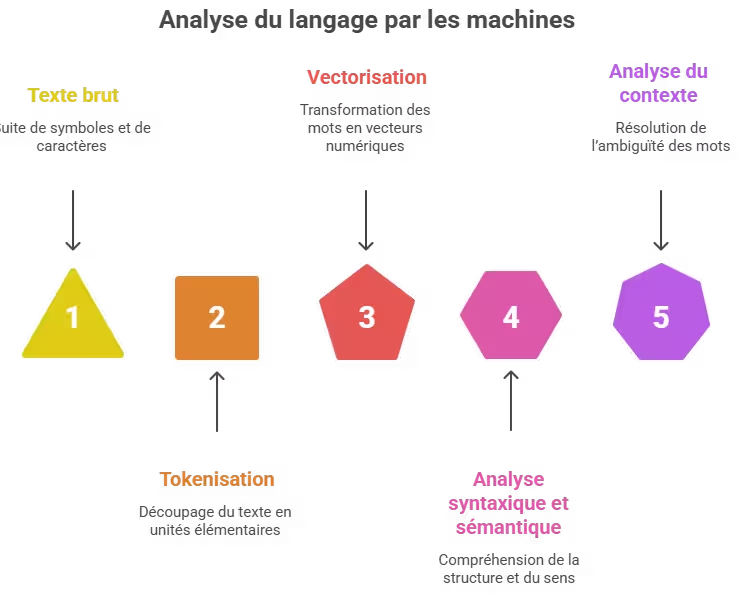

Pour une machine, un texte n’est pas une suite de mots porteurs de sens. C’est, dans un premier temps, une suite de symboles, de caractères, de tokens. Le travail du NLP consiste donc à transformer ces symboles en représentations exploitables.

La première étape consiste à découper le texte en unités élémentaires : mots, sous-mots ou caractères. Ce processus, appelé tokenisation, permet de structurer le texte.

Ensuite, les mots sont transformés en vecteurs numériques. On parle d’embeddings. Chaque mot devient une position dans un espace mathématique. Deux mots proches sémantiquement auront des vecteurs proches.

Les modèles analysent la structure grammaticale (qui fait quoi) et le sens global. Cela implique de comprendre les relations entre les mots, les dépendances, les intentions.

Le contexte est probablement l’élément le plus difficile. Un mot peut changer de sens selon la phrase. Le mot « banque » peut désigner un établissement financier ou un bord de rivière. Les modèles modernes tentent de résoudre cette ambiguïté en analysant l’ensemble de la phrase.

Le NLP a longtemps reposé sur des règles linguistiques. Puis sont venus les modèles statistiques. Aujourd’hui, ce sont les modèles de deep learning, et plus précisément les modèles de langage (LLM), qui dominent.

Ces modèles, comme les transformers, ne comprennent pas réellement le langage au sens humain. Ils apprennent des probabilités. Ils prédisent le mot suivant. Encore et encore.

Mais cette prédiction répétée, cette accumulation statistique, donne l’impression d’une compréhension. Une illusion peut-être, ou une approximation suffisamment bonne pour être utile.

Le NLP est partout, souvent sans être visible. Il s’intègre dans des outils quotidiens, parfois sans que l’on y prête attention.

Les assistants conversationnels utilisent le NLP pour comprendre les requêtes et générer des réponses pertinentes.

Les systèmes modernes traduisent des textes en tenant compte du contexte, et non plus mot à mot.

Les entreprises analysent les avis clients, les réseaux sociaux, pour détecter les émotions et les tendances.

Les moteurs de recherche comprennent mieux les intentions derrière les requêtes.

Le NLP permet de condenser des documents longs en versions synthétiques.

Ces applications montrent une chose : le langage est devenu une interface entre l’humain et la machine. Une interface naturelle, fluide, mais encore imparfaite.

Malgré ses progrès impressionnants, le NLP reste confronté à des obstacles majeurs.

Le langage humain est flou, implicite, contextuel. Les machines peinent encore à gérer ces subtilités.

Les modèles apprennent à partir de données existantes. Ils peuvent reproduire, voire amplifier, des biais sociaux ou culturels.

Une question persiste : les machines comprennent-elles réellement ? Ou simulent-elles une compréhension ? La distinction reste floue.

Le NLP évolue rapidement. Plusieurs tendances se dessinent.

Les systèmes combinent texte, image, audio. Le langage n’est plus isolé, il est intégré dans un ensemble de signaux.

Les modèles s’adaptent aux utilisateurs, à leurs préférences, à leur contexte.

Les coûts de calcul poussent à développer des modèles plus efficaces.

Les enjeux éthiques et juridiques deviennent centraux, notamment en Europe.

Le NLP semble évoluer vers une forme de maturité, mais une maturité fragile, encore instable, encore en construction.

Le NLP ne correspond pas à une intelligence consciente. Il s’agit d’un ensemble de techniques statistiques et algorithmiques qui permettent de traiter le langage. Les modèles peuvent produire des résultats impressionnants, mais ils ne possèdent pas de compréhension au sens humain.

Le NLP est une application du machine learning. Le machine learning fournit les méthodes d’apprentissage, tandis que le NLP se concentre spécifiquement sur le traitement du langage humain.

Le langage est ambigu, contextuel et souvent implicite. Les machines doivent interpréter des significations qui ne sont pas explicitement codées, ce qui rend la tâche complexe.

Oui, fréquemment. Ils peuvent générer des erreurs, des incohérences ou des informations incorrectes, notamment lorsque le contexte est mal interprété.