BigQuery

La puissance SQL serverless dans l’écosystème Google Cloud

BigQuery est un entrepôt de données cloud orienté analytique, conçu pour exécuter des requêtes SQL sur de très gros volumes sans gestion explicite de serveurs. L’approche “serverless” vise à réduire la friction opérationnelle : moins de capacité à dimensionner, moins d’ops, et un time-to-insight rapide.

Ce qui le caractérise

- Serverless : capacité gérée et élasticité selon les workloads.

- SQL standard : adoption facile par les profils BI/data analysts.

- Intégration GCP : pipelines, orchestration, IA et gouvernance dans l’écosystème Google.

- ML “in-warehouse” : entraînement/score via BigQuery ML selon les cas d’usage.

- Modèles de coût : stockage + requêtes (ou capacité selon options), nécessitant une discipline FinOps.

Cas d’usage typiques

- Analyse de logs, événements, IoT et parcours utilisateurs.

- Reporting consolidé (ERP/CRM) et KPI à grande échelle.

- Tableaux de bord (Looker / Tableau) sur modèles BI stables.

- Prédictions et scoring (selon maturité ML et gouvernance).

Les principales alternatives

Amazon Redshift

Redshift est le warehouse AWS historiquement “cluster-based” (MPP), aujourd’hui complété par des options plus élastiques selon les offres et modes d’usage. Il reste très choisi lorsque l’écosystème AWS est dominant (S3, IAM, Glue, Lake Formation), avec une logique d’intégration native.

Forces

- MPP : parallélisation massive des requêtes analytiques.

- Intégration AWS : S3, sécurité, data lake, orchestration.

- Choix de modèles de coût : selon stratégie (à l’usage vs réservé vs provisionné).

Points d’attention

- Selon l’architecture retenue, l’optimisation peut demander plus d’expertise.

- Workloads très “spiky” : la stratégie d’élasticité et le pilotage des coûts comptent énormément.

Snowflake

Snowflake s’est imposé avec une proposition très lisible : séparation du stockage et du calcul, expérience “warehouse” très orientée usage (scaling, isolation des workloads), et forte emphase sur le partage de données et la collaboration inter-équipes/partenaires.

Forces

- Architecture : séparation storage/compute et isolation des charges.

- Multi-cloud : déploiement possible sur plusieurs hyperscalers selon les offres.

- Partage de données : patterns de collaboration et data sharing.

- Usabilité : forte adoption par les équipes BI/SQL.

Points d’attention

- Le coût peut dériver si la gouvernance de la consommation (jobs, tailles, concurrence) est faible.

- Certains cas avancés (lakehouse/ML temps réel) peuvent nécessiter une architecture complémentaire.

Azure Synapse Analytics

Synapse vise l’analytique à grande échelle dans l’écosystème Microsoft : intégration Power BI, Azure ML, et environnements data d’entreprise. Il est souvent évalué lorsque l’organisation est déjà “Microsoft-centric”.

Forces

- Écosystème Microsoft : Power BI, Azure ML, identités, gouvernance.

- Options SQL : selon scénarios (dont approches serverless pour certains usages).

- Hybride : combine plusieurs modes de traitement et d’intégration.

Points d’attention

- La mise en place peut être plus exigeante pour de petites équipes.

- Les performances varient fortement selon le mode choisi, le modèle de données et les patterns de requêtes.

Databricks

Databricks est souvent positionné “lakehouse” : traitement distribué (Spark), ingénierie de données, notebooks collaboratifs, et ML/IA au cœur. Databricks s’illustre particulièrement sur les pipelines complexes, la donnée semi-structurée, et les cas où l’analytique et l’IA se mélangent.

Forces

- Data engineering + ML : plateforme unifiée orientée pipelines et IA.

- Multi-langage : Python, SQL, Scala, R.

- Collaboration : notebooks, jobs, workflows de bout en bout.

Points d’attention

- Moins “plug-and-play BI” qu’un warehouse SQL pur, selon le niveau d’exigence BI.

- Exige souvent plus d’expertise pour tirer le meilleur (architecture, formats, optimisation, coûts).

Benchmarks publics : que regarder (et comment éviter les pièges)

Les benchmarks sont utiles, mais ils sont rarement “neutres” par défaut. Certains sont officiels et audités (ex. TPC), d’autres sont publiés par des éditeurs, intégrateurs ou outils tiers. La bonne posture consiste à : comparer des méthodologies, répliquer (quand c’est possible), et relier les résultats au coût.

Références utiles et récentes

- TPC-DS (officiel) : le TPC rappelle explicitement que les résultats ne sont comparables que dans des périmètres stricts (version du benchmark, taille de base, etc.).

- Études “terrain” : certains benchmarks comparent plusieurs plateformes en coût/perf sur workloads analytiques, mais il faut lire les hypothèses (volumes, concurrence, choix d’optimisations).

- Benchmarks “workloads réels” : intéressants pour la prise de décision, mais plus sensibles aux biais de mise en œuvre (schémas, clustering, partitionnement, tuning).

Comparaison synthétique

| Critère | BigQuery | Amazon Redshift | Snowflake | Azure Synapse | Databricks |

|---|---|---|---|---|---|

| Modèle | Warehouse serverless | MPP (cluster + options élastiques selon offres) | Cloud-native (storage/compute séparés) | Approches multiples (dont SQL serverless selon scénarios) | Lakehouse (Spark + SQL + ML) |

| Prise en main | Très rapide (SQL + peu d’ops) | Variable (selon architecture et tuning) | Très orienté “usabilité warehouse” | Variable (intégration Microsoft forte) | Plus technique (mais très puissant) |

| BI / SQL ad hoc | Très fort | Fort | Très fort (isolation workloads) | Fort si bien configuré | Bon, mais dépend du design lakehouse |

| ML / IA | ML in-warehouse selon cas | Plutôt via services AWS adjacents | Capacités selon écosystème | Intégration Azure ML | Très fort (ML/engineering natifs) |

| FinOps / coût | Très dépendant des requêtes / options | Flexible (réservé/provisionné/usage) | Peut grimper vite si usage intensif | Variable selon modes | Variable selon clusters/jobs |

| Meilleur “fit” | Analytics serverless GCP | Stack AWS et MPP | Warehouse multi-cloud, data sharing | Stack Microsoft entreprise | Lakehouse, pipelines + IA |

Choisir la bonne plateforme : questions qui tranchent

- Quel est le profil de workload ?

Requêtes BI répétables, SQL ad hoc, transformations ELT, data science, streaming, data lake/lakehouse. - Variabilité et concurrence ?

Pics imprévisibles, multi-équipes, isolation des workloads, exigences de latence. - Formats et gouvernance ?

Parquet/Iceberg/Delta, catalogues, lineage, politiques d’accès, souveraineté, audit. - Compétences internes ?

SQL-only, data engineering avancé, Spark, FinOps, MLOps. - Budget et pilotage des coûts ?

Mécanismes de quotas, alerting, optimisation des requêtes, scheduling, choix capacity vs on-demand.

Tendances marché : ce qui influence les choix en 2026

Les dynamiques de marché pèsent indirectement sur les décisions : disponibilité de compétences, maturité des écosystèmes, profondeur des services managés, et trajectoires d’investissement (notamment IA). Le “Big Three” cloud (AWS, Microsoft, Google) continue de concentrer la majorité des dépenses d’infrastructure cloud, et la croissance est fortement tirée par l’IA.

À un autre niveau, des signaux de popularité (non financiers) comme les classements DB-Engines donnent un aperçu de la visibilité et de la présence des technologies dans l’écosystème (recherche, emplois, communautés, etc.), sans pour autant remplacer une étude de marché ou un benchmark technique.

Conclusion

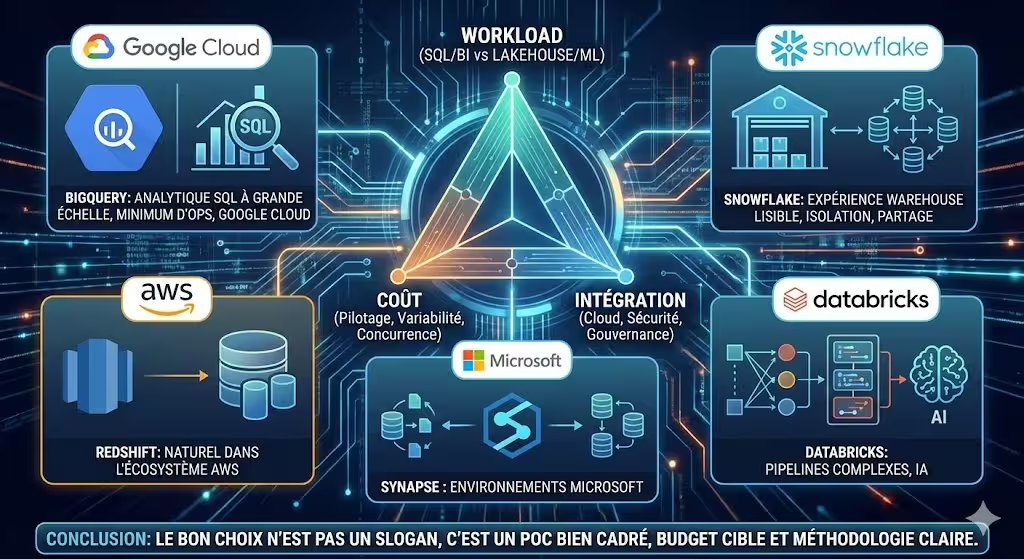

BigQuery est un excellent choix lorsque l’objectif est d’exécuter de l’analytique SQL à grande échelle avec un minimum d’ops, surtout dans une organisation déjà centrée sur Google Cloud. Snowflake attire par son expérience “warehouse” très lisible et ses mécaniques d’isolation et de partage. Redshift reste naturel dans un écosystème AWS, Synapse s’insère logiquement dans les environnements Microsoft, et Databricks se distingue dès que la plateforme doit porter des pipelines complexes et de l’IA.

Le bon choix dépend moins d’un slogan que d’un triptyque : workload (SQL/BI vs lakehouse/ML), coût (pilotage, variabilité, concurrence), intégration (cloud, sécurité, gouvernance). Un POC bien cadré, adossé à un budget cible et une méthodologie claire, reste la décision la plus fiable.