Impact du Big Data sur la prise de décision stratégique

Comment les données structurées par vos pipelines influencent les décisions en entreprise et créent un avantage compétitif.

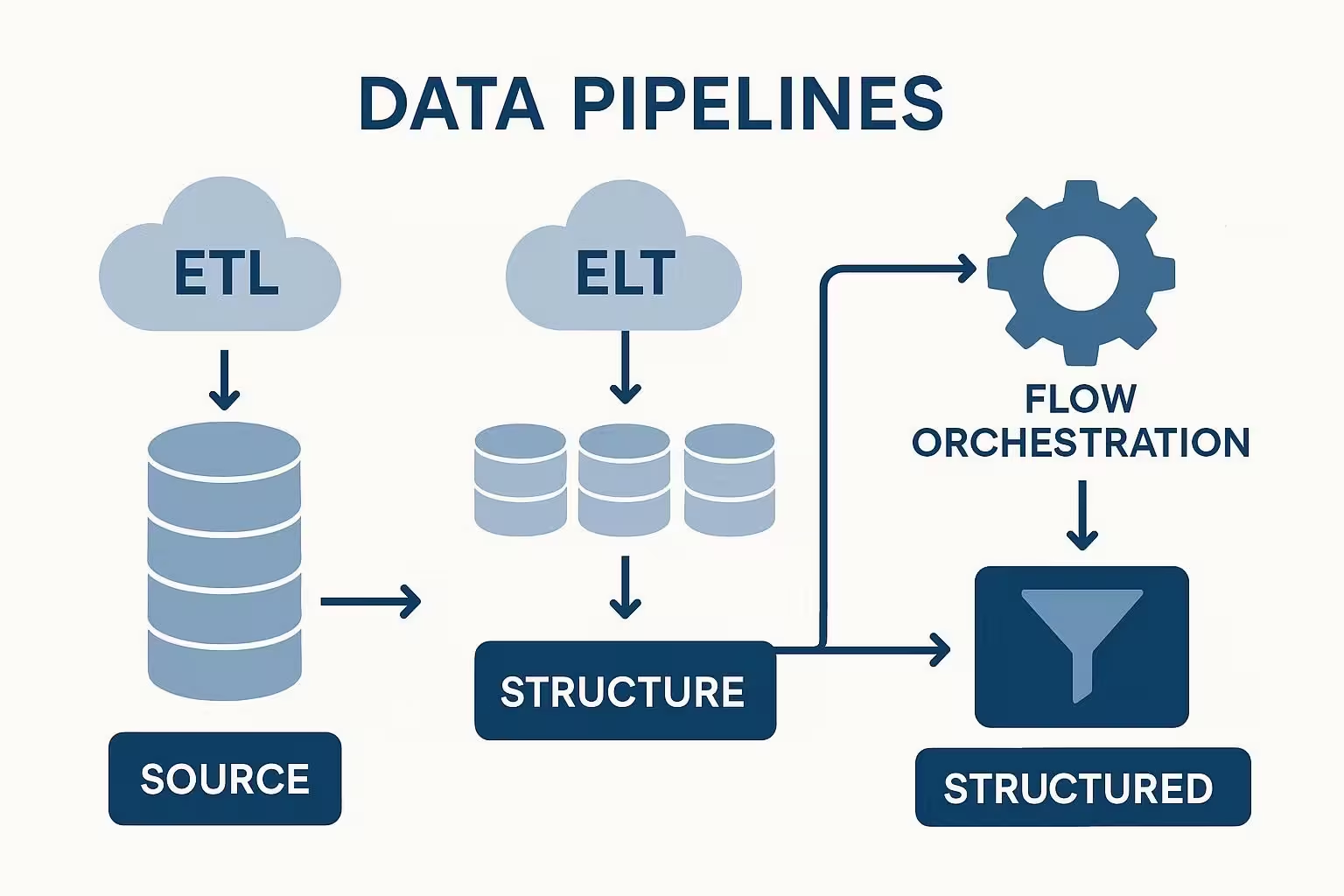

Les données ne circulent pas seules. Elles traversent des systèmes, passent par des étapes, subissent des transformations. Derrière chaque tableau de bord, chaque modèle prédictif, il existe un chemin invisible : le pipeline de données. Cet article explore en profondeur les mécanismes, les architectures et les défis de ces infrastructures critiques qui transforment des données brutes en actifs stratégiques exploitables.

Un pipeline de données est une chaîne de traitement permettant de collecter, transformer et acheminer des données d’un point A à un point B. Mais cette définition reste presque trop simple. Car en réalité, un pipeline n’est pas une simple succession d’étapes. C’est une architecture, une mécanique, parfois fragile, souvent critique. Il représente l'épine dorsale de l'architecture data d'une entreprise, un système automatisé et reproductible conçu pour déplacer des données de manière fiable et efficace.

Les données peuvent provenir de multiples sources, aussi diverses que complexes : bases de données relationnelles (PostgreSQL, MySQL), bases NoSQL (MongoDB, Cassandra), API REST ou GraphQL, flux de données en continu (Kafka, Kinesis), fichiers plats (CSV, JSON, Parquet) déposés sur des stockages cloud (AWS S3, Google Cloud Storage), ou encore des données issues de capteurs IoT. Une fois collectées, elles doivent être nettoyées des anomalies et doublons, transformées pour correspondre à un modèle cohérent, enrichies par croisement avec d'autres données, puis stockées dans des systèmes optimisés pour l'analyse, comme des entrepôts de données (data warehouses) ou des lacs de données (data lakes).

Autrement dit, le pipeline est ce qui rend les données utilisables. Sans lui, les données restent brutes, dispersées, difficilement exploitables. Un pipeline bien conçu assure non seulement le transport, mais aussi la qualité et la traçabilité des données, garantissant ainsi que les équipes métier, les data scientists et les analystes puissent travailler sur des informations fiables et à jour. Il est le garant de la valeur finale des données.

L'ETL (Extract, Transform, Load) est une approche historique et toujours très répandue du traitement des données. Elle repose sur trois étapes séquentielles et distinctes, où la transformation est au cœur du processus, agissant comme un sas de purification avant le stockage final.

Les données sont récupérées depuis différentes sources : bases relationnelles via des requêtes SQL, fichiers plats lus par des scripts, API sollicitées pour récupérer des données json, ou flux de clics depuis des serveurs web. L'enjeu de cette phase est de minimiser l'impact sur les systèmes sources tout en capturant les données de manière fiable et incrémentale.

C'est l'étape centrale et souvent la plus complexe. Les données sont nettoyées (suppression des valeurs nulles aberrantes, correction des formats), enrichies (jointures avec des tables de référence, calculs de nouveaux indicateurs), agrégées (sommes, moyennes) et validées selon des règles métier. Cette étape se fait dans un moteur de transformation dédié, souvent externe à la destination finale, sur des serveurs de traitement dédiés.

Une fois les données transformées et structurées selon le modèle cible (souvent un modèle en étoile pour l'analyse), elles sont chargées dans un data warehouse. Ce chargement peut être un écrasement complet (full load) pour les petites tables de dimensions ou un chargement incrémental pour les grandes tables de faits.

L’ETL est particulièrement adapté lorsque les transformations sont lourdes et doivent être contrôlées en amont, par exemple dans des secteurs fortement réglementés comme la finance ou la santé où la qualité et la traçabilité des données sont primordiales avant le stockage. Il permet de n'envoyer que des données "propres" dans l'entrepôt, simplifiant ainsi son schéma et les requêtes ultérieures. Mais cette approche peut devenir un goulot d'étranglement et une source de rigidité, surtout avec des volumes croissants et des besoins d'agilité.

L’ELT (Extract, Load, Transform) modifie l’ordre classique, profitant de la puissance de calcul des entrepôts de données modernes. Les données sont d’abord chargées dans leur état brut, puis transformées directement au sein de la plateforme de stockage.

Les données sont extraites depuis les sources, comme dans l'approche ETL, mais souvent avec l'objectif de les déverser dans un système de stockage centralisé sans les modifier.

Elles sont immédiatement stockées dans leur forme brute (raw) dans un data lake (comme Amazon S3, ADLS) ou un data warehouse moderne (comme Snowflake, Google BigQuery, Amazon Redshift). On parle alors de "landing zone" ou de zone brute.

Les transformations sont réalisées directement dans l’infrastructure cible en utilisant son propre moteur de calcul (ex: SQL sur BigQuery, procédures sur Snowflake). Les données brutes sont lues, transformées, et le résultat est ré-écrit dans des tables "nettoyées" ou "modélisées" au sein du même système.

Cette approche est rendue possible par la puissance des systèmes modernes (cloud, moteurs distribués, séparation du stockage et du calcul). L'entrepôt lui-même devient le moteur de transformation, éliminant le besoin d'un outil ETL séparé et souvent coûteux.

Elle offre plus de flexibilité, notamment pour les équipes de data science qui ont besoin d'accéder aux données les plus granulaires. Cependant, cette flexibilité nécessite une gouvernance rigoureuse. Sans elle, la zone brute peut rapidement se transformer en "data swamp" (marécage de données) où il est difficile de trouver, comprendre et faire confiance aux données disponibles. La gestion des métadonnées et du cycle de vie des données devient donc cruciale.

| Critère | ETL | ELT |

|---|---|---|

| Ordre des étapes | Transformation avant chargement | Transformation après chargement |

| Performance | Limitée par l’infrastructure ETL (serveur dédié). Le temps de traitement est lié à la puissance de ce serveur. | Optimisée par la puissance de calcul scalable du cloud. La performance est proportionnelle aux ressources allouées dynamiquement. |

| Flexibilité | Moins flexible. Le schéma de destination est défini en amont. Toute nouvelle analyse peut nécessiter de re-exécuter des transformations lourdes. | Très flexible. Les données brutes sont disponibles pour tout type d'analyse future. On peut créer de nouvelles tables transformées à la demande. |

| Stockage | Stocke principalement des données transformées et agrégées, optimisées pour des requêtes connues. Les données brutes sont souvent perdues après transformation. | Stocke d'abord les données brutes, puis les données transformées. On conserve une copie fidèle et complète des données sources. |

| Gouvernance et Séc. | Plus simple à contrôler car les données sont "pré-nettoyées" avant d'entrer dans l'entrepôt. Moins de risques de voir des données sensibles brutes. | Plus complexe. Nécessite des politiques fines de gestion des accès au niveau des fichiers bruts et des tables transformées (ex: masking, row-level security). |

| Cas d’usage | Systèmes traditionnels, secteurs réglementés (banque, assurance), besoins avec des transformations métier très complexes et en amont. | Big Data, analytics moderne, data science, environnements cloud-native, besoins d'agilité et d'exploration de données. |

Le choix entre ETL et ELT dépend du contexte, des volumes, des compétences des équipes et des objectifs analytiques. De nombreuses organisations adoptent une approche hybride, utilisant l'ELT pour l'ingestion massive et des transformations légères, et l'ETL pour des traitements complexes et spécifiques en aval.

Un pipeline isolé est déjà complexe. Mais dans la réalité, les pipelines sont multiples, interdépendants. Une tâche peut dépendre de la réussite de plusieurs autres, et des pipelines entiers peuvent s'exécuter selon des calendriers complexes. C’est ici qu’intervient l’orchestration.

L’orchestration consiste à planifier, coordonner et superviser les différentes étapes d'un ou plusieurs pipelines. Elle est au système de données ce qu'un chef d'orchestre est à un orchestre : elle garantit que chaque instrument (tâche) joue sa partition au bon moment, en harmonie avec les autres.

Les outils d’orchestration, comme Apache Airflow, Prefect, Dagster ou AWS Step Functions, permettent :

Sans orchestration, les pipelines deviennent difficiles à maintenir, voire instables. La gestion se fait manuellement via des scripts cron, ce qui conduit rapidement à un enchevêtrement de dépendances non documentées, des échecs silencieux et une incapacité à garantir la fiabilité des données livrées aux équipes métier. L'orchestration est donc un pilier de la "dataOps".

Un pipeline moderne, souvent déployé dans le cloud, repose sur plusieurs composants interconnectés, formant une architecture modulaire et scalable :

La couche d'ingestion est responsable de la capture des données depuis les sources. On distingue l'ingestion par lots (batch) pour des volumes historiques, et l'ingestion en continu (streaming) pour des données en temps réel (ex: clics utilisateurs, logs serveur) via des outils comme Apache Kafka, Amazon Kinesis ou Google Pub/Sub.

Une fois ingérées, les données atterrissent dans une couche de stockage. Cela peut être un data lake (stockage de fichiers bruts, souvent en colonne comme Parquet) pour la flexibilité et le coût, un data warehouse (stockage structuré et optimisé pour les requêtes analytiques SQL), ou une combinaison des deux formant une architecture "lakehouse" (comme Delta Lake, Apache Iceberg).

C'est la couche où la valeur est ajoutée. Elle inclut le nettoyage, la déduplication, l'enrichissement, l'agrégation et la modélisation des données (ex: transformation en modèles en étoile ou Data Vault). Les outils comme dbt (data build tool) sont devenus populaires pour versionner, tester et documenter ces transformations SQL directement dans le data warehouse.

Comme vu précédemment, l'orchestrateur (Airflow, Dagster) est le chef de file. Il programme et déclenche les jobs d'ingestion et de transformation, gère leurs dépendances, et assure la reprise sur erreur. C'est le système nerveux central de l'architecture.

Enfin, les données transformées et fiabilisées sont exposées aux consommateurs finaux. Cela peut passer par des bases de données serving (pour des applications), des API, des outils de business intelligence (Tableau, Power BI) pour les dashboards, ou directement accessibles par des data scientists pour l'entraînement de modèles.

Ces composants forment une architecture modulaire, évolutive, souvent distribuée. Chaque couche peut être dimensionnée indépendamment, offrant ainsi une grande flexibilité et résilience à l'ensemble du système.

Construire et maintenir un pipeline efficace implique de relever plusieurs défis techniques et organisationnels.

Le système doit s’adapter à l’augmentation des volumes de données sans perte de performance ni explosion des coûts. Cela implique de concevoir des pipelines capables de traiter des lots de données de plus en plus gros et un nombre croissant de sources. Les architectures cloud et l'utilisation de formats de fichiers performants (Parquet, ORC) sont des leviers clés.

Les pipelines sont sujets à des pannes : sources de données indisponibles, données mal formées, bugs de code, pannes d'infrastructure. Les erreurs doivent être détectées et corrigées rapidement. La mise en place de systèmes de surveillance et d'alerte proactifs, ainsi que des mécanismes de "retry" (réessais) et de "dead letter queues" (files d'attente pour messages en échec) sont essentiels.

Un pipeline qui tourne mais produit des données erronées est pire qu'un pipeline en panne. Les données doivent être fiables et cohérentes. Il est crucial d'intégrer des tests de qualité tout au long du pipeline : validation des contraintes d'unicité, tests de non-nullité, vérification des agrégats, détection des anomalies statistiques. Des outils comme Great Expectations ou Soda permettent d'automatiser ces tests.

Pour garantir fiabilité et qualité, il faut pouvoir "voir" ce qui se passe à l'intérieur du pipeline. L'observabilité va au-delà de la simple surveillance. Elle permet de comprendre l'état de santé, les performances et les tendances. Elle inclut le suivi des temps d'exécution, la traçabilité des données (lignage ou "data lineage" : d'où viennent les données et comment elles ont été transformées), et la détection proactive des anomalies de volume ou de distribution.

Malgré tous les efforts, les pipelines de données restent des systèmes complexes qui peuvent présenter des difficultés.

L'accumulation de pipelines mal documentés, aux logiques obscures, et maintenus par un nombre restreint de personnes est un classique. Cette dette technique se traduit par une rigidité accrue, une difficulté à intégrer de nouvelles sources ou à modifier les transformations existantes, et une dépendance à des "experts" historiques.

Dans le cloud, la facture peut rapidement s'envoler si les pipelines ne sont pas optimisés. Des requêtes SQL inefficaces, un stockage de données intermédiaires non nettoyées, ou des clusters de calcul laissés allumés inutilement peuvent générer des coûts cachés importants. Une gestion fine des ressources et une optimisation continue sont nécessaires.

Le choix entre traitement par lots (batch) et en continu (streaming) est souvent un compromis difficile. Le batch est plus simple à mettre en œuvre et à garantir, mais introduit de la latence. Le streaming permet des analyses en temps réel mais complexifie l'architecture (gestion de l'état, des fenêtres temporelles, des arrivées en désordre) et peut être plus coûteux.

La gestion des pipelines est donc un équilibre subtil entre performance, coût, maintenabilité et agilité. Cela nécessite une veille technologique constante et une culture d'amélioration continue au sein des équipes data.

ETL transforme les données avant leur stockage dans un entrepôt dédié, nécessitant un moteur de transformation externe. ELT, lui, charge d'abord les données brutes dans un entrepôt moderne ou un data lake, et utilise la puissance de calcul de ce système pour les transformer ensuite. Le choix dépend des volumes, de la flexibilité nécessaire et de l'infrastructure cible.

Pour automatiser, coordonner et surveiller les pipelines, en garantissant leur bon fonctionnement. Un orchestrateur remplace les scripts manuels et les tâches cron, en gérant les dépendances complexes entre les jobs, la planification, la reprise sur erreur, et en offrant une visibilité centralisée sur l'ensemble des flux de données. C'est le garant de la fiabilité opérationnelle.

Dès qu'il y a plusieurs sources et transformations, un pipeline devient indispensable pour structurer les flux. Pour un simple export ponctuel d'une table vers un fichier, un script peut suffire. Mais dès que les données sont utilisées de manière régulière pour des reportings, qu'elles proviennent de plusieurs endroits, ou qu'elles doivent être nettoyées, un pipeline (même simple) est la seule façon de garantir un processus reproductible, fiable et maintenable.

Pas totalement. Les deux approches coexistent selon les besoins et les contraintes techniques. L'ELT est devenu le standard pour de nombreux cas d'usage dans le cloud grâce à sa flexibilité. Cependant, l'ETL reste pertinent dans des environnements on-premise legacy, pour des transformations extrêmement lourdes qui pourraient saturer un entrepôt, ou dans des contextes où l'on ne souhaite pas exposer de données brutes sensibles dans l'entrepôt. On observe souvent une combinaison des deux.