Corrélation et causalité : comprendre la différence

L'article pilier – la distinction fondamentale entre corrélation et causalité.

Comment passer de la corrélation à la causalité ? Découvrez les méthodes clés (A/B test, variables instrumentales, différence-en-différences, RDD) expliquées simplement, sans code complexe.

L'inférence causale est l'ensemble des méthodes statistiques qui permettent de répondre à une question fondamentale : "Cette action a-t-elle vraiment causé ce résultat ?"

L'inférence causale, c'est l'art de répondre à la question "Que se serait-il passé si... ?"

- Si on n'avait pas lancé cette campagne marketing ?

- Si ce patient n'avait pas reçu ce traitement ?

- Si cette loi n'avait pas été votée ?

Pourquoi c'est important en entreprise ?

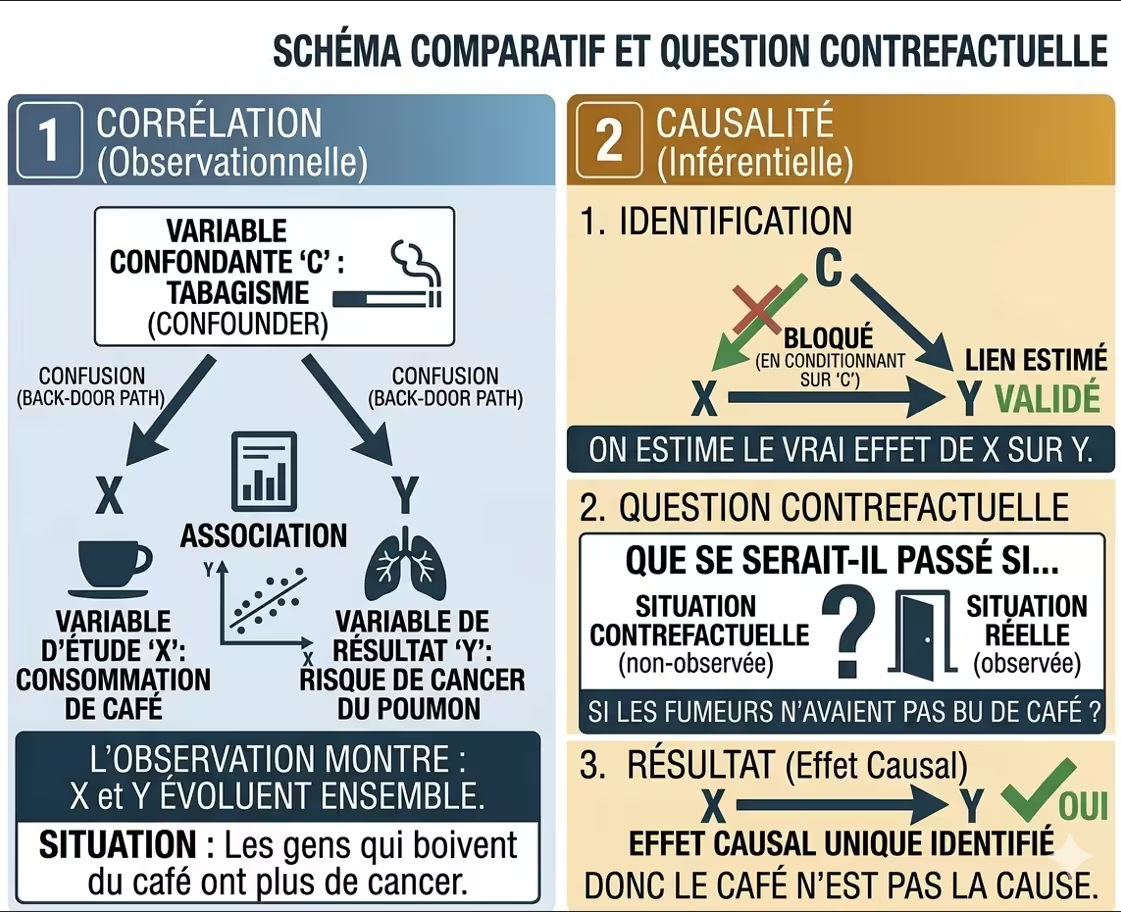

Schéma comparatif corrélation / causalité (Assisté Nano Banana 2)

Pour savoir si un traitement a causé un effet, il faudrait observer la même personne dans deux mondes parallèles : un où elle reçoit le traitement, un où elle ne le reçoit pas. C'est impossible. L'inférence causale contourne ce problème par des méthodes astucieuses.

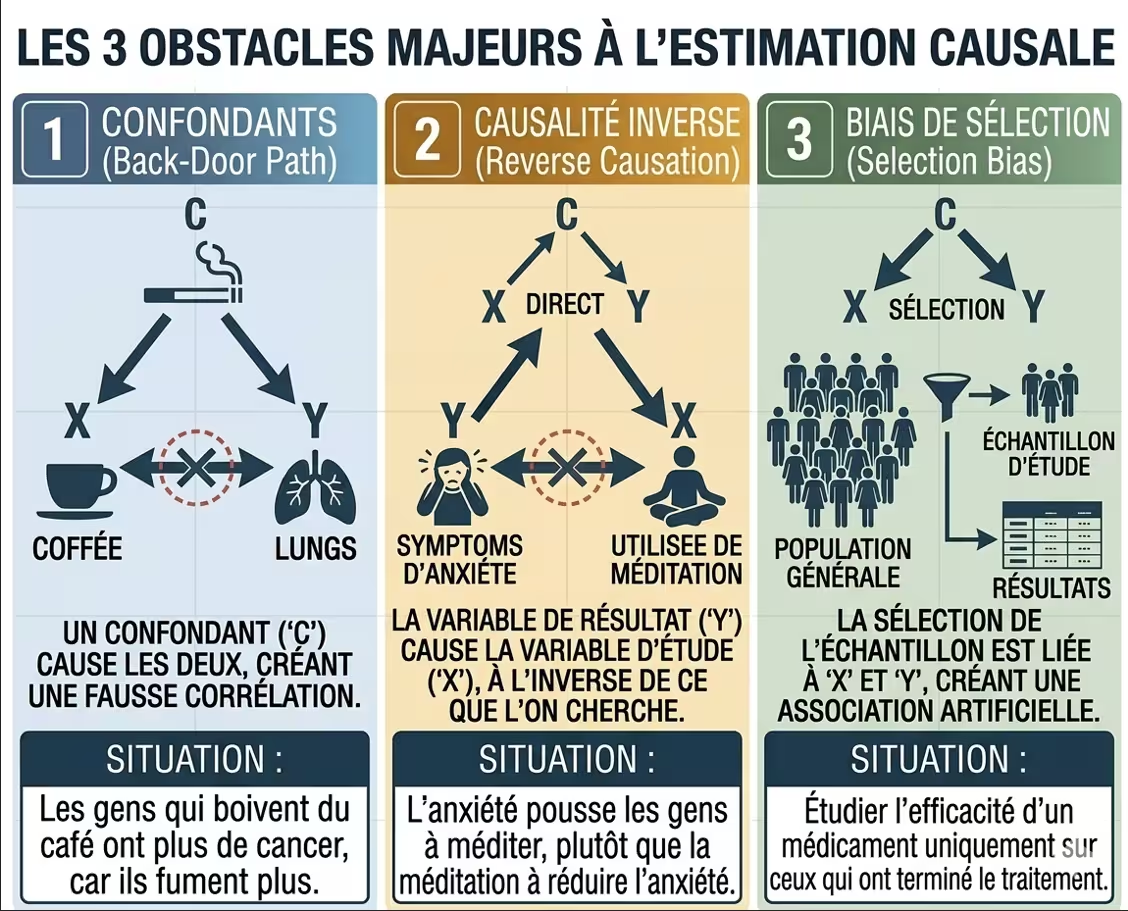

Les 3 obstacles principaux :

Illustration des obstacles à la preuve causale (Assisté Nano Banana 2)

Exemple concret : Une entreprise veut savoir si un nouveau bouton d'achat augmente les ventes. Elle montre la nouvelle version à 50% des visiteurs (groupe test) et l'ancienne à 50% (groupe contrôle). La seule différence entre les groupes est le bouton. Si les ventes augmentent, c'est bien le bouton qui cause la hausse.

Forces :

Faiblesses :

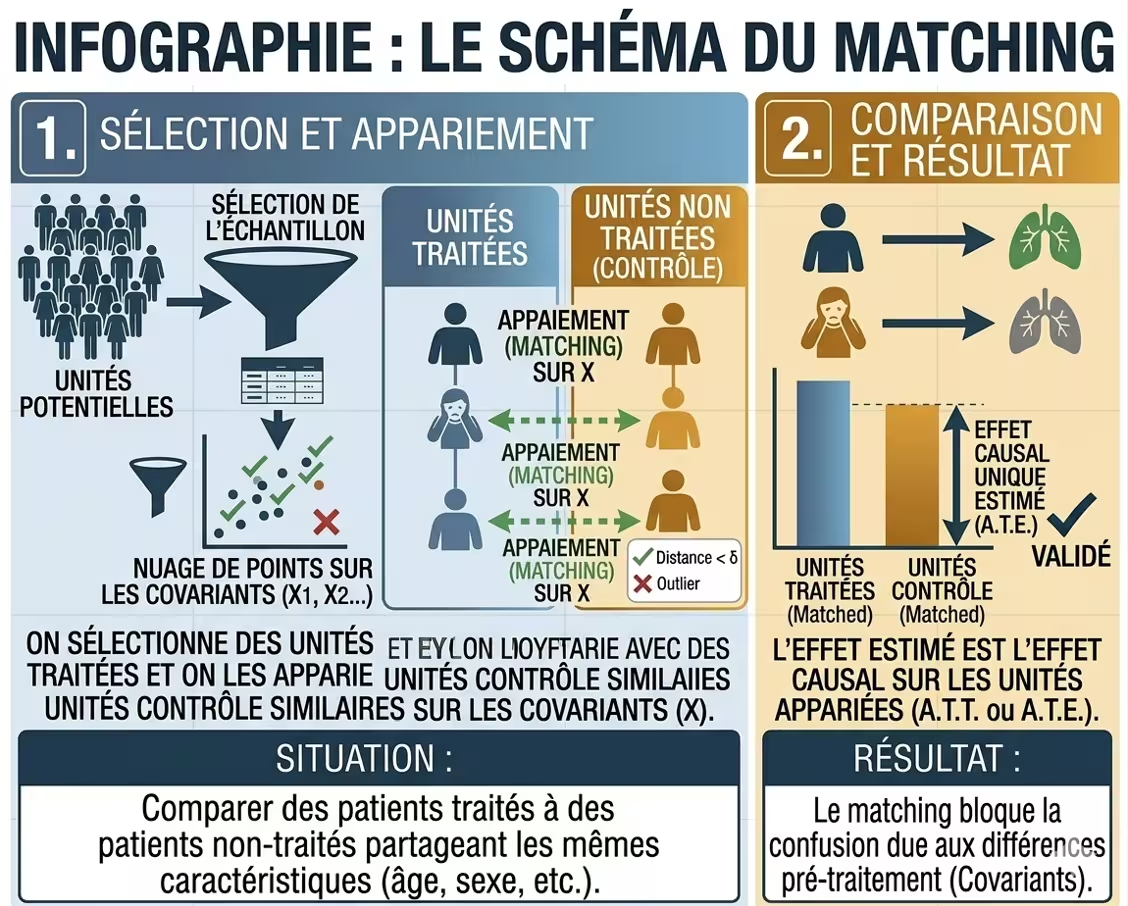

Exemple concret : Une étude veut mesurer l'effet d'une formation professionnelle sur le salaire. On ne peut pas forcer des gens à suivre la formation au hasard. On apparie chaque personne formée avec une personne non formée qui a le même âge, le même niveau d'études, la même expérience. On compare ensuite leurs salaires.

Forces :

Faiblesses :

Illustration du matching entre deux groupes (Assisté Nano Banana 2)

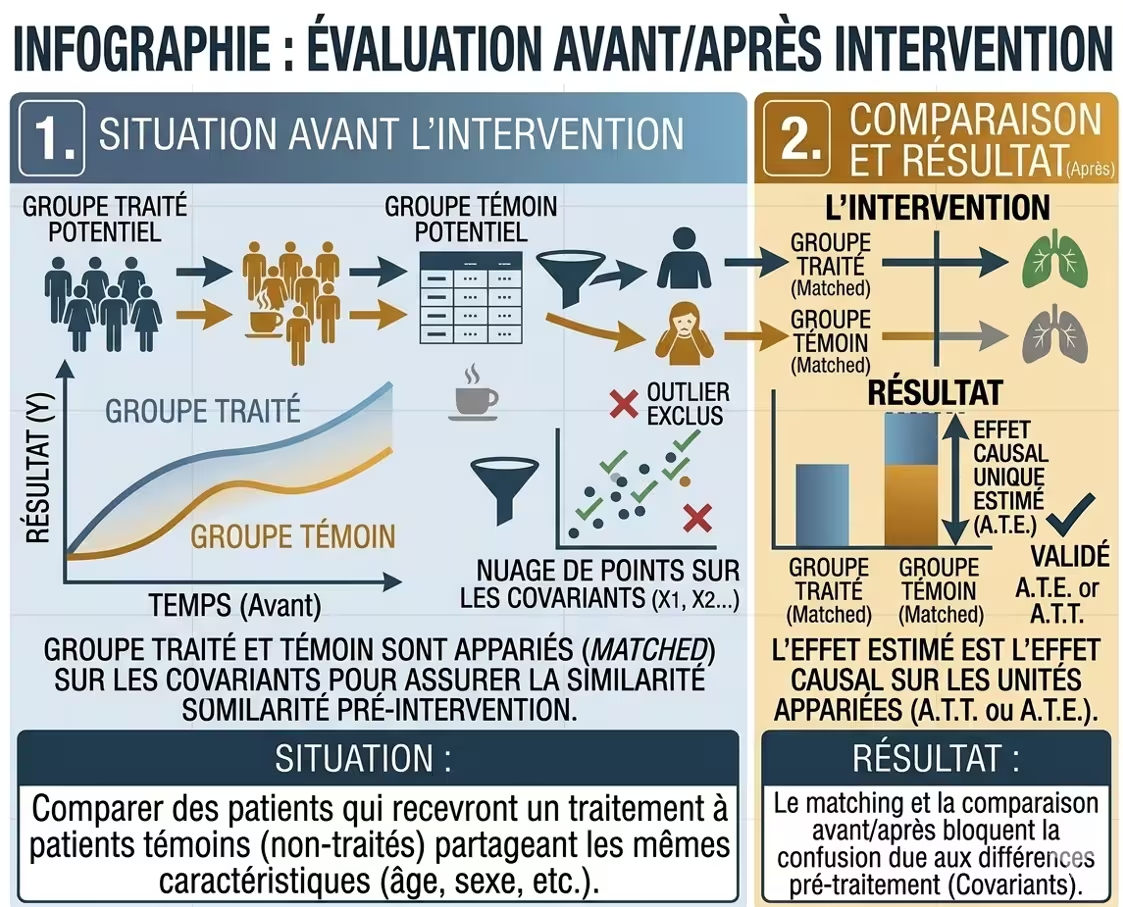

Exemple concret : Une région augmente le salaire minimum, la région voisine non. On compare l'évolution de l'emploi dans les deux régions avant/après la réforme. La différence entre les deux évolutions est l'effet causal de la hausse du salaire minimum.

Forces :

Faiblesses :

Graphique avec deux courbes (traité/témoin) avant/après (Assisté Nano Banana 2)

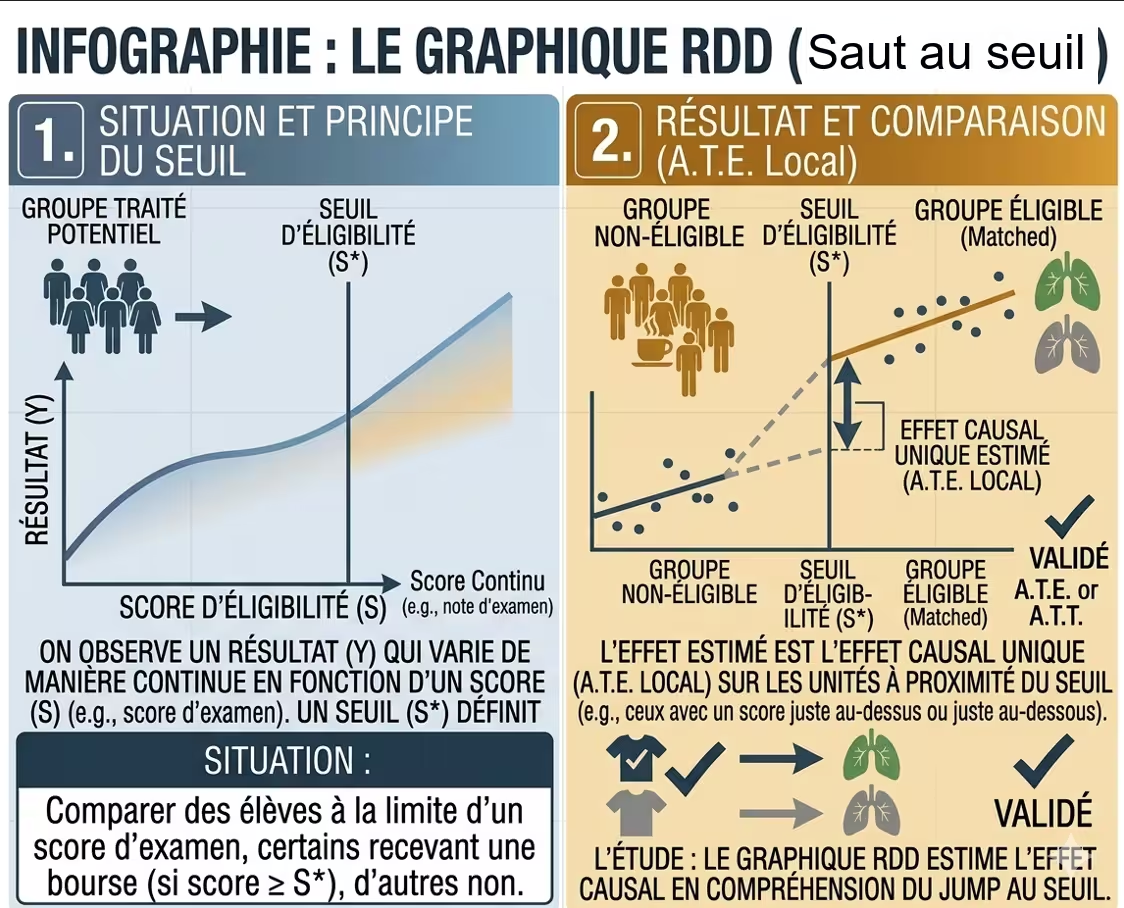

Exemple concret : Une bourse est attribuée aux étudiants ayant plus de 12/20. On compare les étudiants qui ont 12,1 (boursiers) à ceux qui ont 11,9 (non boursiers). Ces deux groupes sont très similaires en capacités, seule la bourse les distingue. La différence de réussite future est l'effet causal de la bourse.

Forces :

Faiblesses :

Graphique avec rupture de pente au seuil (Assisté Nano Banana 2)

Exemple concret : On veut savoir si le service militaire obligatoire (traitement) améliore les salaires. On utilise comme instrument la loterie du tirage au sort (à certaines époques, les conscrits étaient tirés au sort). La loterie influence le service (être tiré = service), mais n'influence pas directement le salaire (sauf via le service). C'est un bon instrument.

Forces :

Faiblesses :

OUI → Utilisez un A/B test / essai randomisé (méthode la plus robuste)

NON → Passez à la question suivante

OUI → Utilisez la régression sur discontinuité (RDD)

NON → Passez à la question suivante

OUI → Utilisez la différence-en-différences (DiD)

NON → Passez à la question suivante

OUI → Utilisez les variables instrumentales (IV)

NON → Utilisez le score de propension (matching) ou la régression ajustée

| Méthode | Idéale quand... | Prérequis |

|---|---|---|

| A/B test | Randomisation possible | Infrastructure technique |

| Matching | Beaucoup de covariables observées | Données riches |

| DiD | Série temporelle + groupe témoin | Tendances parallèles |

| RDD | Seuil d'attribution clair | Pas de manipulation du seuil |

| IV | Confondants non observés | Instrument valide |

Chaque méthode repose sur des hypothèses. Si les hypothèses sont violées, les résultats peuvent être biaisés. Toujours tester la robustesse des conclusions.

Un effet causé mesuré sur une population spécifique (ex: étudiants américains) ne se généralise pas automatiquement à d'autres populations (ex: retraités européens).

Seules la randomisation et les bonnes variables instrumentales les contrôlent. Le matching et DiD n'aident que pour les confondants observés.

La corrélation indique que deux variables évoluent ensemble. La causalité indique que l'une provoque l'autre. Deux variables peuvent être corrélées sans lien causal (confondant, hasard, causalité inverse). L'inférence causale est l'ensemble des méthodes pour passer de l'un à l'autre.

L'essai randomisé contrôlé (A/B test) est considéré comme le "gold standard" car la randomisation élimine théoriquement tous les biais. Cependant, elle n'est pas toujours possible (coût, éthique, faisabilité). Dans ce cas, les méthodes quasi-expérimentales (DiD, RDD, IV) sont de bonnes alternatives si leurs hypothèses sont vérifiées.

Non. On ne peut jamais prouver la causalité avec une certitude absolue. On peut seulement accumuler des preuves solides (randomisation, réplications, études diverses). En sciences, on parle de "preuves convergentes" plutôt que de "preuve définitive".

Pour l'implémentation technique : R (packages : MatchIt, causalweight, did) et Python (bibliothèques : DoWhy, EconML, causalinference). Pour la découverte et la compréhension : des outils comme DAGitty (gratuit en ligne) aident à visualiser les relations causales. Pour une approche sans code, des plateformes comme Optimizely (A/B test) existent.

Oui, absolument. Les entreprises l'utilisent pour mesurer l'impact réel de leurs actions : ROI marketing, effet d'une nouvelle fonctionnalité, impact d'une formation, efficacité d'une campagne. Cela évite d'investir sur des corrélations trompeuses.

Le DML est une méthode récente qui combine machine learning et inférence causale. Elle utilise des algorithmes de ML (forêts aléatoires, réseaux de neurones) pour contrôler un grand nombre de confondants, tout en restituant des estimations causales interprétables. C'est une tendance forte depuis 2020.

L'inférence causale est un passage obligé pour passer de l'observation à la décision éclairée. Elle ne remplace pas le bon sens ni l'expertise métier, mais elle la discipline et la rend plus fiable.