Sommaire

- Pourquoi ce sujet revient tout le temps

- Qu’est-ce que la corrélation ?

- Qu’est-ce que la causalité ?

- Formulation mathématique : élucider la différence

- Pourquoi il faut absolument distinguer les deux

- Les pièges classiques : confondants, causalité inversée, sélection

- Exemples concrets (sérieux et insolites)

- Méthodes pour tester / approcher la causalité

- Glossaire sémantique (concepts clés)

- Checklist rapide avant de conclure

- FAQ enrichie

- Conclusion

- Articles connexes (maillage interne)

Pourquoi ce sujet revient tout le temps

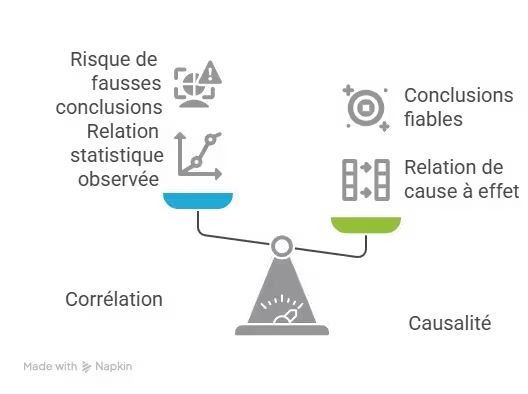

Dans le monde de l’analyse des données, distinguer entre corrélation et causalité est crucial pour tirer des conclusions fiables et éviter des erreurs d’interprétation. Les deux notions sont proches dans le langage courant (on dit facilement “ça explique ça”), mais elles n’ont pas du tout la même portée.

Traduction terrain

Une corrélation sert à détecter un lien statistique. Une causalité sert à justifier une action (changer un prix, une interface, une politique, un traitement, un budget). C’est la différence entre “observer” et “intervenir”.

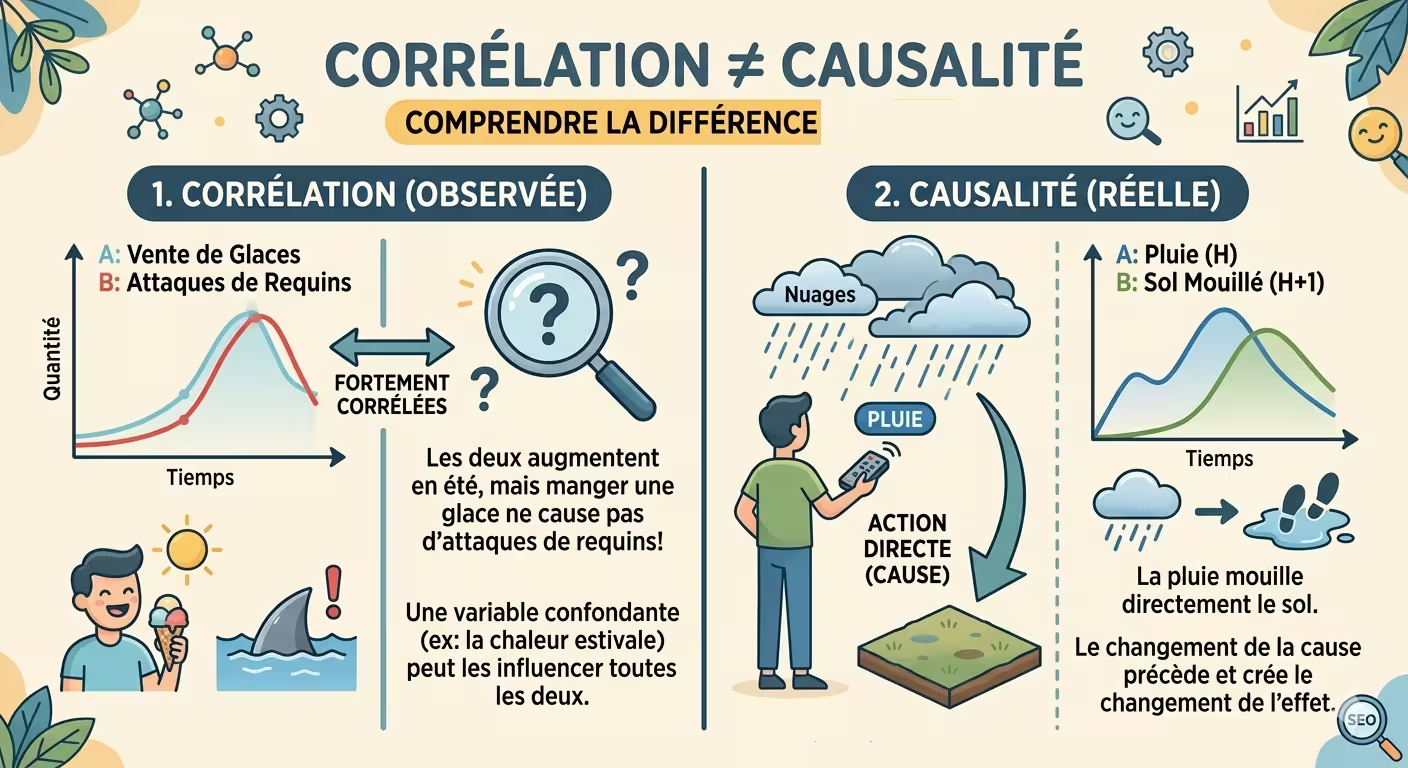

Qu’est-ce que la corrélation ?

La corrélation est une mesure statistique qui exprime la relation entre deux variables, indiquant dans quelle mesure elles varient ensemble. Si deux variables montrent une corrélation, cela signifie qu’il existe un lien, mais cela ne prouve pas que l’une cause l’autre.

Corrélation positive, négative, ou nulle

- Positive : les deux variables augmentent (ou diminuent) ensemble.

- Négative : l’une augmente pendant que l’autre diminue.

- Nulle : pas de lien linéaire détectable (ce qui n’exclut pas un lien non linéaire).

Attention

Beaucoup d’outils affichent une corrélation “simple” (souvent Pearson). Or un lien peut être non linéaire, dépendre d’un segment, ou être dominé par quelques valeurs extrêmes. Une corrélation unique peut masquer une histoire plus complexe.

Exemple simple : chaleur et ventes de glaces

On observe souvent que les ventes de glaces augmentent pendant les périodes de forte chaleur : corrélation positive. Mais conclure “la chaleur cause l’augmentation des ventes” peut être trop rapide si l’on oublie le contexte : vacances, tourisme, horaires, événements, comportements saisonniers, etc.

Illustration corrélation vs causalité

Qu’est-ce que la causalité ?

La causalité décrit une relation de cause à effet : une variable (la cause) produit un changement dans une autre (l’effet). Affirmer une causalité implique une idée forte : si on intervient sur la cause, alors l’effet change.

Exemple : foudre et tonnerre

Lorsque la foudre frappe, elle réchauffe et refroidit très rapidement l’air, ce qui provoque le tonnerre. Ici, la relation causale est claire : la foudre cause le tonnerre.

Schéma de causalité directe : la foudre provoque le tonnerre

Le test mental le plus utile

Corrélation : “quand X bouge, Y bouge souvent”.

Causalité : “si je fais varier X (toutes choses égales), Y change”.

Question corrélation

- Y suit-il X dans les données ?

- Le lien est-il stable selon les segments ?

- Le lien disparaît-il si je contrôle d’autres variables ?

Question causalité

- Que se passerait-il si j’intervenais sur X ?

- Ai-je un groupe de comparaison crédible ?

- Y aurait-il changé de toute façon (contrefactuel) ?

Formulation mathématique : élucider la différence

La différence entre corrélation et causalité peut être clarifiée par les outils mathématiques qui les sous‑tendent.

Coefficient de corrélation de Pearson (r)

Il mesure l’intensité et le sens d’une relation linéaire entre deux variables X et Y :

r = (Σi=1n (xi - x̄)(yi - ȳ)) / √[(Σi=1n (xi - x̄)2) (Σi=1n (yi - ȳ)2)]

r est compris entre -1 et 1. Un r proche de 0 indique l’absence de corrélation linéaire, mais ne dit rien sur une éventuelle relation causale.

Régression linéaire : modéliser la relation

Le modèle de régression linéaire simple s’écrit :

Y = β0 + β1 · X + ε

Le coefficient β1 donne la variation estimée de Y lorsque X augmente d’une unité. Même si β1 est statistiquement significatif, cela ne prouve pas la causalité : un confondant non observé peut créer cette association. La causalité exige des hypothèses supplémentaires (exogénéité, absence de biais de sélection, etc.).

En résumé : une équation mathématique lie des nombres, mais c’est le raisonnement (et le design de l’étude) qui lie les causes aux effets.

Pourquoi est-il important de distinguer corrélation et causalité ?

Confondre corrélation et causalité peut conduire à des conclusions erronées. Et dès qu’une conclusion entraîne une décision (budget, politique, produit, traitement), l’erreur devient coûteuse.

| Situation | Risque si on confond | Conséquence typique |

|---|---|---|

| Produit / UX | Attribuer à tort une hausse/baisse à une fonctionnalité | Roadmap biaisée, itérations inutiles |

| Marketing | Surévaluer un canal corrélé à la conversion | ROI surestimé, budget mal alloué |

| Santé | Confondre association et cause | Interventions inefficaces ou dangereuses |

| Politique publique | Prendre une mesure sur une mauvaise explication | Coût social, perte de confiance |

Les pièges classiques : pourquoi “ça bouge ensemble” ne suffit pas

1) Variables confondantes

Un facteur confondant influence à la fois X et Y, créant une corrélation trompeuse. Exemple classique : température ↔ ventes de glaces ↔ noyades. La chaleur augmente à la fois l’achat de glaces et la baignade, donc les noyades : glaces et noyades corrèlent sans lien causal direct.

2) Causalité inversée

Parfois, on croit que X influence Y, alors que c’est Y qui influence X. Exemple : “les clients fidèles utilisent plus l’appli”. Peut-être que la fidélité mène à l’usage… ou que l’usage crée la fidélité. Sans design causal, difficile de trancher.

3) Biais de sélection

Les données observées ne sont pas toujours représentatives. Un formulaire en ligne ne capture pas les personnes qui abandonnent avant d’arriver à la page. Une analyse sur “ceux qui ont acheté” ignore “ceux qui ont hésité et sont partis”.

4) Paradoxe de Simpson (effet de segmentation)

Une tendance globale peut s’inverser lorsqu’on segmente (par âge, canal, région). C’est un piège fréquent dans les dashboards : la corrélation globale rassure, puis les sous-groupes racontent une autre histoire.

Signal d’alerte

Si une relation “explique tout” en deux variables alors que le phénomène est complexe (humains, économie, santé), il y a souvent une variable cachée, un biais de sélection, ou une causalité inversée.

Exemples concrets (sérieux et insolites)

Exemple 1 : la pellagre et les conditions de vie insalubres

La pellagre était corrélée à la pauvreté et aux conditions de vie insalubres. On a d’abord soupçonné ces conditions comme cause. La cause réelle s’est révélée être une carence en niacine (vitamine B3). Les conditions de vie étaient un contexte associé, pas le mécanisme causal principal.

Exemple 2 : Google Analytics et l’inscription aux prestations sociales

Observer que des utilisateurs consultent une page d’information puis quittent sans s’inscrire est une corrélation : “visite” ↔ “abandon”. La cause peut être multiple : complexité de l’interface, peur de se tromper, documents manquants, éligibilité, temps requis, incompréhension, accessibilité.

La bonne démarche consiste souvent à compléter les logs par des tests utilisateurs, des enquêtes, ou une expérimentation (A/B) sur une simplification ciblée.

Exemple 3 : consommation de chocolat et prix Nobel

Corrélation amusante : consommation de chocolat ↔ lauréats du prix Nobel. La causalité est très improbable. Un facteur confondant plausible est le niveau de richesse / investissement éducation-recherche.

Exemple 4 : films de Nicolas Cage et noyades

Exemple absurde mais pédagogique : deux séries temporelles peuvent corréler par hasard. Plus on teste de corrélations, plus on en trouve qui semblent “significatives”. D’où le besoin de rigueur (et d’humilité).

Exemple 5 : émissions de CO₂ et pirates

La baisse du nombre de pirates depuis le XVIIIe siècle et l’augmentation des émissions de CO₂ corrèlent sur certaines périodes. C’est un excellent rappel : des variables indépendantes peuvent bouger “ensemble” sans lien causal.

Exemple 6 (insolite) : le nombre de diplômés en sociologie et la hausse du prix du pétrole

Une corrélation sur une période donnée entre le nombre de diplômés en sociologie et le prix du baril de pétrole n’a aucun sens causal. C’est un cas typique de corrélation fallacieuse qui illustre pourquoi il faut toujours se méfier des coïncidences statistiques.

Exemple 7 (biais post hoc ergo propter hoc) : le coq chante, puis le soleil se lève

Si l’on observe qu’à chaque matin le coq chante et que le soleil se lève juste après, on pourrait (naïvement) conclure que le chant du coq fait lever le soleil. C’est une illustration classique du sophisme post hoc ergo propter hoc (après cela, donc à cause de cela).

Illustration humoristique : corrélation entre nombre de bateaux et fumées (exemple pédagogique)

Méthodes pour tester (ou approcher) la causalité

La causalité exige un raisonnement contrefactuel : “que se serait-il passé sans l’intervention ?”. Selon le contexte, on utilise différentes stratégies.

1) Expérimentation contrôlée (A/B, essais randomisés)

On assigne aléatoirement des individus à un groupe “traitement” et un groupe “contrôle”. C’est le standard le plus robuste lorsque c’est faisable (produit, marketing, médecine).

2) Régression (avec prudence)

La régression peut aider à contrôler des variables observées, mais elle ne “crée” pas la causalité. Si un confondant important n’est pas mesuré, la conclusion reste fragile.

3) Inférence causale sur données d’observation

Quand l’expérimentation est impossible, on utilise des méthodes dédiées :

Approches “comparatives”

- Différence-en-différences (DiD)

- Contrôle synthétique

- Études d’événements (event study)

Approches “structurelles”

- Variables instrumentales (IV)

- Appariement / score de propension

- DAG (graphes causaux) et tests d’hypothèses

4) Études longitudinales

Suivre les mêmes sujets dans le temps permet d’observer des trajectoires et des effets différés. C’est utile en épidémiologie, sociologie, économie, et aussi en produit (cohortes, rétention).

Idée pratique

Si vous ne pouvez pas randomiser, cherchez au minimum un groupe de comparaison crédible et explicitez vos hypothèses. Une “bonne causalité” est souvent une causalité argumentée, pas seulement calculée.

Infographie : méthodes pour approcher la causalité en analyse de données (assisté par Nano Banana2)

Glossaire sémantique : concepts clés pour une analyse rigoureuse

Variable confondante

Facteur externe qui influence à la fois la cause présumée et l’effet, créant une corrélation trompeuse. Exemple : la température influence à la fois les ventes de glaces et le nombre de noyades.

Biais cognitif

Tendance de l’esprit humain à interpréter les informations de manière non objective. En analyse de données, cela peut mener à voir une causalité là où il n’y a qu’une corrélation (ex : biais de confirmation, excès de confiance).

Post hoc ergo propter hoc

Sophisme logique consistant à affirmer que parce qu’un événement suit un autre, il est causé par celui-ci. Exemple : le coq chante, le soleil se lève → le chant du coq fait lever le soleil.

Coefficient de corrélation (r)

Mesure statistique comprise entre -1 et 1 qui quantifie l’intensité et le sens d’une relation linéaire entre deux variables. Ne reflète pas une relation de cause à effet.

Régression linéaire

Modèle statistique qui estime la relation entre une variable dépendante et une ou plusieurs variables indépendantes. Utile pour la prédiction et le contrôle de variables, mais ne démontre pas la causalité par lui‑même.

Checklist rapide avant de conclure

- Ai-je une hypothèse causalement plausible ? (mécanisme, sens de la flèche)

- Y a-t-il un confondant évident ? (saison, segmentation, budget, sélection)

- La relation est-elle stable par segments (âge, canal, région, device) ?

- Ai-je un contrefactuel (A/B, contrôle, avant/après robuste) ?

- Le résultat est-il sensible au choix de métrique et de période ?

- Combien de corrélations ai-je testées ? (risque de faux positifs, p-hacking)

Conseil

Une analyse solide ne se résume pas à un coefficient. Elle raconte : données → hypothèse → méthode → limites → décision.

FAQ

Une corrélation forte peut-elle quand même être utile ?

Oui. Elle peut servir à prédire, détecter un signal, prioriser une enquête, ou construire une feature. Mais pour décider d’une action (changer X pour améliorer Y), il faut une justification causale.

Si je "contrôle" beaucoup de variables en régression, est-ce causal ?

Pas automatiquement. Contrôler des variables observées réduit certains biais, mais ne supprime pas les confondants non observés, ni les biais de sélection. La régression aide, elle ne remplace pas un design causal.

Pourquoi voit-on autant de corrélations absurdes sur Internet ?

Parce qu’on peut tester énormément de séries ou de variables. Statistiquement, on finit par trouver des corrélations "significatives" par hasard. C’est une bonne leçon contre les conclusions rapides.

Qu’est-ce que le biais “post hoc ergo propter hoc” ?

C’est un sophisme qui consiste à prendre la succession temporelle pour une relation de cause à effet. Exemple : “je prends un médicament et je guéris le lendemain, donc c’est le médicament qui m’a guéri” (alors que la guérison aurait eu lieu naturellement).

Comment détecter une variable confondante ?

En mobilisant la connaissance du domaine, en construisant un graphe causal (DAG), et en observant si la relation disparaît lorsque l’on contrôle la variable suspectée. Dans les données, une variable confondante doit être liée à la fois à la cause supposée et à l’effet.

Quelle est la différence entre corrélation et régression linéaire ?

La corrélation quantifie la force et le sens d’une relation linéaire (symétrique). La régression modélise une relation asymétrique : on cherche à expliquer ou prédire Y à partir de X. La régression donne un coefficient qui peut être utilisé dans un cadre causal si les hypothèses sont vérifiées, mais cela reste une association statistique.

Revenir au guide complet

Pour explorer l’ensemble des outils et technologies en data science, IA et visualisation, consultez le pilier dédié : Outils, technologies et dataviz – guide complet.

Articles connexes (pour approfondir)

Renforcez votre compréhension avec ces ressources complémentaires du site iana-data :

- Introduction à la régression linéaire multiple – maîtrisez l’outil statistique clé pour contrôler les variables.

- Biais cognitifs en analyse de données – comment notre cerveau nous trompe face aux chiffres.

- Méthodes d’inférence causale avec R et Python – exemples concrets de diff‑en‑diff et variables instrumentales.

- Le paradoxe de Simpson expliqué avec des cas marketing – quand le global cache la réalité.

Conclusion

La distinction entre corrélation et causalité est fondamentale pour toute analyse de données rigoureuse. Une corrélation indique un lien statistique ; une causalité justifie une intervention.

Que l’objectif soit commercial, scientifique ou public, garder cette distinction en tête évite de confondre des coïncidences avec des mécanismes. Et dans la pratique, c’est souvent là que se joue la maturité data : savoir dire “je ne sais pas encore”, puis construire la preuve.