Data Mesh : l'avenir de la gestion des données dans les entreprises françaises

Un approfondissement du concept Data Mesh et de son adoption en France.

Data lake, data warehouse, lambda, kappa, data mesh ou lakehouse : guide comparatif pour sélectionner l'architecture adaptée à vos besoins, votre maturité et vos objectifs data.

Dans un environnement où les volumes de données explosent (+23% par an en moyenne selon IDC 2026), l'architecture Big Data n'est plus une simple décision technique. C'est un choix stratégique qui impacte directement la performance, l'agilité et la capacité d'innovation de l'entreprise.

Une architecture Big Data bien conçue permet de :

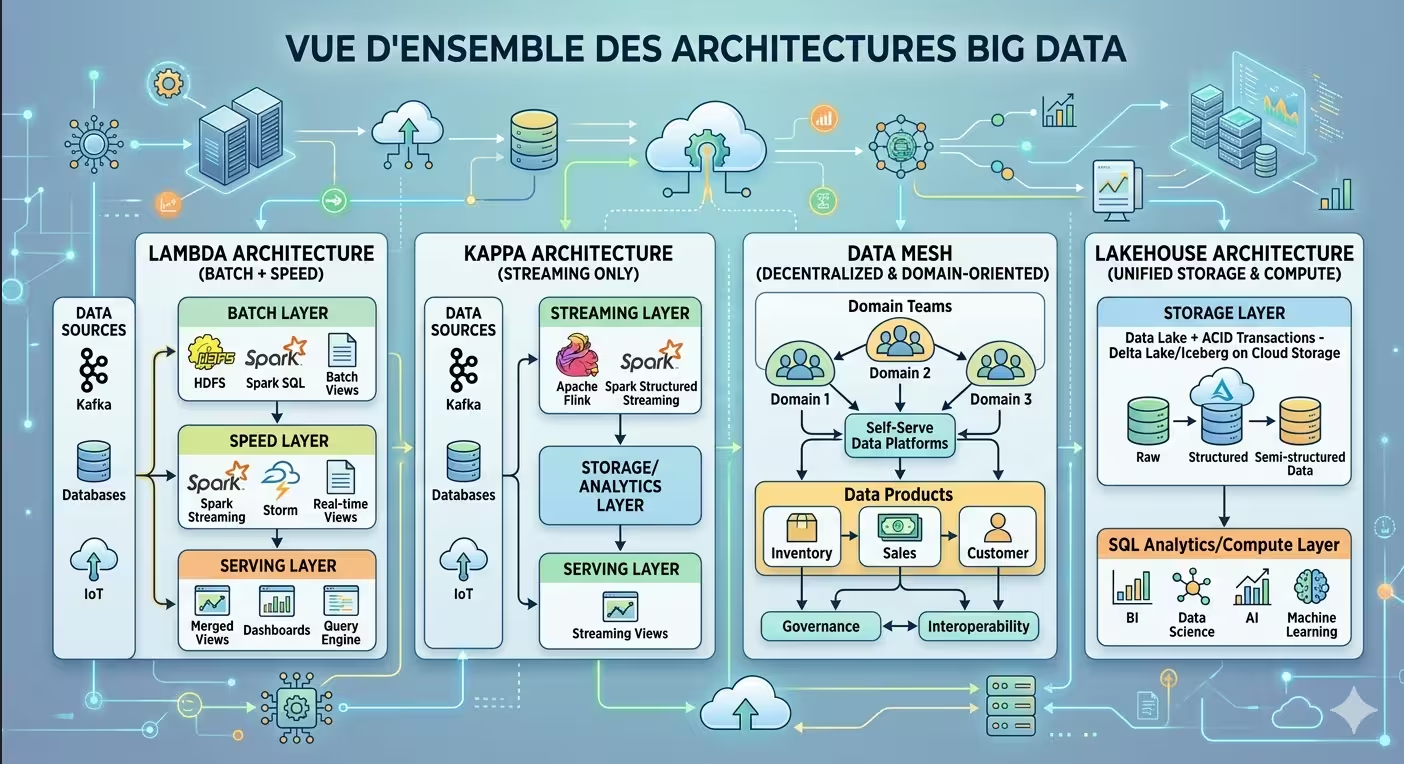

Schéma comparatif des 4 grandes familles d'architecture (Assisté Nano Banana)

Modèle historique, le data warehouse centralise des données structurées, nettoyées et modélisées (schéma en étoile, flocon). Il est optimisé pour l'analyse et le reporting, mais peine avec les données non structurées et les volumes massifs en temps réel.

Technologies typiques : Snowflake, BigQuery, Redshift, Azure Synapse.

Le data lake stocke toutes les données brutes (structurées, semi-structurées, non structurées) dans leur format natif. Il offre une grande flexibilité mais peut devenir un "data swamp" sans gouvernance rigoureuse.

Technologies typiques : AWS S3 + Glue, Azure Data Lake, GCS, Hadoop HDFS.

L'architecture lambda combine deux couches : une couche batch (traitement par lots) et une couche speed (traitement temps réel). Les résultats des deux couches sont fusionnés à la lecture. Robuste mais complexe à maintenir.

Technologies typiques : Spark (batch) + Kafka/Flink (speed).

L'architecture kappa simplifie lambda en traitant tout (batch et temps réel) comme un flux continu. Plus simple à maintenir, mais nécessite une infrastructure de streaming robuste.

Technologies typiques : Apache Kafka, Apache Flink, RisingWave.

Le lakehouse fusionne les avantages du data lake (flexibilité, coût) et du data warehouse (performance ACID, gouvernance). C'est l'architecture émergente plébiscitée en 2026.

Technologies typiques : Delta Lake, Apache Iceberg, Apache Hudi.

Le data mesh est une approche organisationnelle et technique qui décentralise la propriété des données par domaine d'activité (produit, marketing, finance). Chaque domaine expose ses données via des "data products".

Technologies typiques : Any stack + couche de fédération (dbt, Trino, DataHub).

Il n'existe pas d'architecture universelle. Le bon choix dépend de vos cas d'usage (batch, temps réel, mixte), de votre maturité data et de votre organisation.

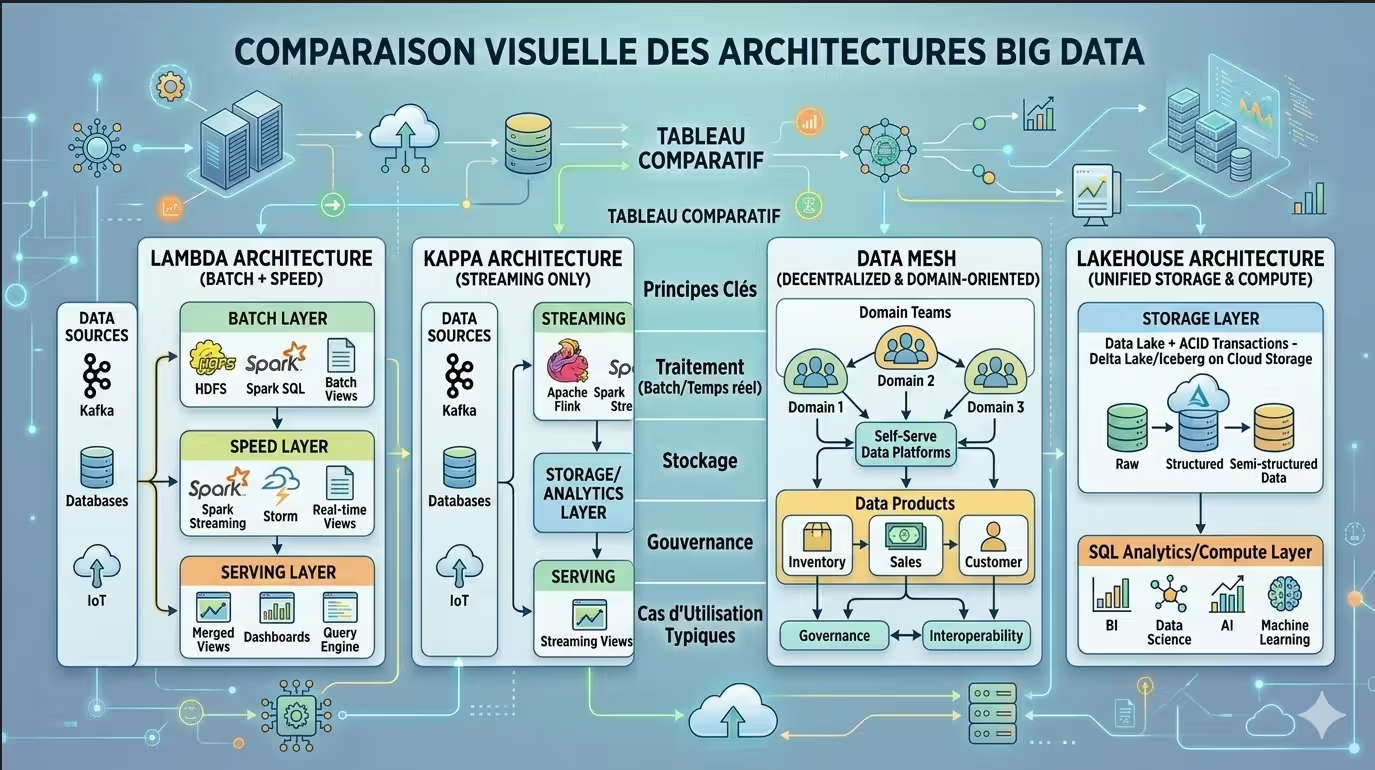

Tableau comparatif des forces/faiblesses de chaque architecture (Assisté Nano Banana)

| Critère | Data Warehouse | Data Lake | Lambda | Kappa | Lakehouse | Data Mesh |

|---|---|---|---|---|---|---|

| Types de données | Structurées | Tous | Tous | Tous | Tous | Tous |

| Temps réel | Non | Limitée | Oui | Oui | Oui | Oui |

| Gouvernance | Forte | Risque de data swamp | Bonne | Bonne | Forte | Décentralisée |

| Coût | Élevé (stockage) | Faible (stockage) | Élevé (maintenance) | Moyen | Moyen | Variable |

| Complexité | Faible | Faible | Élevée | Moyenne | Moyenne | Élevée (orga) |

| Idéal pour | Reporting, BI | Exploration, Data Science | Batch + temps réel | Temps réel pur | Usage mixte | Grande organisation |

Avez-vous besoin de traitements batch (rapports quotidiens, modèles ML batch), de traitements temps réel (détection de fraude, recommandations) ou d'un mixte ? Si temps réel uniquement → Kappa. Mixte complexe → Lambda. Batch seulement → Data Warehouse ou Lakehouse.

Données structurées uniquement et volumes modérés → Data Warehouse. Données non structurées (images, logs, vidéos) ou très gros volumes → Data Lake ou Lakehouse.

Une architecture Lambda ou Data Mesh demande des compétences avancées en streaming, en DevOps et en gouvernance. Les équipes débutantes préféreront un Lakehouse managé (Snowflake, Databricks).

Le stockage data lake est moins cher, mais les coûts de traitement et de gouvernance peuvent exploser. Le data warehouse a un coût de stockage élevé mais des performances prédictibles.

Pour les grandes entreprises (500+ personnes), le Data Mesh apporte une réponse à la prolifération des silos. Pour les PME, un Lakehouse centralisé est plus adapté.

Avant de choisir, répondez à ces 5 questions :

1. Quels sont mes 3 principaux cas d'usage data ?

2. Ai-je besoin de temps réel (latence < 1 seconde) ?

3. Quelles compétences ai-je en interne ?

4. Quel est mon budget sur 3 ans ?

5. Suis-je prêt à décentraliser la data (Data Mesh) ?

Recommandation : Lakehouse managé (Snowflake, BigQuery, Databricks)

Pourquoi ? Simplicité d'opération, pas d'infrastructure à gérer, coût maîtrisé à l'usage. Idéal pour les équipes data réduites.

Recommandation : Lakehouse + zones dédiées par domaine

Pourquoi ? Équilibrer gouvernance centralisée et agilité métier. On conserve un lakehouse fédérateur mais on autorise des zones "sandbox".

Recommandation : Data Mesh

Pourquoi ? La décentralisation par domaine d'activité (produit, finance, supply chain) évite les goulots d'étranglement et responsabilise les équipes métier. Nécessite un investissement en culture data.

Recommandation : Architecture Kappa

Pourquoi ? Les cas d'usage temps réel sont souvent prioritaires (recommandations, personnalisation). La simplification de la stack (un seul flux) accélère le développement.

Selon une étude Databricks (2026), 72% des entreprises prévoient d'adopter une architecture lakehouse d'ici 2028. Les formats ouverts (Apache Iceberg, Delta Lake) deviennent incontournables pour éviter le lock-in.

Après les pionniers (Netflix, Zalando, JPMorgan), le Data Mesh séduit les groupes qui peinent à scaler leur data platform centralisée. L'enjeu principal reste culturel plus que technique.

Les modèles de langage (LLM) nécessitent des volumes massifs de données non structurées et des capacités de calcul importantes. Les architectures évoluent pour intégrer des "data pipelines" spécifiques à l'IA (RAG, fine-tuning).

Ne partez pas d'une architecture "parfaite" dès le départ. Adoptez une approche itérative : commencez avec un lakehouse simple, puis évoluez vers le Data Mesh si votre organisation le justifie.

Un data warehouse stocke des données structurées, nettoyées et modélisées pour l'analyse (schéma en écriture). Un data lake stocke des données brutes de tous types (structurées, semi-structurées, non structurées) dans leur format natif (schéma en lecture). Le lakehouse fusionne les deux approches.

Oui, c'est même fréquent. On peut avoir un data warehouse pour la BI financière, un data lake pour l'exploration data science, et des micro-services temps réel en Kappa. L'essentiel est d'éviter la prolifération incontrôlée de silos.

Généralement non. Le Data Mesh répond à des problèmes d'échelle organisationnelle (silos multiples, 500+ personnes). Pour une PME, un lakehouse centralisé bien gouverné est plus simple et efficace.

Très variable selon les volumes. Pour une PME (10 TB), comptez 2k€ à 10k€/mois sur du cloud managé. Pour une ETI (100 TB), 20k€ à 50k€/mois. Pour un grand groupe (1+ PB), 100k€ à 500k€/mois. Le coût principal est souvent le traitement (requêtes), pas le stockage.

Aujourd'hui, oui dans 90% des cas. Le cloud offre l'élasticité, les services managés (BigQuery, Redshift, Databricks) et la réduction des coûts d'infrastructure. Le on-premise reste pertinent pour des raisons de souveraineté ou de volumes déjà colossaux (ex: CERN).

Les formats columnaires comme Parquet et ORF sont standards. Pour les lakehouses, les formats "table ouverte" comme Apache Iceberg, Delta Lake et Apache Hudi sont incontournables car ils apportent les transactions ACID et l'évolution de schéma.

Choisir la bonne architecture Big Data n'est pas une décision binaire mais un équilibre entre vos cas d'usage, votre maturité et votre organisation. En 2026, le lakehouse s'impose comme un excellent point de départ pour la plupart des entreprises. Le Data Mesh est une évolution pertinente pour les grandes organisations matures. Les architectures Lambda et Kappa restent adaptées aux besoins temps réel spécifiques.

L'essentiel est d'adopter une approche itérative : commencer simple, mesurer, puis évoluer. Plus que la technologie, ce sont vos processus de gouvernance, vos compétences et votre culture data qui feront la différence.