Sommaire

- Deep learning : définition simple

- Différence entre ML et deep learning (schéma clé)

- Comment fonctionne un réseau de neurones ? (analogie simple)

- Pourquoi le deep learning est si puissant ?

- 10 applications concrètes du deep learning

- Les limites à connaître

- Pourquoi le deep learning explose depuis 2012 ?

- FAQ

- Conclusion

- Articles connexes

1. Deep learning : définition simple

Le deep learning (ou apprentissage profond en français) est une technique avancée de machine learning. Il utilise des réseaux de neurones artificiels comportant plusieurs couches (d’où le terme “profond” / “deep”).

La définition la plus simple

Imaginez un cerveau miniature artificiel, composé de milliers de petits “neurones” connectés entre eux. En lui montrant des milliers d’exemples, il apprend tout seul à reconnaître des motifs, des images, des sons ou du texte. Plus le réseau a de couches (profondeur), plus il peut apprendre des choses complexes.

99%

des avancées récentes en IA viennent du deep learning

Stanford AI Index, 2026

+5000x

plus de puissance de calcul qu’en 2010

OpenAI, 2025

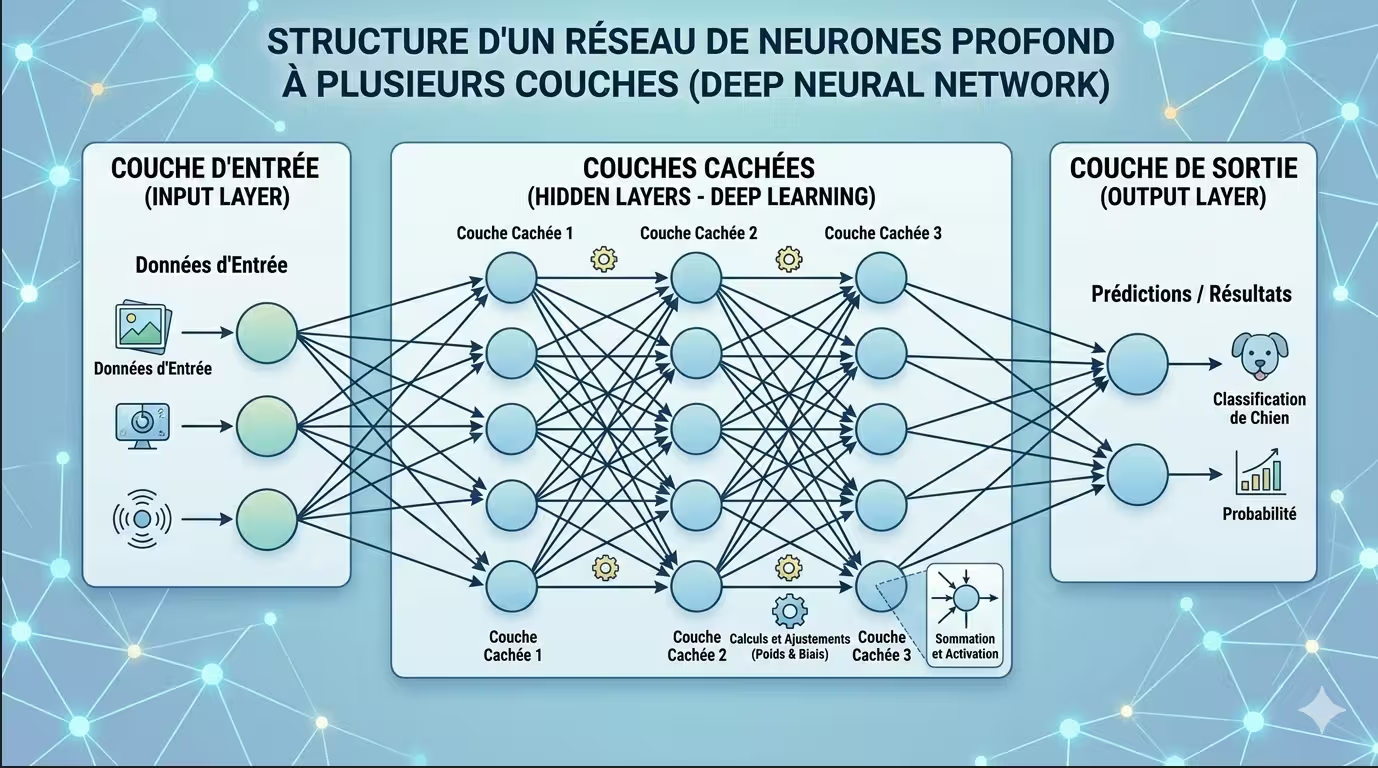

Illustration d’un réseau de neurones à plusieurs couches (Assisté Nano Banana 2)

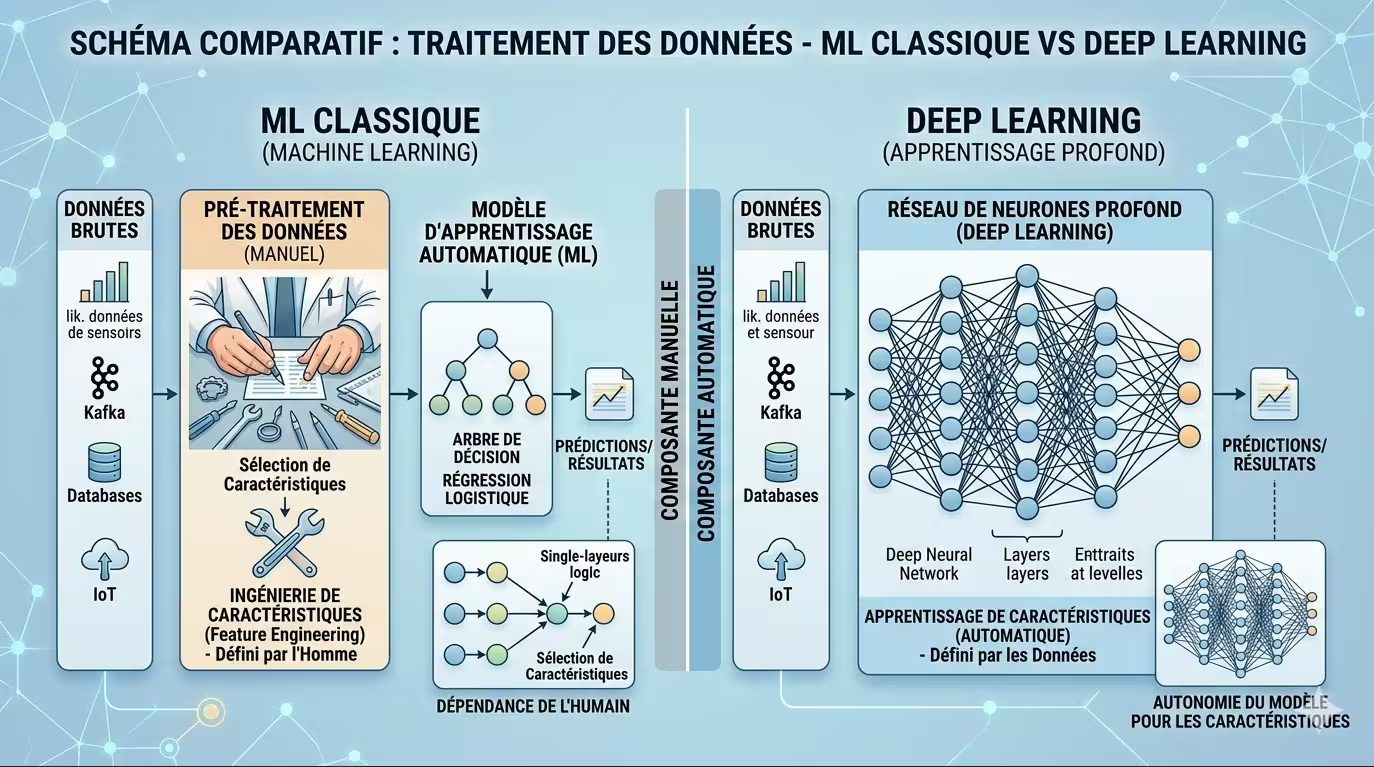

2. Différence entre ML classique et deep learning

Machine Learning classique

L’humain aide à choisir les caractéristiques (features)

Deep Learning

Le réseau trouve seul les caractéristiques

Analogie : apprendre à reconnaître un chat

- ML classique : Un humain dit à l’ordinateur : “regarde les oreilles pointues, les moustaches, la forme des yeux”. L’ordinateur cherche ces caractéristiques précises.

- Deep learning : On montre des milliers de photos de chats à un réseau de neurones. Il découvre TOUT SEUL que les chats ont des oreilles pointues, des moustaches, etc. Il invente ses propres critères, parfois meilleurs que les nôtres.

Formule magique : ML classique = l’humain guide l’apprentissage. Deep learning = l’ordinateur apprend par lui-même à partir des données brutes.

| Critère | ML classique | Deep Learning |

|---|---|---|

| Quantité de données | Peut fonctionner avec peu de données | Nécessite BEAUCOUP de données (millions) |

| Puissance de calcul | Ordinateur standard | GPU / TPU (cartes graphiques puissantes) |

| Interprétabilité | Relativement facile à expliquer | Boîte noire (difficile à comprendre) |

| Performance sur images/sons | Moyenne | Exceptionnelle |

| Temps d’entraînement | Minutes à heures | Heures à jours (parfois semaines) |

Schéma montrant la différence de traitement des données (Assisté Nano Banana 2)

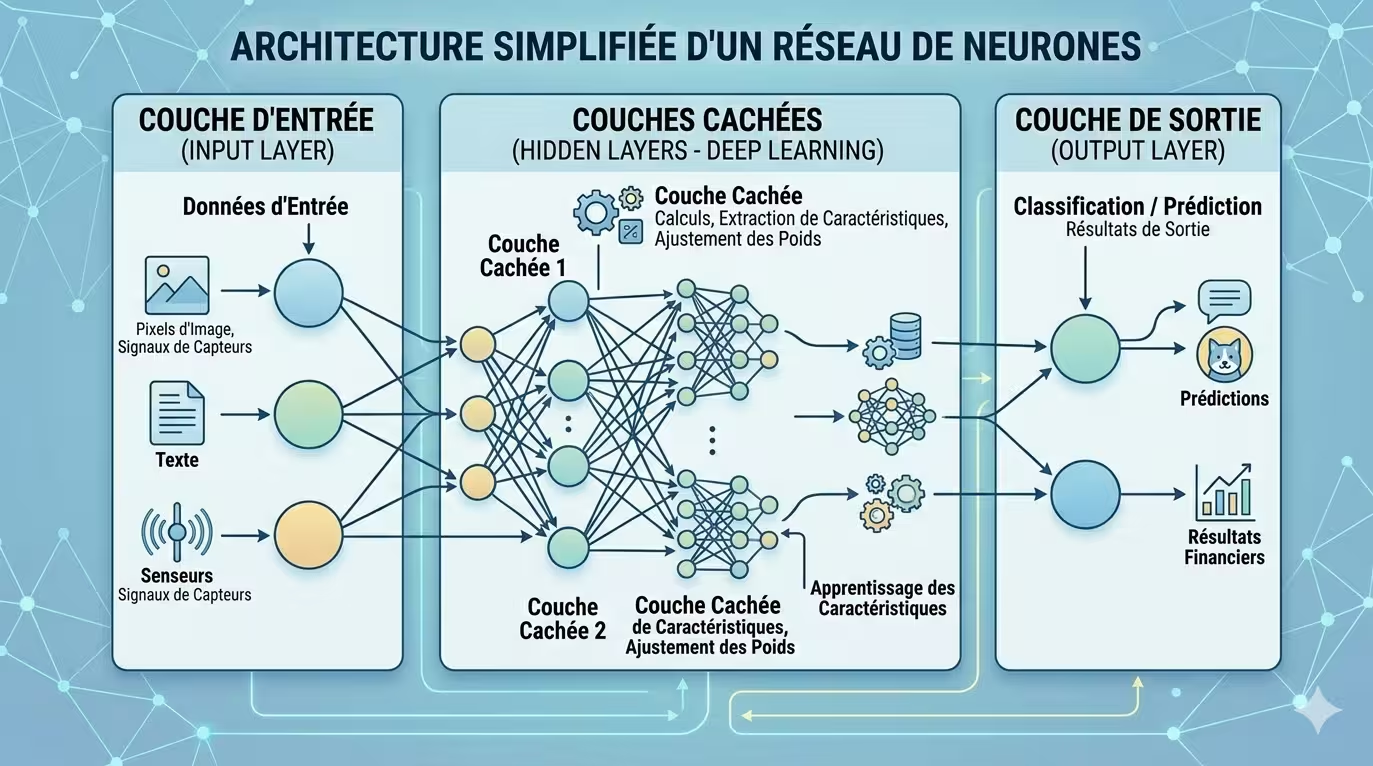

3. Comment fonctionne un réseau de neurones ? (analogie simple)

Étape 1 : La couche d’entrée

C’est comme les yeux du réseau. Il reçoit l’information brute : les pixels d’une image, les mots d’une phrase, les sons d’un enregistrement.

Étape 2 : Les couches cachées (le “deep”)

Chaque neurone reçoit des signaux, les transforme, et les transmet aux neurones suivants. C’est comme une chaîne d’ouvriers : le premier repère des contours, le deuxième des formes simples, le troisième des yeux, le quatrième un visage complet. Plus il y a de couches, plus la compréhension est fine.

Étape 3 : La couche de sortie

Le réseau donne sa réponse finale : “c’est un chat” / “ce n’est pas un chat”. Il a une probabilité pour chaque possibilité.

Étape 4 : L’apprentissage (rétropropagation)

Si le réseau se trompe, on lui dit son erreur. Il ajuste alors tous ses neurones pour être meilleur la prochaine fois. Après des millions d’essais, il devient très précis.

Le secret du deep learning

Ce qui rend le deep learning si puissant, c’est sa capacité à automatiser la découverte des caractéristiques (feature engineering). Là où un humain passerait des semaines à trouver les bons indicateurs, le réseau les apprend tout seul en quelques jours.

Architecture simplifiée d’un réseau de neurones (Assisté Nano Banana 2)

4. Pourquoi le deep learning est si puissant ?

Raison n°1 : L’explosion des données

Le deep learning a besoin de très grandes quantités de données pour être performant. Aujourd’hui, grâce à Internet, aux réseaux sociaux et aux capteurs, nous générons des milliards d’images, de textes et de vidéos chaque jour.

Raison n°2 : La puissance de calcul (GPU)

Les réseaux de neurones profonds nécessitent des calculs massifs. Les GPU (cartes graphiques), initialement conçus pour les jeux vidéo, sont parfaits pour cela. Un GPU peut faire des milliers de calculs en parallèle.

Raison n°3 : Les progrès algorithmiques

Des innovations comme l’attention (transformers), les couches de normalisation ou les fonctions d’activation ont rendu l’entraînement de réseaux très profonds possible et stable.

1 million

de fois plus de puissance de calcul depuis 2012

OpenAI, 2026

-99%

d’erreur en reconnaissance d’images (depuis 2010)

ImageNet, 2025

5. 10 applications concrètes du deep learning

| Application | Exemple | Type de réseau |

|---|---|---|

| Reconnaissance faciale | Déverrouillage iPhone, aéroports | CNN (convolutionnel) |

| Chatbots (ChatGPT, Gemini) | Réponse aux questions, rédaction | Transformers |

| Voitures autonomes | Tesla, Waymo | CNN + renforcement |

| Diagnostic médical | Détection de tumeurs sur IRM | CNN |

| Traduction automatique | DeepL, Google Traduction | Transformers |

| Génération d’images | Midjourney, DALL-E, Stable Diffusion | Diffusion / GAN |

| Reconnaissance vocale | Siri, Alexa, transcription automatique | RNN / Transformers |

| Détection de fraudes | PayPal, Visa | Autoencodeurs |

| Jeux vidéo (IA adversaire) | AlphaGo, AlphaStar | Apprentissage par renforcement |

| Synthèse vocale (clonage de voix) | ElevenLabs, Resemble AI | Transformers |

Cas d’usage bluffant

AlphaFold (DeepMind) : un réseau de neurones profond qui prédit la structure 3D des protéines. Avant, cela prenait des années de recherche. Aujourd’hui, AlphaFold le fait en quelques minutes. C’est l’une des plus grandes avancées scientifiques de la décennie.

6. Les limites du deep learning à connaître

Limite n°1 : Le besoin de données massives

Un réseau profond a besoin de centaines de milliers, voire de millions d’exemples pour bien fonctionner. Dans les domaines où les données sont rares (médecine de précision, marchés financiers extrêmes), le deep learning est moins adapté.

Limite n°2 : La boîte noire (manque d’explicabilité)

On sait souvent qu’un réseau a pris une décision, mais pas toujours pourquoi. C’est problématique dans des domaines sensibles (crédit, justice, santé). L’IA explicable (XAI) est un champ de recherche actif.

Limite n°3 : Le coût énergétique

Entraîner un gros modèle (comme GPT-4) consomme autant d’électricité que des centaines de foyers par an. L’empreinte carbone du deep learning est un enjeu environnemental réel.

Limite n°4 : La fragilité (exemples adversariaux)

Parfois, une modification infime d’une image (invisible à l’œil humain) peut tromper complètement un réseau. C’est un problème de sécurité majeur.

Le saviez-vous ?

Ajouter quelques pixels imperceptibles sur l’image d’un panda peut faire croire à un réseau de neurones qu’il voit… une gibbon. Ces “attaques adversariales” sont un vrai sujet de recherche en cybersécurité IA.

7. Pourquoi le deep learning explose depuis 2012 ?

2012 : La révolution ImageNet

Un réseau appelé AlexNet remporte le concours de reconnaissance d’images avec une marge historique. Pour la première fois, un réseau profond bat tous les algorithmes classiques.

2016 : AlphaGo bat le champion du monde de Go

Le Go est un jeu bien plus complexe que les échecs. DeepMind prouve que le deep learning + renforcement peut atteindre une maîtrise surhumaine.

2017 : L’invention des Transformers

L’article “Attention Is All You Need” introduit l’architecture Transformer, qui deviendra la base de tous les modèles de langage modernes (GPT, BERT, Gemini).

2020-2026 : L’ère des modèles géants

GPT-3, puis GPT-4, Gemini, Claude… Les modèles de langage deviennent capables de conversation, de raisonnement et de génération de code.

10x

taille des modèles multipliée par 10 chaque année (2018-2024)

$1M → $100M

coût d’entraînement d’un modèle de pointe

FAQ

Est-ce que le deep learning est meilleur que le machine learning classique ?

Pas toujours. Le deep learning est meilleur pour les données complexes et massives (images, sons, vidéos, textes). Mais le ML classique reste plus simple, rapide et interprétable pour les données tabulaires (Excel, bases SQL). Choisissez l'outil selon votre problème, pas par hype.

Faut-il un supercalculateur pour faire du deep learning ?

Non ! Pour utiliser des modèles existants (ex : via une API ChatGPT), un simple ordinateur suffit. Pour entraîner de très gros modèles (GPT-4), oui, il faut des milliers de GPU. Mais pour des projets personnels, un GPU grand public (NVIDIA RTX) ou les notebooks gratuits sur Google Colab suffisent.

Combien de données faut-il pour le deep learning ?

Règle approximative : au moins 10 000 exemples pour un problème simple, 1 million pour une performance de pointe. Mais des techniques comme le "transfer learning" permettent de partir de modèles pré-entraînés et d'avoir besoin de seulement quelques centaines d'exemples pour les adapter.

Qu'est-ce qu'un GPU et pourquoi est-ce important ?

Un GPU (Graphics Processing Unit) est une puce capable d'effectuer des milliers de calculs en parallèle. Là où un processeur classique (CPU) ferait les calculs un par un, un GPU les fait tous ensemble. C'est parfait pour les réseaux de neurones, qui sont composés de millions de petits calculs indépendants.

Quelle est la différence entre CNN, RNN et Transformer ?

CNN (Convolutional) : excellent pour les images (reconnaissance, détection). RNN (Récurrent) : bon pour les séquences (texte, sons) mais en voie de disparition. Transformers : le standard actuel pour tout ce qui est séquence (texte, code, audio, vidéo) – utilisé par ChatGPT, Gemini, etc.

Comment débuter en deep learning sans être expert ?

Étape 1 : suivez "Deep Learning for Everyone" (gratuit, Andrew Ng). Étape 2 : testez des modèles pré-entraînés sur Hugging Face. Étape 3 : utilisez Google Colab (gratuit) pour exécuter des notebooks. Étape 4 : suivez le cours "Fast.ai" (gratuit, très pratique). En quelques semaines, vous pourrez créer vos premiers modèles.

Maîtrisez les fondamentaux

Prêt à approfondir vos connaissances ? Devenez incollable sur l’IA en consultant notre : Guide complet : Définition, fonctionnement et applications de l’IA.

9. Conclusion

Le deep learning n’est pas une intelligence “magique”. C’est une technique puissante qui permet aux machines d’apprendre des motifs complexes à partir de grandes quantités de données, en utilisant des réseaux de neurones à plusieurs couches.

Derrière ChatGPT, la reconnaissance faciale, les voitures autonomes ou Midjourney, il y a toujours les mêmes principes : des neurones artificiels, des couches, et beaucoup d’exemples.

Le deep learning ne remplacera pas l’intelligence humaine, mais il est devenu un outil indispensable pour résoudre des problèmes qui étaient hors de portée des ordinateurs il y a seulement dix ans.

À retenir absolument

- Deep learning = réseaux de neurones avec plusieurs couches (“profond”).

- Différence clé : le ML classique a besoin qu’on lui donne les caractéristiques, le DL les trouve tout seul.

- Points forts : images, sons, textes, données massives.

- Points faibles : besoin de beaucoup de données, boîte noire, coût énergétique.

- Applications : ChatGPT, reconnaissance faciale, voitures autonomes, diagnostic médical.

- Pour débuter : Google Colab + cours Fast.ai.