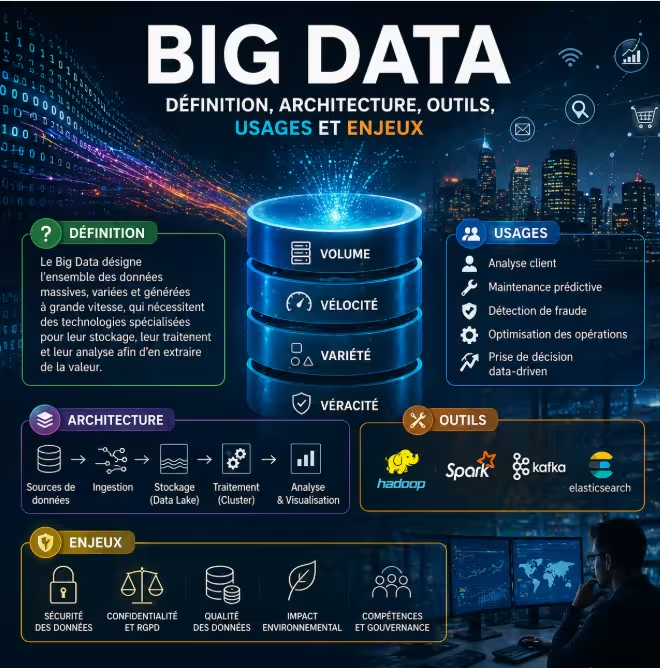

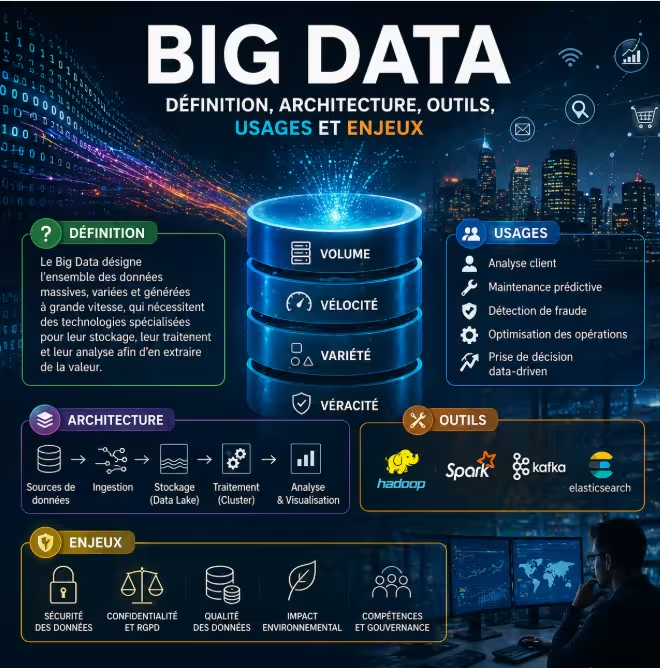

Big Data : définition, architecture, outils, usages et enjeux en 2026

Big Data 2026 : définition, 5V, architectures (data lake, warehouse, mesh), outils (BigQuery, Spark), usages, enjeux environnementaux et éthiques. Guide complet.

Retrouvez les articles publiés dans cette thématique.

Big Data 2026 : définition, 5V, architectures (data lake, warehouse, mesh), outils (BigQuery, Spark), usages, enjeux environnementaux et éthiques. Guide complet.

Une variable instrumentale (ou instrument) est une variable qui permet de contourner les biais dans l'estimation d'un effet causal, en particulier quand on soupçonne l'existence de variables confondantes non observées.

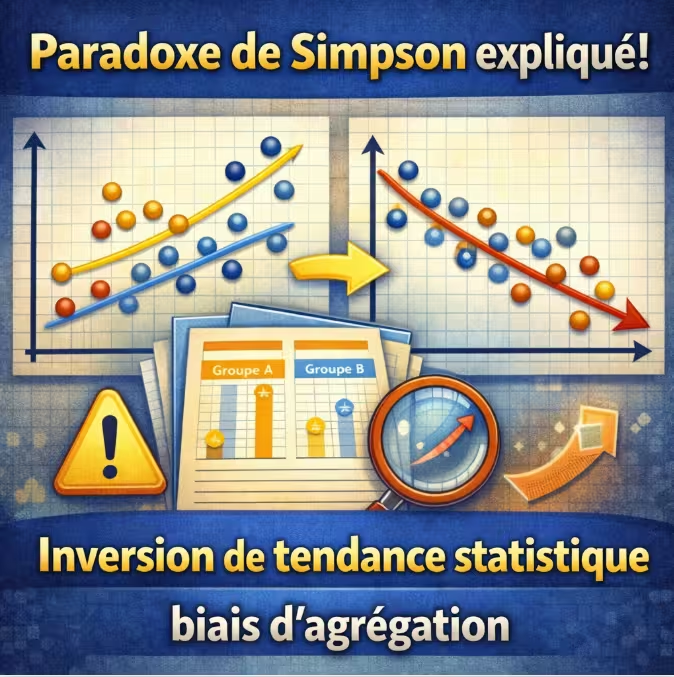

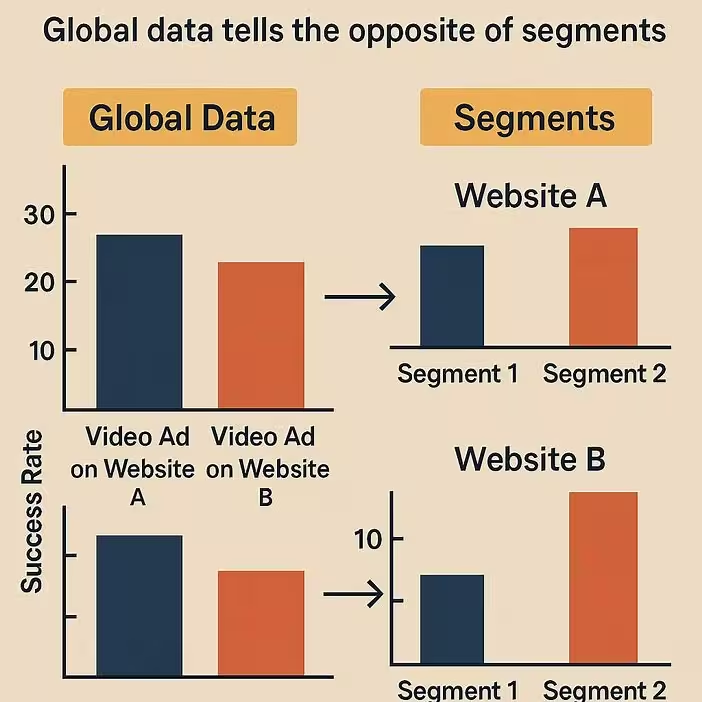

Le paradoxe de Simpson est un phénomène statistique contre-intuitif : une tendance observée dans chaque groupe pris séparément peut s'inverser lorsqu'on regarde les groupes fusionnés.

L'inférence causale est l'ensemble des méthodes statistiques qui permettent de répondre à une question fondamentale : "Cette action a-t-elle vraiment causé ce résultat ?"

Une variable confondante (ou facteur de confusion) est une variable externe qui influence à la fois la cause présumée et l'effet étudié, créant une association trompeuse entre les deux.

La corrélation est une mesure statistique qui quantifie le degré de liaison linéaire entre deux variables. En d'autres termes, elle indique dans quelle mesure deux phénomènes évoluent ensemble.

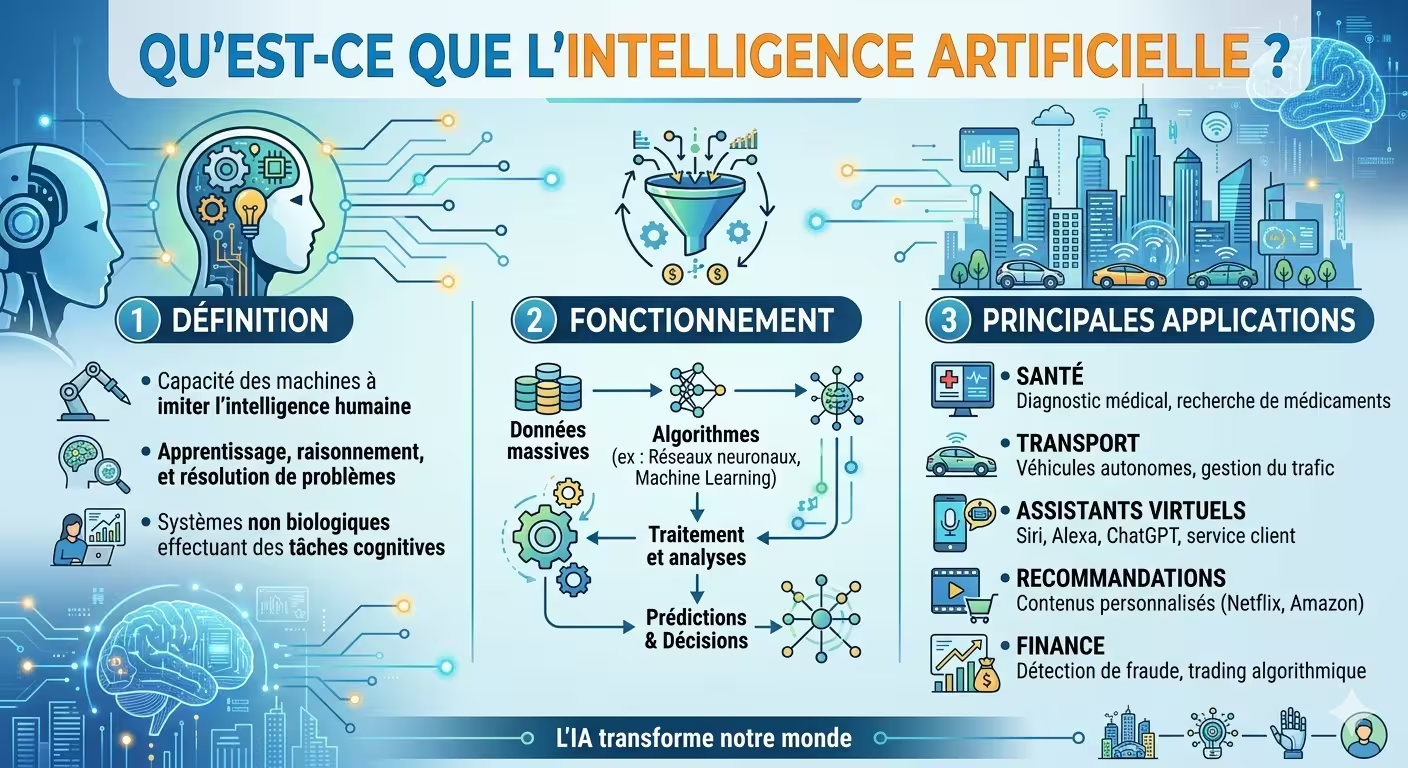

Quand on parle d'intelligence artificielle, on imagine souvent des robots humanoïdes ou des ordinateurs surpuissants. La réalité est plus discrète, mais plus omniprésente. Aujourd'hui, chaque Français interagit avec l'IA

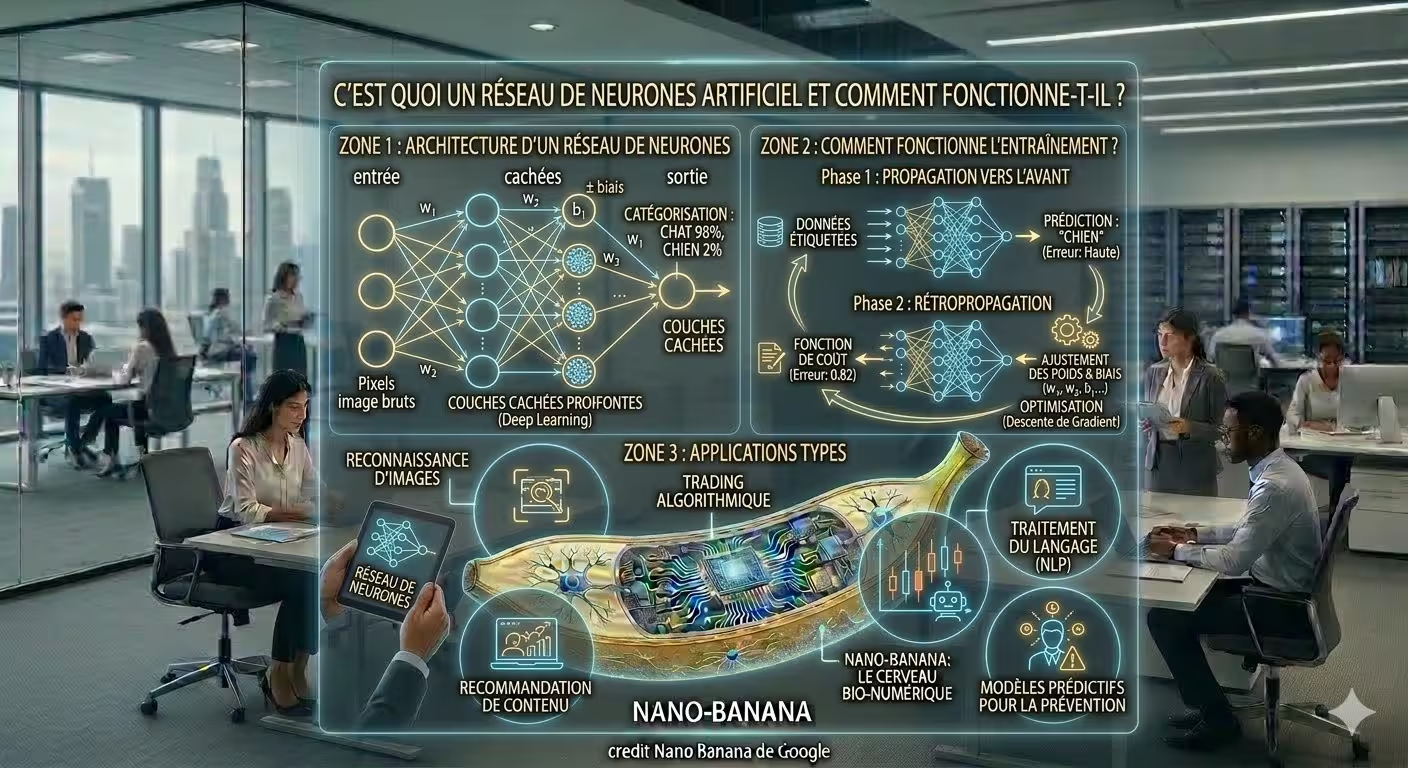

Le deep learning (ou apprentissage profond en français) est une technique avancée de machine learning. Il utilise des réseaux de neurones artificiels comportant plusieurs couches (d'où le terme "profond" / "deep").

Le machine learning (ou apprentissage automatique en français) est une méthode qui permet à un ordinateur d'apprendre à partir d'exemples, sans être programmé avec des règles précises pour chaque situation.

L'intelligence artificielle (IA) est un domaine de l'informatique qui cherche à créer des machines capables d'effectuer des tâches qui nécessitent normalement une intelligence humaine.

Le paradoxe de Simpson désigne une situation statistique dans laquelle une tendance observée dans plusieurs groupes séparés s’inverse ou disparaît lorsque ces groupes sont fusionnés. Dit autrement, chaque segment raconte

L’inférence causale regroupe un ensemble de méthodes statistiques et économétriques visant à estimer l’effet d’une action, d’un traitement, d’une exposition ou d’une décision sur un résultat donné. Le mot important ici n

Un biais cognitif est une déviation systématique de la pensée, une manière récurrente de simplifier la réalité, parfois utile, souvent trompeuse. Dans un contexte d’analyse de données, ces biais influencent la manière do

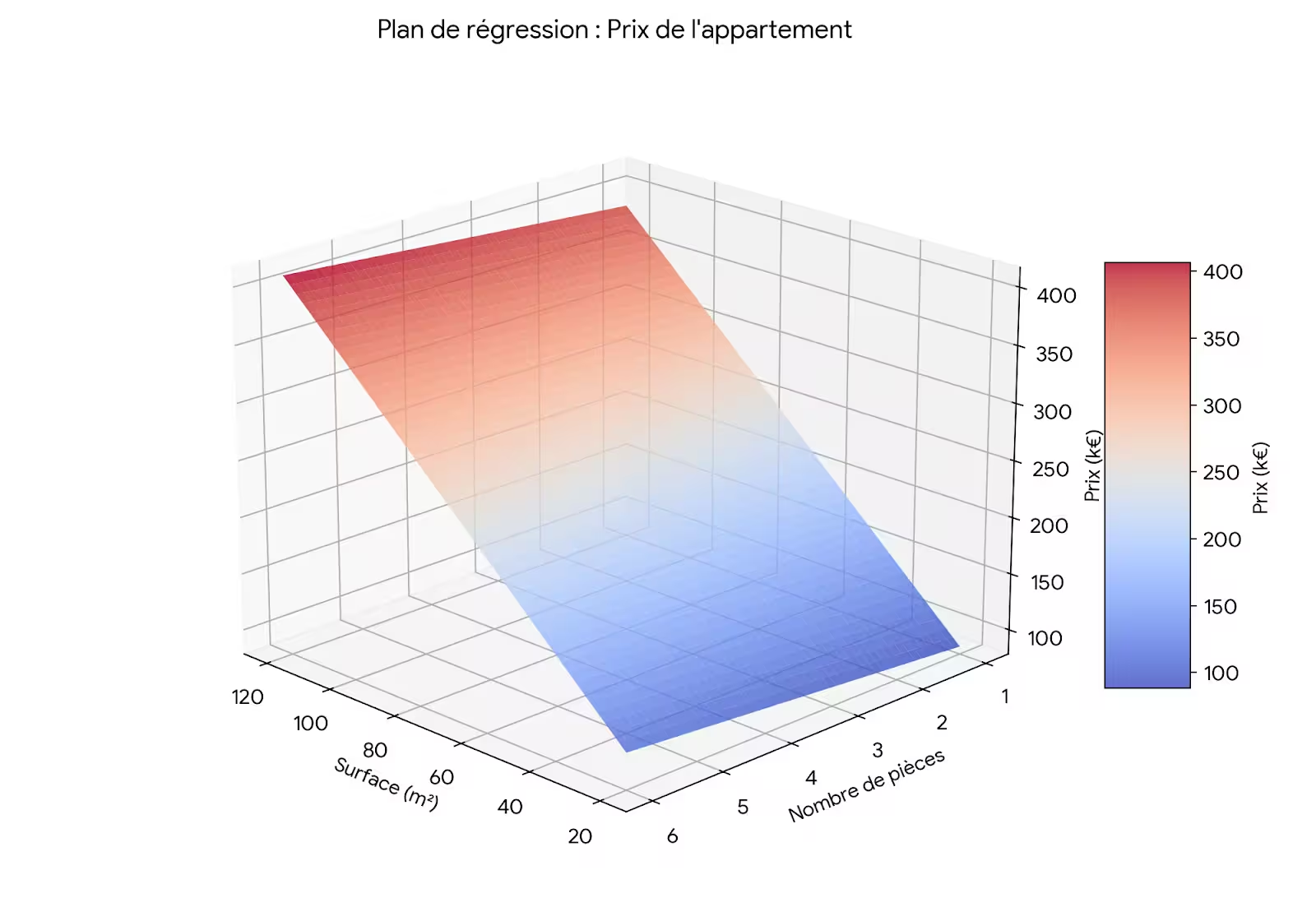

La régression linéaire multiple est une méthode statistique permettant de modéliser la relation entre une variable dépendante et plusieurs variables explicatives. Autrement dit, il ne s’agit plus de comprendre une relati

Un pipeline de données est une chaîne de traitement permettant de collecter, transformer et acheminer des données d’un point A à un point B. Mais cette définition reste presque trop simple. Car en réalité, un pipeline n’

Le Big Data désigne un ensemble de données massives, complexes, et souvent difficiles à traiter avec les outils traditionnels. Mais cette définition reste, en un sens, insuffisante. Elle décrit une quantité, mais pas for

Le traitement du langage naturel, souvent abrégé en NLP (Natural Language Processing), désigne un ensemble de techniques permettant aux machines de comprendre, d’interpréter et de générer du langage humain. Cela peut sem

L’intelligence artificielle générative désigne une catégorie de systèmes capables de produire du contenu nouveau à partir de données d’apprentissage. Contrairement aux algorithmes traditionnels d’analyse de données, ces

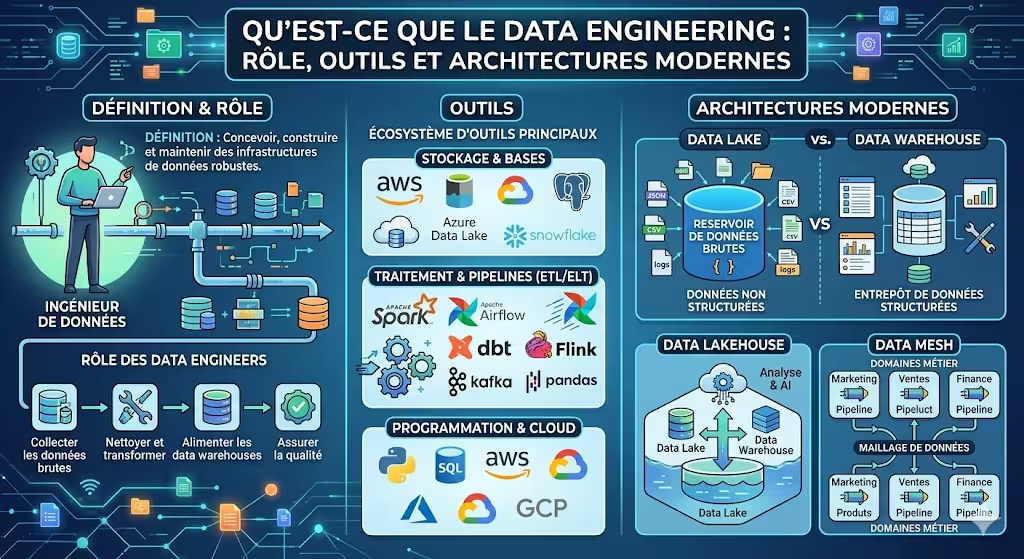

Le Data Engineering correspond à l’ensemble des techniques et infrastructures utilisées pour collecter, stocker, transformer et distribuer les données dans une organisation.

L’analyse exploratoire des données, souvent appelée EDA (Exploratory Data Analysis), désigne l’ensemble des méthodes permettant d’examiner un jeu de données afin d’en comprendre les caractéristiques principales.

Le concept de réseau de neurones artificiels n’est pas récent. Les premières idées remontent aux années 1940 avec les travaux du neurophysiologiste Warren McCulloch et du mathématicien Walter Pitts, qui proposèrent un mo

Le Machine Learning, ou apprentissage automatique, est une branche de l’intelligence artificielle qui permet aux systèmes informatiques d’apprendre à partir des données sans être explicitement programmés pour chaque tâch

Data Science : méthodes, outils, EDA, régression, biais, corrélation vs causalité. Cas pratiques Python/SQL. Guide complet pour maîtriser l’analyse de données.

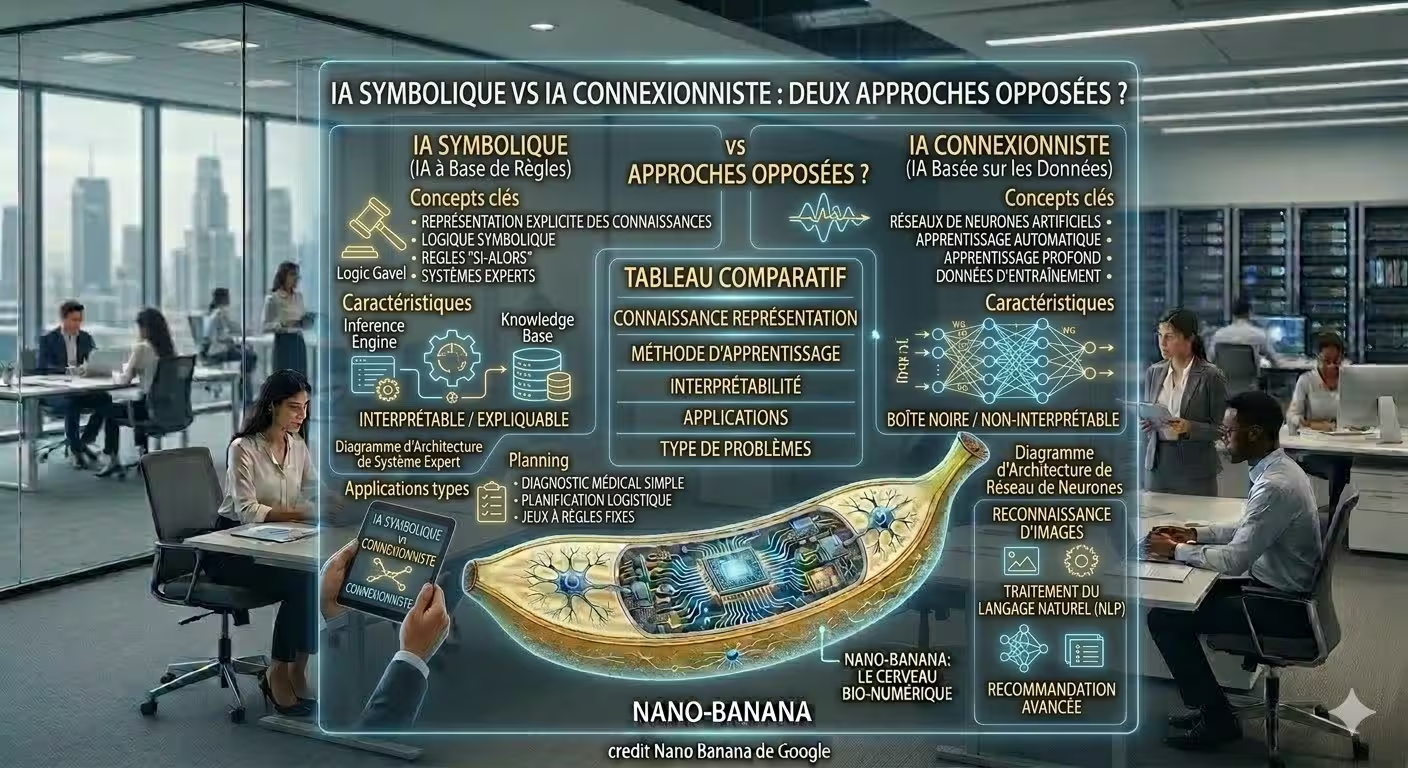

L’expression « intelligence artificielle » est souvent utilisée pour désigner des réalités très différentes : un simple moteur de recommandation, un système de détection de fraude, un chatbot conversationnel, un logiciel

Le Data Engineering se situe au croisement de l’ingénierie logicielle, de l’exploitation, du cloud, de la modélisation analytique et de la gouvernance. C’est la couche qui rend la donnée fiable dans le temps, et pas seul

Un réseau de neurones artificiel est un modèle mathématique inspiré de façon lointaine du cerveau humain. Il est composé de petites unités de calcul, appelées neurones artificiels, organisées en couches. Chaque neurone r

Le sujet paraît parfois historique, presque académique. Pourtant, il revient régulièrement dès qu'il faut expliquer ce qu'est vraiment l'intelligence artificielle. Derrière les succès spectaculaires des modèles récents,

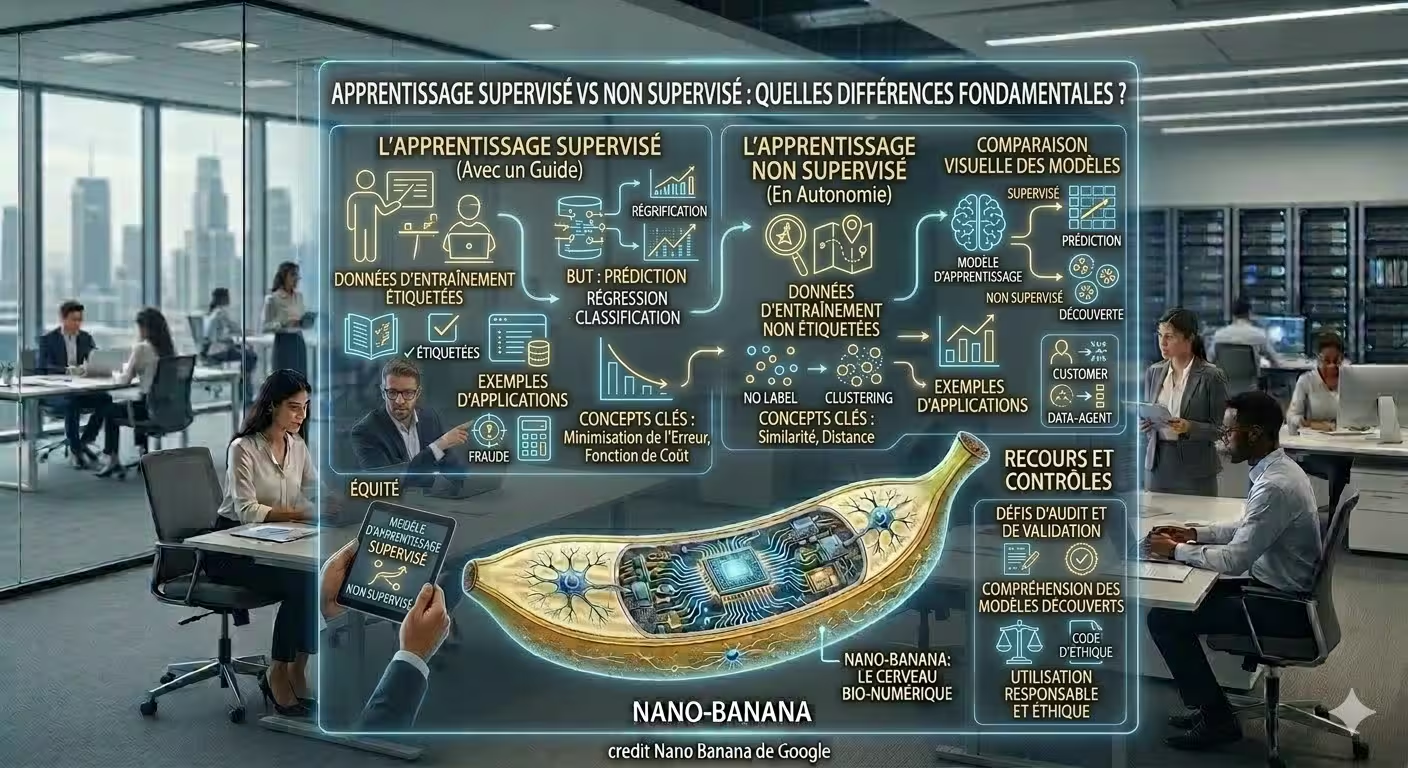

L'opposition entre apprentissage supervisé et apprentissage non supervisé paraît scolaire au premier abord. Pourtant, elle structure presque toute l'histoire du machine learning. Dès qu'un projet de données commence, la

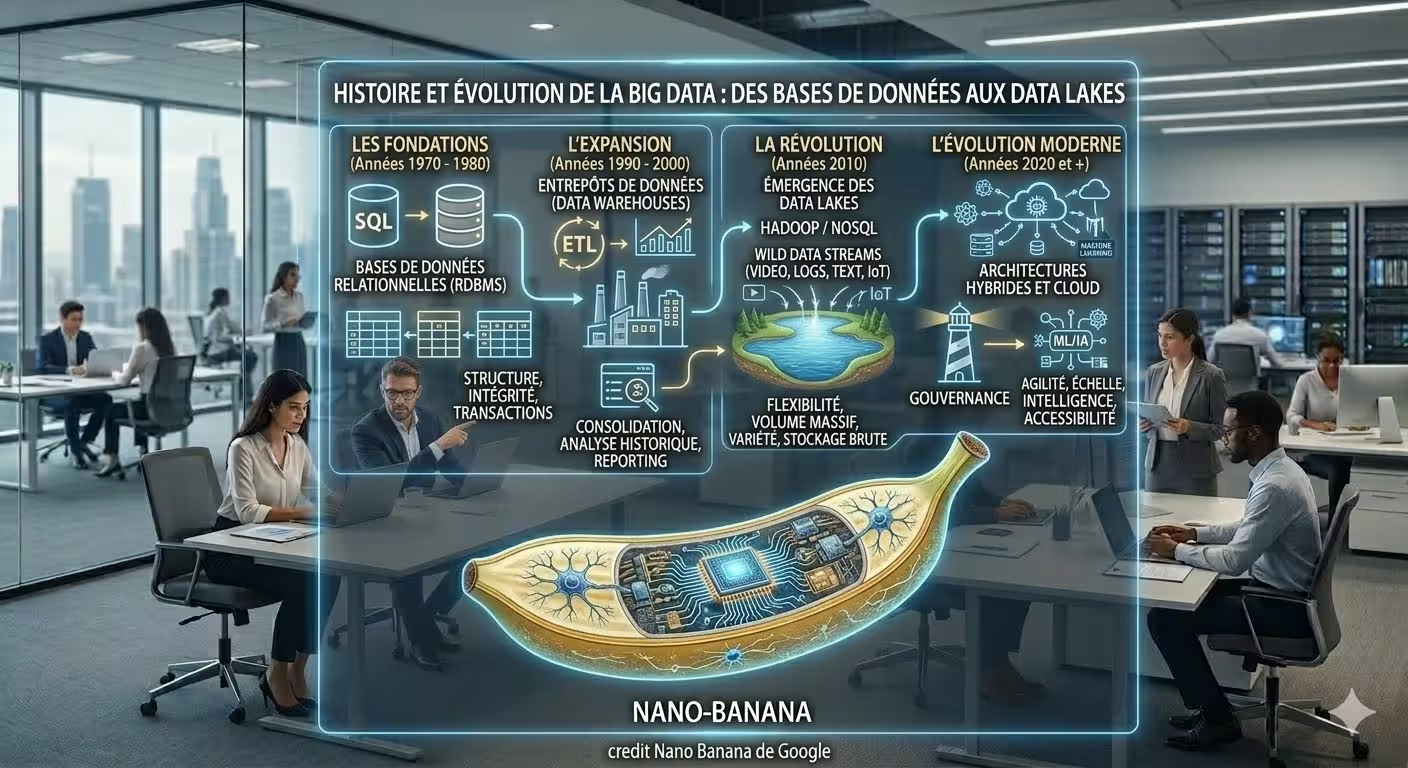

La Big Data n’est pas née d’un coup : c’est une succession de ruptures techniques et d’usages. On passe du SGBDR (transactions) au data warehouse (analytique), puis aux architectures « web-scale » (stockage distribué, ca

Comparatif complet GPT-5 vs Gemini 2.5 Pro : performances, prix, cas d'usage. Quel modèle d'IA choisir en 2026 ?

L’intelligence artificielle, fascinante et controversée, révolutionne notre quotidien. Cet article retrace son évolution, de Turing à l’ère de l’apprentissage profond, en explorant ses applications concrètes, ses enjeux

L'apprentissage automatique (machine learning) designe une famille de methodes qui apprennent des regularites dans les donnees afin de produire une decision, une prediction ou un regroupement. La nuance importante : la r

La loi de Zipf est une loi empirique largement observée dans l’analyse des langues naturelles et des distributions de fréquence. Elle est très pertinente en text mining pour modéliser la distribution des mots dans les do

Dans un monde où chaque entreprise jongle avec des masses impressionnantes de données, l’analytique devient un pilier essentiel pour prendre des décisions fondées sur des faits concrets plutôt que sur des suppositions. L

Avec l'avènement de l'informatique moderne et la montée en flèche de la puissance de calcul, la cryptologie — science qui protège les informations et sécurise les échanges — est devenue un pilier invisible du monde numér

Le data storytelling est une approche qui consiste à transformer des données en un récit structuré afin de faciliter leur compréhension et orienter la prise de décision.

L'analyse des données implique la collecte, l'exploration et l'interprétation de données afin de guider les décisions commerciales. Les données brutes, lorsqu'elles sont correctement analysées, peuvent révéler des schéma

Entre explosion des volumes et nouvelles capacités d’analyse, le Big Data redéfinit profondément la manière dont les organisations exploitent l’information.

Le NLTK, ou Natural Language Toolkit, est une bibliothèque Python spécialement conçue pour le traitement du langage naturel (TLN / NLP). En pratique, c’est un ensemble de modules, de données linguistiques (corpus) et d’a

Vous avez déjà entendu parler de frameworks, de bibliothèques, de plugins et d’add-ons ? Ces termes circulent en permanence dans l’écosystème du développement logiciel. Ils apparaissent dans les documentations, les discu

La qualité des données désigne l’ensemble des caractéristiques qui rendent une donnée exploitable dans un contexte donné. Elle ne se limite pas à l’absence d’erreurs : elle inclut la cohérence, la complétude, la fraîcheu

Vous avez déjà remarqué comment les suggestions de votre moteur de recherche s'affinent au fil du temps ? Ou comment votre boîte mail filtre de mieux en mieux les spams, même quand ceux-ci changent de forme ? Derrière ce

Le mot big data a longtemps donne l impression d une mode. En 2026, il sert surtout a nommer un fait industriel : la donnees n est plus un simple sous-produit des systemes, elle devient une matiere premiere, au meme titr

Les chiffres ci-dessus illustrent un point central : l’IA, et notamment le machine learning, n’est plus une expérimentation marginale. Le volume d’investissement et la pression sur la mise en production rendent le choix

Une donnée est une information brute, non interprétée, qui peut être collectée, stockée et analysée afin de produire du sens.

Des mythes antiques aux romans de science-fiction, l'intelligence artificielle (IA) est restee un objet de fascination et d interrogation. Le terme recouvre pourtant une realite tres concrete : un ensemble de techniques

Les années 2016 à 2024 ont été marquées par une accélération vertigineuse des progrès en matière d'IA. Plusieurs facteurs ont contribué à cette évolution sans précédent dans l'histoire des technologies.