Sommaire

- 1. Pourquoi l’IA générative s’impose en entreprise en 2026

- 2. Usages à fort ROI : où l’IA générative excelle vraiment

- 3. Usages à risques : ce qu’il ne faut pas faire

- 4. Comparatif des outils : ChatGPT Enterprise, Gemini, Claude, Copilot

- 5. Comment déployer l’IA générative dans son entreprise (démarche pas à pas)

- 6. Former ses équipes : compétences et bonnes pratiques

- 7. Risques juridiques et RGPD : ce que dit la loi en 2026

- 8. Tendances 2026-2027 : agents autonomes et intégrations métier

- 9. FAQ — IA générative en entreprise

- 10. Sources

1. Pourquoi l’IA générative s’impose en entreprise en 2026

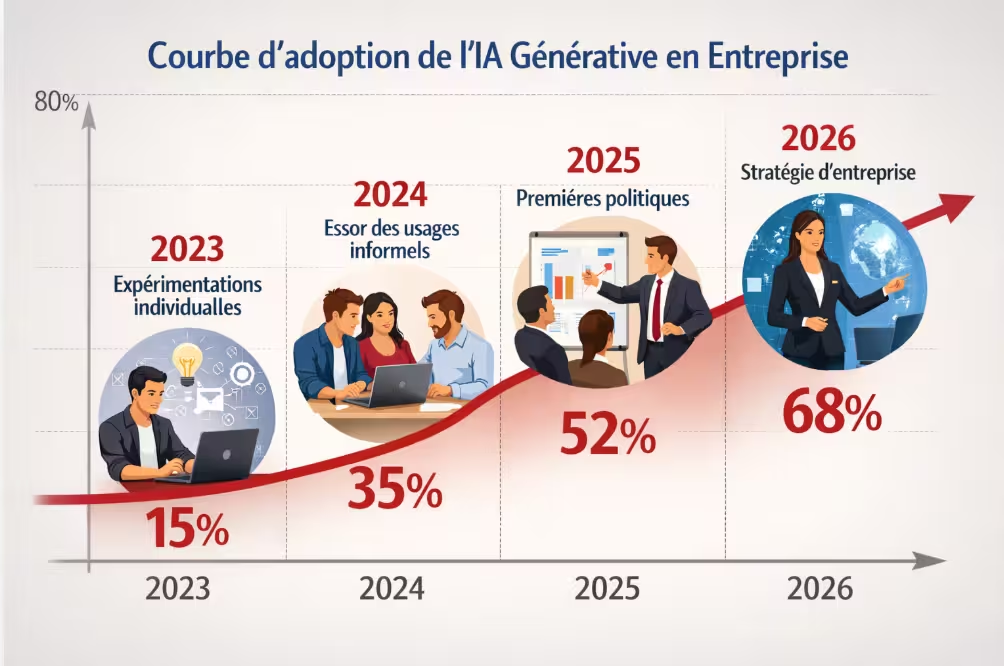

L’année 2023 a marqué l’irruption de l’IA générative dans le grand public avec ChatGPT. 2024 a été celle des expérimentations individuelles : des salariés, souvent dans leur coin, utilisaient l’outil pour rédiger des emails, résumer des documents ou générer des idées. 2025 a vu les premières politiques d’entreprise (interdiction pure et simple, ou au contraire encadrement bienveillant). Et 2026 est l’année de la maturation stratégique : l’IA générative n’est plus une option, mais un impératif concurrentiel pour de nombreuses entreprises.

Ce changement de statut est important : on ne parle plus seulement d’un outil “pratique” pour gagner quelques minutes sur une tâche isolée, mais d’un levier qui touche la productivité, la circulation de la connaissance, la qualité de service, la réactivité commerciale et, à terme, la structure même de certains processus métier. Là où l’automatisation classique imposait souvent des règles fixes et des cas bien cadrés, l’IA générative introduit une couche de souplesse nouvelle : elle sait reformuler, synthétiser, extraire, proposer, comparer, résumer et assister la décision dans des contextes semi-structurés.

Plusieurs facteurs expliquent cette accélération soudaine. D’abord, la maturité technologique : les modèles de 2026 (GPT-5 partiel, Gemini Ultra 2.0, Claude 4 Opus) sont bien plus fiables, moins « hallucinants » et mieux adaptés aux contextes professionnels que leurs prédécesseurs de 2023. Ensuite, la disponibilité d’offres enterprise : OpenAI, Google, Anthropic et Microsoft proposent désormais des versions dédiées aux entreprises avec des garanties de confidentialité, des contrats de sous-traitance conformes au RGPD, et des interfaces d’administration centralisée. Enfin, la pression concurrentielle : les entreprises qui n’adoptent pas l’IA générative subissent un handicap de productivité croissant face à celles qui l’ont intégrée.

Il faut aussi ajouter un facteur moins visible mais déterminant : la qualité des fondations data et techniques. Une entreprise qui maîtrise déjà ses flux documentaires, ses accès, ses référentiels, sa gouvernance et ses outils collaboratifs déploie l’IA beaucoup plus vite qu’une organisation fragmentée. C’est pourquoi les sujets de Data Engineering, de Data Science et d’intelligence artificielle au sens large forment désormais un triptyque cohérent dans la transformation des entreprises.

68 %

des entreprises de +50 salariés utilisent l’IA générative

étude McKinsey, janvier 2026

+37 %

de gain de productivité sur les tâches rédactionnelles

NBER, étude terrain 2025

22 Mds $

marché IA générative B2B (2026)

Gartner, projection

Infographie n°1 – Courbe d’adoption de l’IA générative en entreprise : de l’expérimentation individuelle à la stratégie d’entreprise (2023-2026).

À retenir

En 2026, la vraie question n’est plus « faut-il tester l’IA générative ? », mais « sur quels usages doit-on la déployer en priorité, avec quels garde-fous, quels outils et quels indicateurs ? ». Autrement dit : on passe d’une logique d’effet de mode à une logique de portefeuille d’usages, de gouvernance et de rentabilité.

2. Usages à fort ROI : où l’IA générative excelle vraiment

Tous les usages de l’IA générative ne se valent pas. Certains apportent un retour sur investissement rapide et mesurable ; d’autres restent anecdotiques ou même contre-productifs. Voici les domaines où l’IA générative a fait ses preuves en entreprise.

Assistance à la rédaction (emails, notes internes, comptes rendus)

Le cas d’usage le plus répandu et le plus mature. L’IA aide à rédiger des emails professionnels (propositions commerciales, réponses à des réclamations, relances), des notes de synthèse, des comptes rendus de réunion (à partir de notes brutes ou de transcriptions), et des comptes rendus d’entretien. Gain de temps typique : 30 à 50 % sur ces tâches, avec une qualité souvent supérieure à celle d’un premier jet rédigé à la hâte.

Dans beaucoup d’entreprises, cette assistance rédactionnelle est la porte d’entrée idéale : le risque est modéré, l’appropriation est rapide et le bénéfice perçu par les équipes est immédiat. C’est aussi un excellent terrain pour apprendre à mieux formuler ses demandes, à structurer un brief et à instaurer des règles de validation humaine.

Génération de contenu marketing (premier jet)

Articles de blog, fiches produits, descriptions pour site e-commerce, posts pour réseaux sociaux, newsletters : l’IA génère un premier jet structuré, que le rédacteur humain retravaille, personnalise et valide. L’équipe marketing peut ainsi produire deux à trois fois plus de contenu à budget constant, ou maintenir le volume avec une équipe réduite.

La vraie valeur n’est pas seulement la vitesse. Elle réside aussi dans la capacité à décliner rapidement un même message selon plusieurs audiences, formats ou canaux. Une offre peut ainsi être reformulée pour un site web, une campagne email, une fiche produit, un argumentaire commercial et un post social sans repartir de zéro à chaque fois.

Synthèse et analyse de documents volumineux

Un contrat de 50 pages, un rapport annuel de 200 pages, une revue de presse de 30 articles : l’IA peut résumer, extraire les points clés, répondre à des questions précises (« que dit le contrat sur la durée de préavis ? »), et même comparer plusieurs documents. Des outils comme Claude (200 000 tokens de contexte, soit environ 150 000 mots) ou Gemini 1.5 Pro (2 millions de tokens) excellent sur cet usage.

Ce cas d’usage est particulièrement puissant dans les fonctions support : juridique, achats, conformité, direction générale, veille stratégique, ressources humaines, qualité. Dès qu’il faut lire beaucoup, vite, sans perdre les points clés, l’IA générative agit comme un accélérateur documentaire. Elle ne remplace pas l’expertise, mais elle réduit le temps consacré au tri, au survol et à la première extraction d’informations.

Traduction et localisation

Les modèles modernes (GPT-4o, Gemini, Claude) traduisent dans des dizaines de langues avec une qualité équivalente ou supérieure aux solutions spécialisées (DeepL) pour les textes généraux. Pour les textes techniques ou juridiques, une relecture humaine reste recommandée, mais le gain de temps est considérable.

La localisation va d’ailleurs au-delà de la simple traduction : adaptation du ton, reformulation culturelle, raccourcissement ou allongement selon les contraintes du canal, homogénéisation terminologique. Pour une entreprise exportatrice ou multilingue, le gain cumulé devient très significatif.

Idéation et brainstorming assisté

« Propose dix noms pour ce nouveau produit », « Quels sont les arguments de vente potentiels pour cette offre ? », « Quelles questions anticiper de la part des clients ? » — l’IA ne remplace pas la créativité humaine, mais elle l’augmente en suggérant des pistes, en débloquant les situations de page blanche, et en apportant des angles auxquels on n’avait pas pensé.

Ce type d’usage est souvent sous-estimé parce qu’il paraît “moins sérieux” que l’automatisation. Pourtant, il accélère les phases amont de cadrage, de préparation de réunion, de scénarisation commerciale ou d’animation éditoriale. Il est particulièrement utile dans les PME où les équipes portent plusieurs casquettes et doivent produire vite avec peu de ressources.

Recherche documentaire augmentée et bases de connaissance internes

Au-delà de la simple génération, l’un des meilleurs retours sur investissement provient de la recherche augmentée sur des contenus internes : procédures, politiques RH, documentation produit, FAQ, contrats, comptes rendus, guides qualité, documentation support, historiques de tickets. Au lieu d’obliger les salariés à naviguer dans des arborescences complexes, l’entreprise peut mettre en place une interface conversationnelle qui répond à partir de ses propres sources.

Ce type d’usage, souvent fondé sur une logique de RAG (Retrieval-Augmented Generation), nécessite cependant une bonne hygiène documentaire, un minimum de gouvernance et une réflexion sur les droits d’accès. Il constitue une extension naturelle des sujets abordés dans les pipelines de données et dans les réflexions plus larges sur la structuration des flux de connaissance en entreprise.

Chiffre clé – ROI concret

Selon une étude de Boston Consulting Group menée auprès de 758 entreprises (publiée en juin 2025), les entreprises qui ont déployé l’IA générative sur au moins trois cas d’usage constatent en moyenne une réduction de 27 % des coûts opérationnels sur les périmètres concernés et une amélioration de 22 % de la satisfaction client (CSAT). Le retour sur investissement est positif dès la première année dans 64 % des cas.

Où commencer en priorité ?

Les meilleurs usages de départ sont généralement ceux qui combinent quatre critères : forte fréquence, faible criticité, contrôle humain facile et bénéfice immédiatement visible. C’est pourquoi la rédaction assistée, la synthèse documentaire, la recherche interne et certains usages marketing sont souvent les meilleurs candidats pour un premier déploiement.

3. Usages à risques : ce qu’il ne faut pas faire

Tout aussi important que de savoir ce que l’IA peut faire, il faut savoir ce qu’il ne faut pas lui confier — du moins sans précautions extrêmes.

Ne jamais injecter de données confidentielles ou personnelles

C’est la règle d’or, trop souvent violée. Les versions gratuites ou grand public des outils IA (ChatGPT gratuit, Gemini gratuit, etc.) utilisent les conversations pour entraîner et améliorer leurs modèles. Si un salarié y copie un fichier client, un contrat confidentiel, une liste de salaires ou des données personnelles (nom, adresse, numéro de téléphone), ces informations peuvent potentiellement resurgir dans les réponses données à d’autres utilisateurs. Les versions « Enterprise » (payantes) offrent des garanties contractuelles de non-utilisation des données, mais même avec celles-ci, la prudence reste de mise.

Le risque ne vient pas seulement d’une “fuite spectaculaire”. Il peut aussi résider dans des usages quotidiens banalisés : copier-coller un échange client, résumer un dossier RH, demander une reformulation à partir d’une proposition commerciale non signée, faire analyser un litige contractuel ou un incident interne. Sans politique claire, ces micro-usages s’accumulent et créent une exposition réelle.

Ne pas confier de décisions automatisées sans supervision humaine

L’IA générative peut « halluciner » — inventer des faits, des citations, des références juridiques inexistantes. Confier à un LLM une décision importante (recrutement, crédit, diagnostic médical) sans validation humaine est dangereux et, dans certains secteurs, illégal (ex : règlement européen sur l’IA — AI Act — qui classe certains usages comme « à haut risque »).

Même lorsqu’il n’y a pas d’illégalité manifeste, le risque organisationnel est réel : une équipe peut prendre l’habitude de “faire confiance” à la machine parce que les réponses sont fluides, argumentées et rapides. C’est précisément ce confort apparent qui rend la vigilance indispensable. Sur les enjeux de biais, d’équité et de responsabilité, les lectures Biais algorithmiques et IA et RGPD complètent utilement ce point.

Se méfier de l’excès de confiance

Un texte généré par IA semble souvent très convaincant, bien écrit, structuré. Cette apparence de compétence peut conduire à une validation trop rapide. Des études montrent que les utilisateurs non experts valident les réponses de l’IA comme correctes dans 70 à 80 % des cas, alors que le taux d’erreur réel sur des sujets complexes peut atteindre 20 à 30 %. La relecture humaine critique est indispensable.

Éviter les usages “vitrine” sans utilité réelle

Beaucoup d’entreprises sont tentées de lancer un chatbot ou un assistant IA simplement parce que “tout le monde en parle”. Or un mauvais cas d’usage coûte cher : temps de cadrage, intégration, licences, formation, déception des équipes, parfois image dégradée auprès des clients. Avant tout projet, il faut poser une question simple : le problème à résoudre est-il réellement important, fréquent et suffisamment stable pour justifier une solution pilotée par IA ?

Attention aux contenus juridiques, RH et contractuels non relus

Les modèles peuvent être très utiles pour résumer un contrat, reformuler une clause, extraire des obligations ou préparer une trame. En revanche, publier, envoyer ou signer un document important sans relecture humaine reste une mauvaise pratique. En RH, cela vaut pour les offres d’emploi, les comptes rendus sensibles, les messages liés à la performance ou aux sanctions. En juridique, cela vaut pour les analyses, clauses, réponses à un litige ou communications engageantes.

Règle de bon sens

Appliquez la « règle des trois C » : ne confiez à l’IA que ce qui est Courant, Contrôlable et Corrigible. Courant : des tâches fréquentes où l’erreur est peu coûteuse. Contrôlable : vous pouvez vérifier facilement le résultat. Corrigible : une erreur peut être rattrapée sans dommage majeur. En dehors de ce périmètre, la supervision humaine est obligatoire.

4. Comparatif des outils : ChatGPT Enterprise, Gemini, Claude, Copilot

Le choix de l’outil dépend de vos besoins spécifiques, de votre budget et de votre infrastructure existante (Microsoft, Google Workspace, etc.). Voici un tableau comparatif des principales offres « entreprise » en 2026.

| Outil | Version Enterprise | Prix indicatif (par utilisateur/mois) | Force principale | Intégration native |

|---|---|---|---|---|

| ChatGPT Enterprise | OpenAI | 60-80 € (négociable) | Polyvalence, qualité générale, vaste écosystème de plugins | API, peu d’intégrations bureautiques natives |

| Gemini for Google Workspace | 30-40 € (en sus de Workspace) | Intégration Gmail, Docs, Sheets, Meet, Slides | Google Workspace (excellente) | |

| Microsoft Copilot | Microsoft 365 Copilot | 30 € (licence Microsoft 365 requise) | Intégration Word, Excel, PowerPoint, Outlook, Teams | Microsoft 365 (excellente) |

| Claude Enterprise | Anthropic | 50-70 € | Très grand contexte (200k tokens), moindre hallucination | API, peu d’intégrations natives |

Tableau comparatif mis à jour en avril 2026. Les prix sont indicatifs et varient selon le volume d’utilisateurs, la durée d’engagement et les fonctionnalités optionnelles.

Recommandation : Si votre entreprise utilise déjà Microsoft 365, Copilot est un choix naturel (intégration transparente). Si vous êtes sur Google Workspace, Gemini s’impose. Pour des usages très spécifiques (analyse de très longs documents), Claude est imbattable. ChatGPT Enterprise reste le plus polyvalent et le plus riche en fonctionnalités, mais sans intégration bureautique poussée.

En réalité, le meilleur choix n’est pas toujours le “meilleur modèle” en valeur absolue. Il dépend surtout de votre environnement de travail, de vos contraintes de sécurité, du niveau d’autonomie attendu, de votre besoin d’intégration et de la maturité des équipes. Une entreprise très outillée dans Microsoft 365 gagnera souvent davantage avec un outil nativement intégré qu’avec un modèle plus puissant mais isolé. À l’inverse, une équipe qui travaille sur des dossiers longs, complexes et peu standardisés pourra privilégier la longueur de contexte ou la qualité de synthèse.

Pour compléter ce comparatif, il peut être pertinent de relier cette section à notre comparatif GPT-4o, Gemini Ultra et Claude 4, ainsi qu’à des contenus plus larges sur les outils et technologies ou sur les plateformes cloud pour l’IA.

Conseil de sélection

Ne choisissez pas seulement un outil : choisissez un cadre d’usage. Qui y a accès ? Sur quels cas d’usage ? Avec quelles règles de sécurité ? Quels logs, quels droits, quels connecteurs, quel support, quelle formation ? Sans cette couche de pilotage, même le meilleur outil finit mal utilisé.

5. Comment déployer l’IA générative dans son entreprise (démarche pas à pas)

Passer de l’expérimentation individuelle à un déploiement structuré nécessite une méthode. Voici les étapes recommandées par les cabinets de conseil spécialisés.

Étape 1 : Audit des usages existants

Quels salariés utilisent déjà l’IA générative (même sans autorisation officielle) ? Pour quels usages ? Avec quels outils (versions gratuites ou payantes) ? Un audit interne, de préférence anonyme, permet de cartographier les pratiques réelles et d’identifier les risques (fuites de données notamment).

Étape 2 : Définition d’une politique d’entreprise

Rédigez une charte d’utilisation de l’IA générative qui précise : les usages autorisés et interdits, les outils recommandés (versions Enterprise avec garanties), la procédure en cas de doute, les obligations de relecture humaine, et les sanctions en cas de non-respect.

Étape 3 : Choix des outils et déploiement pilote

Sélectionnez un ou deux outils adaptés à vos besoins (voir tableau comparatif). Déployez-les d’abord auprès d’une équipe pilote (10 à 30 personnes volontaires, représentatives des métiers). Formez-les, recueillez leurs retours, mesurez les gains de productivité.

Étape 4 : Formation généralisée

Sur la base du pilote, déployez à plus grande échelle. Organisez des sessions de formation obligatoires : comment rédiger un prompt efficace, comment vérifier les réponses, quelles données ne jamais partager, comment signaler une anomalie.

Étape 5 : Suivi et amélioration continue

Mesurez régulièrement l’adoption (quel pourcentage d’utilisateurs actifs ?), les usages dominants, les gains de productivité, et les incidents éventuels. Ajustez la politique, les outils, les formations en conséquence.

Dans la réalité, cette séquence fonctionne encore mieux si l’on ajoute une logique de priorisation des cas d’usage. Il est rarement pertinent de lancer l’IA générative partout à la fois. Il vaut mieux choisir trois à cinq usages ciblés, avec un sponsor métier, un indicateur de résultat, un périmètre clair et une politique de validation. Cette focalisation permet d’éviter la dispersion et de prouver rapidement la valeur.

Autre point souvent négligé : le déploiement d’un assistant ou d’un copilote ne suffit pas. Il faut aussi penser aux documents de référence, aux bases de connaissance, aux circuits de validation, à la qualité des sources et à la gouvernance des accès. Autrement dit, une part importante du succès dépend de la préparation des contenus et des flux internes, ce qui renvoie indirectement à des sujets plus structurels de donnée et d’organisation.

Conseil de déploiement

Ne sous-estimez pas l’étape de formation. La plupart des salariés ne savent pas rédiger un prompt efficace. Un prompt vague (« écris un email ») donne un résultat médiocre. Un prompt structuré (contexte, rôle, instruction précise, format, ton, contraintes) donne un résultat utilisable. Une demi-journée de formation change la donne.

Le bon rythme de déploiement

Le meilleur scénario n’est généralement ni le “big bang” ni l’expérimentation anarchique. C’est un déploiement progressif, piloté, documenté, avec un sponsor métier, un retour terrain rapide et des itérations courtes. L’important n’est pas de déployer vite partout, mais de déployer juste là où la valeur est nette.

6. Former ses équipes : compétences et bonnes pratiques

La formation à l’IA générative ne consiste pas à apprendre à « programmer » ou à « coder ». Il s’agit avant tout d’acquérir une nouvelle compétence rédactionnelle : l’art du prompt. Voici les éléments clés à intégrer dans votre plan de formation.

Les bases du prompt engineering

Un bon prompt suit généralement une structure en quatre parties : 1) Contexte : quel est le cadre ? 2) Rôle : qui est l’IA (expert, conseiller, rédacteur) ? 3) Instruction : que faire exactement ? 4) Format et ton : comment présenter la réponse ? Exemple : « Tu es un expert en communication commerciale. Rédige un email de relance pour un client qui n’a pas donné suite à notre proposition. Le ton doit être courtois mais pas insistant. Structure : rappel de la proposition, valeur ajoutée rappelée, proposition d’un appel de 5 minutes, formule de politesse. »

La vérification des faits (fact-checking)

L’IA « hallucine » régulièrement, surtout sur des sujets précis ou récents. Il faut former les équipes à ne jamais prendre une réponse IA pour argent comptant, surtout quand elle cite des chiffres, des dates, des noms, des références juridiques ou des études. La règle : « l’IA propose, l’humain dispose ».

L’amélioration itérative

Un premier résultat est rarement parfait. La compétence clé est de savoir affiner le prompt en fonction du résultat obtenu : « plus concis », « ajoute un exemple », « change le ton pour qu’il soit plus formel », « structure en trois paragraphes avec sous-titres ». Cette boucle de rétroaction est au cœur de l’utilisation efficace de l’IA.

La lecture critique des réponses

Former à l’IA, ce n’est pas seulement apprendre à poser de bonnes questions. C’est aussi apprendre à repérer une réponse trop sûre d’elle, trop vague, trop “générique”, insuffisamment sourcée ou mal calibrée par rapport au contexte métier. Une bonne formation doit inclure des exercices de comparaison entre une sortie brute, une sortie corrigée et une sortie réellement validable dans le cadre professionnel.

Les règles d’hygiène informationnelle

Les équipes doivent savoir ce qu’elles peuvent transmettre, ce qu’elles doivent anonymiser, ce qu’elles ne doivent jamais copier-coller dans un outil externe, et comment distinguer un usage à faible risque d’un usage sensible. Cette sensibilisation rejoint les enjeux plus larges abordés dans les contenus liés à l’IA et au RGPD et au droit d’auteur appliqué à l’IA générative.

15 %

des entreprises ont formé plus de 50 % de leurs salariés

Coursera / Workday, 2026

4 heures

de formation moyenne recommandée

recommandation McKinsey

+42 %

de qualité perçue après formation

étude interne OpenAI, 2025

Bonne pratique formation

Prévoyez des ateliers par métier plutôt qu’une sensibilisation unique pour toute l’entreprise. Les besoins d’un commercial, d’un juriste, d’un chargé RH, d’un marketeur ou d’un support client ne sont pas les mêmes. Les exemples de prompts et les risques doivent donc être contextualisés.

7. Risques juridiques et RGPD : ce que dit la loi en 2026

Le cadre juridique de l’IA générative en entreprise s’est précisé ces deux dernières années. Voici les principaux points à connaître pour les entreprises européennes.

Le règlement européen sur l’IA (AI Act)

Entré en application progressive à partir de 2025, l’AI Act classe les systèmes d’IA en fonction de leur niveau de risque. L’utilisation de l’IA générative dans l’entreprise n’est pas interdite, mais elle impose des obligations de transparence : informer les utilisateurs qu’ils interagissent avec une IA, publier un résumé des données d’entraînement, et mettre en place une supervision humaine pour les usages « à haut risque » (ex : recrutement automatisé, évaluation de solvabilité).

Le RGPD et la protection des données personnelles

Le RGPD reste pleinement applicable. Si l’IA générative traite des données personnelles (nom, email, adresse, etc.), l’entreprise doit respecter les principes de minimisation, de finalité et de sécurité. L’injection de données personnelles dans un modèle tiers (ex : ChatGPT) est généralement interdite sans consentement explicite des personnes concernées et sans garanties contractuelles du fournisseur. Les versions « Enterprise » avec clauses RGPD sont une solution, mais la prudence reste de mise.

Propriété intellectuelle des contenus générés

En droit européen, un contenu généré entièrement par IA n’est pas éligible au droit d’auteur, faute d’auteur humain. En revanche, un contenu « augmenté » par l’IA avec une contribution humaine significative (sélection, arrangement, modification) peut être protégé. Pour les entreprises, il est conseillé de conserver une trace de la relecture et de la validation humaine, et d’éviter de revendiquer un droit d’auteur exclusif sur du contenu 100 % IA.

Traçabilité, politiques internes et responsabilité

Au-delà des textes, une entreprise doit pouvoir démontrer qu’elle a organisé l’usage de l’IA : charte interne, droits d’accès, choix d’outils, règles d’anonymisation, processus de validation, documentation des usages sensibles, conservation des versions finales. Ce n’est pas qu’un sujet de conformité ; c’est aussi un sujet de preuve et de responsabilité en cas de litige, d’erreur ou de contrôle.

Sur ces questions, il peut être judicieux d’insérer dans votre maillage des liens vers Droit d’auteur et IA générative, IA et RGPD et, plus largement, vers la rubrique Éthique et société.

Recommandation juridique

Faites-vous accompagner par un avocat spécialisé en droit du numérique pour rédiger votre politique interne d’utilisation de l’IA générative. Les contentieux sur ce sujet commencent à émerger (fuites de données, utilisation non autorisée d’œuvres protégées, non-respect du RGPD). Mieux vaut prévenir que guérir.

8. Tendances 2026-2027 : agents autonomes et intégrations métier

L’IA générative ne va pas stagner. Plusieurs tendances structurent les 18 prochains mois et doivent influencer votre stratégie d’entreprise.

Des « agents » autonomes qui exécutent des tâches

Au lieu de simplement répondre à des questions, les prochaines générations d’IA pourront agir : envoyer des emails, mettre à jour un CRM, programmer des réunions, déclencher des paiements, etc. Ces « agents IA » fonctionneront sous supervision humaine, mais automatiseront des chaînes complètes de tâches. Les entreprises doivent anticiper cette évolution en identifiant quels processus pourraient être confiés à des agents.

Cette promesse est séduisante, mais elle change d’échelle par rapport au simple assistant conversationnel. Dès qu’un système peut agir sur un outil, déclencher une opération ou modifier un état métier, on passe d’une logique d’assistance à une logique d’exécution. Les exigences de contrôle, de journalisation, de permissions et de rollback deviennent alors beaucoup plus fortes.

L’intégration verticale par secteur

Les modèles génériques (ChatGPT, Gemini) laissent progressivement place à des modèles spécialisés par secteur : juridique (Harvey), médical (Glass Health), financier (Bloomberg GPT), etc. Ces modèles, entraînés sur des données de domaine, sont plus précis et moins hallucinants. Les entreprises devraient évaluer ces offres spécialisées plutôt que de tout faire avec un modèle généraliste.

Cette verticalisation est logique : plus les enjeux métier sont fins, plus la connaissance du contexte sectoriel compte. Un outil spécialisé peut mieux comprendre les contraintes documentaires, le vocabulaire, les typologies de dossiers, les règles implicites ou les formats attendus.

Le déploiement local (on-premise) pour la confidentialité

Pour les entreprises très sensibles à la confidentialité (défense, banque, santé, R&D stratégique), les modèles déployés en interne (sur leurs propres serveurs) deviennent une option réaliste. Des modèles comme Llama 4, Mistral Large 3 ou Falcon 3 peuvent être exécutés localement avec des performances proches des modèles cloud. Le coût (matériel, maintenance) reste élevé, mais la tendance est à la baisse.

Des intégrations métier plus discrètes mais plus utiles

Le futur de l’IA en entreprise ne sera pas forcément spectaculaire. Il sera souvent plus diffus : suggestions dans l’outil métier, génération assistée dans le CRM, aide à la qualification dans le support, préparation de trames dans les RH, recherche contextuelle dans l’intranet, extraction structurée dans les achats, enrichissement documentaire dans le juridique. L’IA devient moins “visible” mais plus intégrée au travail réel.

2027

année prévue pour la généralisation des « agents IA »

Gartner, 2026

25 %

des entreprises utiliseront un modèle spécialisé secteur (2027)

IDC, projection

Lecture stratégique

La prochaine vague ne consistera pas seulement à “mieux répondre”, mais à mieux s’insérer dans les processus, les outils et les règles métier. Les entreprises qui gagneront ne seront pas forcément celles qui utilisent le modèle le plus impressionnant, mais celles qui intégreront proprement l’IA dans des usages concrets, contrôlés et rentables.

FAQ

Quelle est la différence entre les versions gratuites et les versions Enterprise ?

Les versions gratuites utilisent vos conversations pour entraîner les modèles (risque de fuite de données confidentielles), n’offrent aucune garantie contractuelle, et ne respectent pas le RGPD par défaut. Les versions Enterprise proposent des garanties de non-utilisation des données, des contrats de sous-traitance conformes au RGPD, une interface d’administration centralisée (gestion des utilisateurs, logs), et souvent des fonctionnalités avancées (plus de contexte, API plus rapides). Le surcoût (30 à 80 €/utilisateur/mois) est généralement justifié pour un usage professionnel régulier.

Comment convaincre sa direction d’investir dans l’IA générative ?

Commencez par un projet pilote à petite échelle (une équipe, un mois). Mesurez les gains de temps (par exemple, 30 % de temps gagné sur la rédaction des comptes rendus). Calculez le retour sur investissement projeté (temps gagné × coût horaire × nombre d’utilisateurs). Présentez également les risques de ne pas investir (retard concurrentiel, départ des talents attirés par des entreprises plus modernes). Les études de cas sectorielles (disponibles chez McKinsey, BCG, Accenture) sont également utiles pour appuyer votre argumentaire.

Faut-il interdire totalement l’usage des versions gratuites ?

L’interdiction pure et simple est difficile à faire respecter (les salariés continueront à les utiliser en cachette). Mieux vaut une approche nuancée : autoriser les versions gratuites pour les usages sans donnée confidentielle (brainstorming, reformulation, correction orthographique), mais les interdire formellement pour tout traitement de données personnelles, commerciales sensibles ou stratégiques. Accompagnez cette règle d’une formation et de sanctions proportionnées en cas de non-respect.

Quels sont les meilleurs cas d’usage pour une PME avec peu de budget ?

Pour une PME, commencez par trois usages à faible risque et fort ROI : 1) assistance à la rédaction d’emails commerciaux et de relances, 2) génération d’idées pour les posts sur les réseaux sociaux, 3) synthèse de comptes rendus de réunion. Utilisez une version payante peu coûteuse (ChatGPT Plus à 20 €/mois pour quelques utilisateurs clés) ou une version Enterprise si vous avez plus de 10 utilisateurs. Évitez les usages à risque (données clients, décisions financières).

Comment mesurer le ROI de l’IA générative dans mon entreprise ?

Plusieurs indicateurs possibles : temps moyen passé sur une tâche avant/après (ex : rédaction d’un email commercial), volume de production (ex : nombre d’articles de blog par mois), taux d’erreur ou de relecture, satisfaction des équipes (enquête interne), et pour les usages clients, taux de réponse, délai de réponse, satisfaction client. Idéalement, mesurez sur une période de 2-3 mois avec un groupe test et un groupe témoin. Les gains de productivité varient de 20 à 50 % selon les tâches.

Quels sont les métiers les plus impactés (positivement ou négativement) ?

Les métiers les plus impactés positivement sont ceux où la production de texte, la synthèse d’information ou la traduction sont centraux : marketing, communication, service client, juridique (première analyse), ressources humaines (rédaction d’offres, comptes rendus d’entretien), formation (génération d’exercices). Les métiers les plus menacés à moyen terme sont ceux où la production de contenu standardisé est l’essentiel de la valeur : rédacteurs techniques de contenu basique, traducteurs de textes non littéraires, certains postes de saisie ou de relecture de bas niveau. Dans tous les cas, l’IA augmente plus qu’elle ne remplace : les professionnels qui savent l’utiliser deviennent plus productifs que ceux qui l’ignorent.

Faut-il créer une charte interne dédiée à l’IA générative ?

Oui, dans la plupart des cas. Une charte simple permet de clarifier les usages autorisés, les outils validés, les données interdites, les obligations de relecture, les responsabilités et la procédure à suivre en cas de doute. Sans cadre écrit, les pratiques divergent, les risques augmentent et la gouvernance devient floue.

Sources

- McKinsey & Company – The state of AI in 2025 : generative AI’s breakout year (janvier 2026)

- Boston Consulting Group – The ROI of Generative AI in Business Operations (juin 2025)

- Gartner – Market Guide for Generative AI Enterprise Solutions (février 2026)

- IDC – Worldwide Generative AI Software Forecast 2025-2029 (mars 2026)

- National Bureau of Economic Research (NBER) – Generative AI at Work (étude terrain, 2025)

- Commission européenne – AI Act : guide pratique pour les entreprises (mise à jour 2026)

- CNIL – Intelligence artificielle et RGPD : quelles obligations pour les entreprises ? (2025)

- Coursera / Workday – Generative AI Skills in the Workplace Report 2026 (janvier 2026)

- OpenAI, Google, Microsoft, Anthropic – Blogs officiels et documentations techniques (2025-2026)